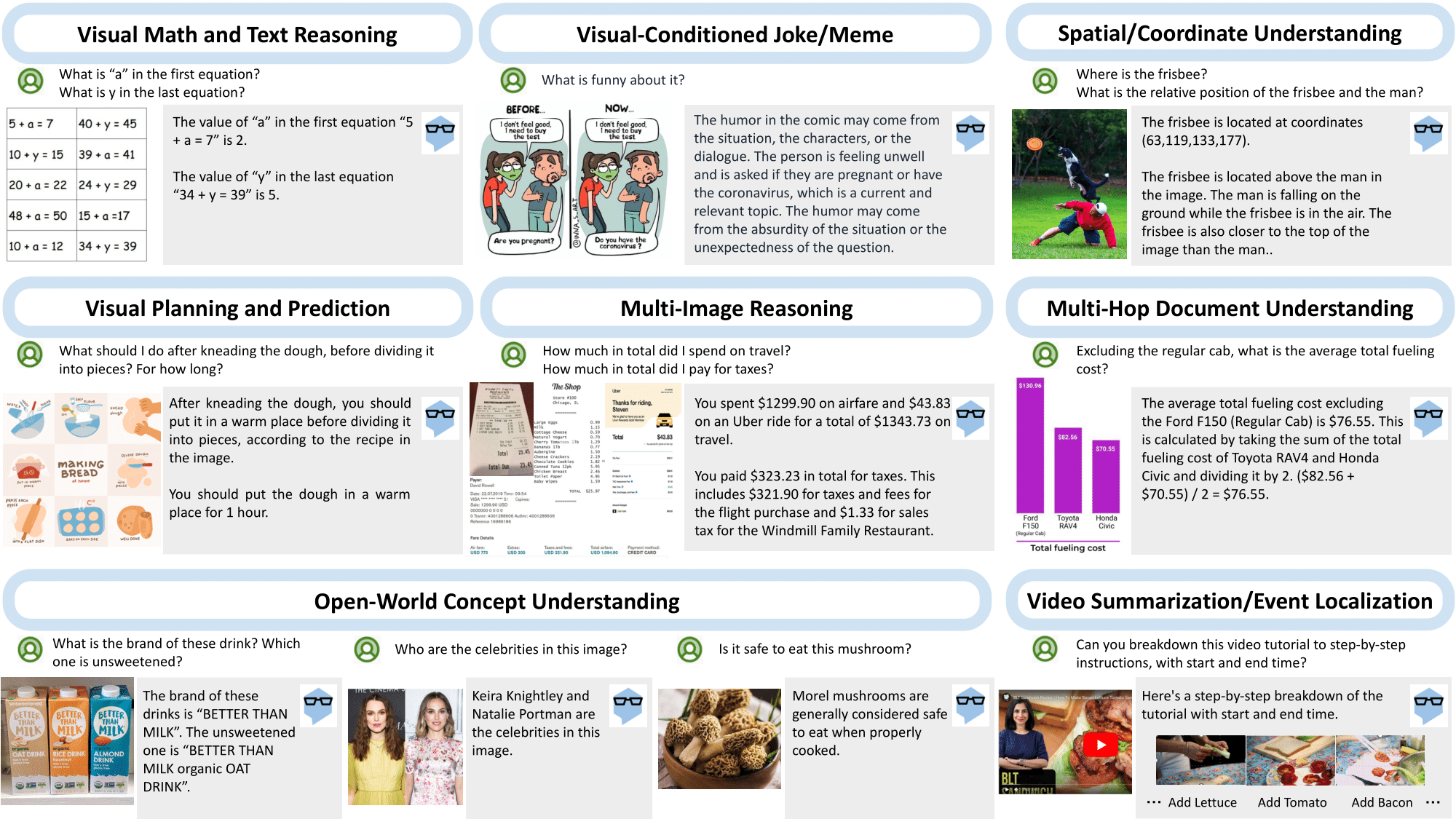

本文提出MM-REACT,一个将ChatGPT与视觉专家池集成在一起的系统范式,可以用于实现多模态推理和动作。在本文中,作者定义并探索了高级视觉任务的综合列表。这些任务很容易解决,但可能超出现有视觉和视觉语言模型的能力。为了实现这种高级视觉智能,MM-REACT引入了文本提示设计,可以将文本描述、文本化的空间左边、图像视频等密集视觉信息表达为对齐的文件名。MM-REACT的提示设计允许语言模型接受、关联和处理多模态信息,从而促进ChatGPT和视觉专家的协同组合。零样本实验证明了MM-REACT在处理感兴趣的特定能力方面的有效性,以及它在需要复杂视觉理解的不同场景中的广泛应用。此外,作者讨论并比较了MM-REACT系统范式通过联合微调扩展多模态场景语言模型的替代方法。

论文地址:https://arxiv.org/abs/2303.11381

项目地址:https://multimodal-react.github.io/

开源代码:https://github.com/microsoft/MM-REACT

作者:, , , , , ,, , ,

正文完

可以使用微信扫码关注公众号(ID:xzluomor)

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง