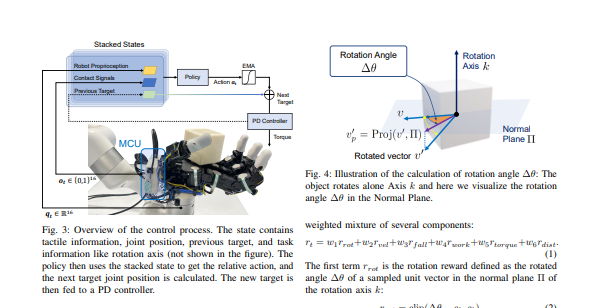

在本文中,提出了一个触觉操纵系统,能够在没有视觉的情况下旋转不同的物体。文章展示了一个端到端的强化学习框架来学习所提出的系统的触觉灵活性。

Rotating without Seeing: Towards In-hand Dexterity through Touch

Zhao-Heng Yin, Binghao Huang, Yuzhe Qin, Qifeng Chen, Xiaolong Wang

[HKUST &UC San Diego]

- 触觉信息在人类的灵巧性中起着关键作用。它揭示了可能无法直接从视觉中推断的有用的接触信息。事实上,人类甚至可以在不使用视觉的情况下进行手部的灵巧操作。我们能使多指机器人手具有同样的能力吗?

- 在本文中,提出了 “触摸灵巧”(Touch Dexterity),这是一个新的系统,可以在不看到物体的情况下,只用触摸来完成手部物体的旋转。

- 文章引入了一种新的系统设计,而不是依赖小区域内的精确触觉感应,而是使用密集的二元力传感器(触摸或不触摸)覆盖整个机器人手的一面(手掌、手指链接、指尖)。这样的设计成本低,对物体的覆盖面大,同时又能最大限度地减少Sim2Real的差距。

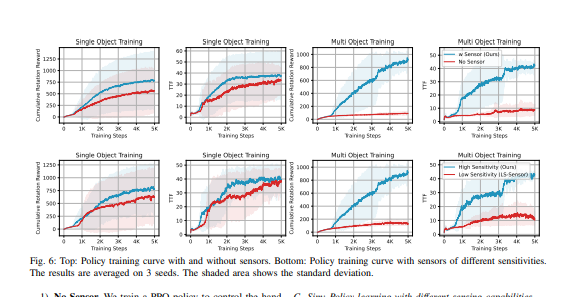

- 论文使用强化学习法在模拟的不同物体上训练一个手内旋转策略。依靠纯触摸感应,我们可以直接在真实的机器人手上部署该策略,并旋转训练中没有出现的新物体。论文对触觉信息如何帮助手部操作进行了广泛的分析。

项目地址:https://touchdexterity.github.io/

https://arxiv.org/pdf/2303.10880.pdf

正文完

可以使用微信扫码关注公众号(ID:xzluomor)

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง