本文提出一种RCI方方法,在自动化计算机任务方面明显优于现有的LLM方法。

Language Models can Solve Computer Tasks

Geunwoo Kim, Pierre Baldi, Stephen McAleer

[University of California & Carnegie Mellon University]

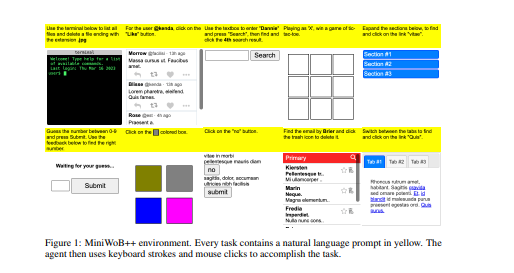

- 能够在计算机上执行一般任务的代理可以通过自动化重复性任务和协助复杂问题的解决来提高效率和生产力。理想情况下,这种代理应该能够解决通过自然语言命令向它们提出的新的计算机任务。然而,以前解决这个问题的方法需要大量的专家示范和特定任务的奖励函数,这两者对新任务来说都是不切实际的。

- 在这项工作中,我们表明,一个预先训练好的大型语言模型(LLM)代理可以在自然语言指导下执行计算机任务,使用一个简单的提示方案,代理递归地批评和改进其输出(RCI)。RCI方法在自动化计算机任务方面明显优于现有的LLM方法,在MiniWoB++基准上超过了监督学习(SL)和强化学习(RL)方法。RCI与最先进的SL+RL方法相比是有竞争力的,每个任务只使用少量的演示,而不是数以万计的演示,而且没有特定的任务奖励函数。

- 此外,我们证明了RCI提示在提高LLMs在一套自然语言推理任务上的推理能力方面的有效性,超过了思维链(CoT)的提示。我们发现,RCI与CoT的结合比两者单独使用的效果更好。

https://arxiv.org/pdf/2303.17491.pdf

正文完

可以使用微信扫码关注公众号(ID:xzluomor)

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง