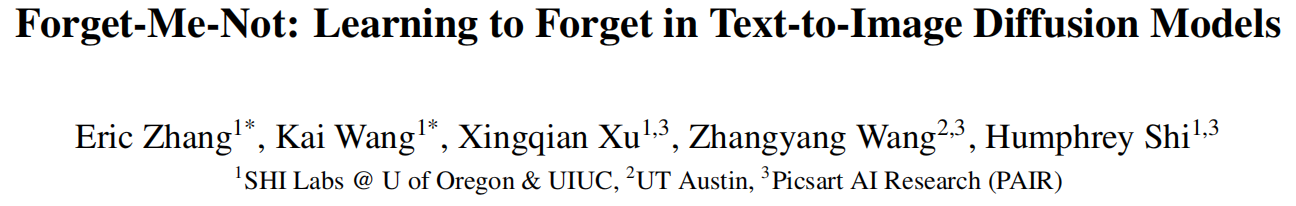

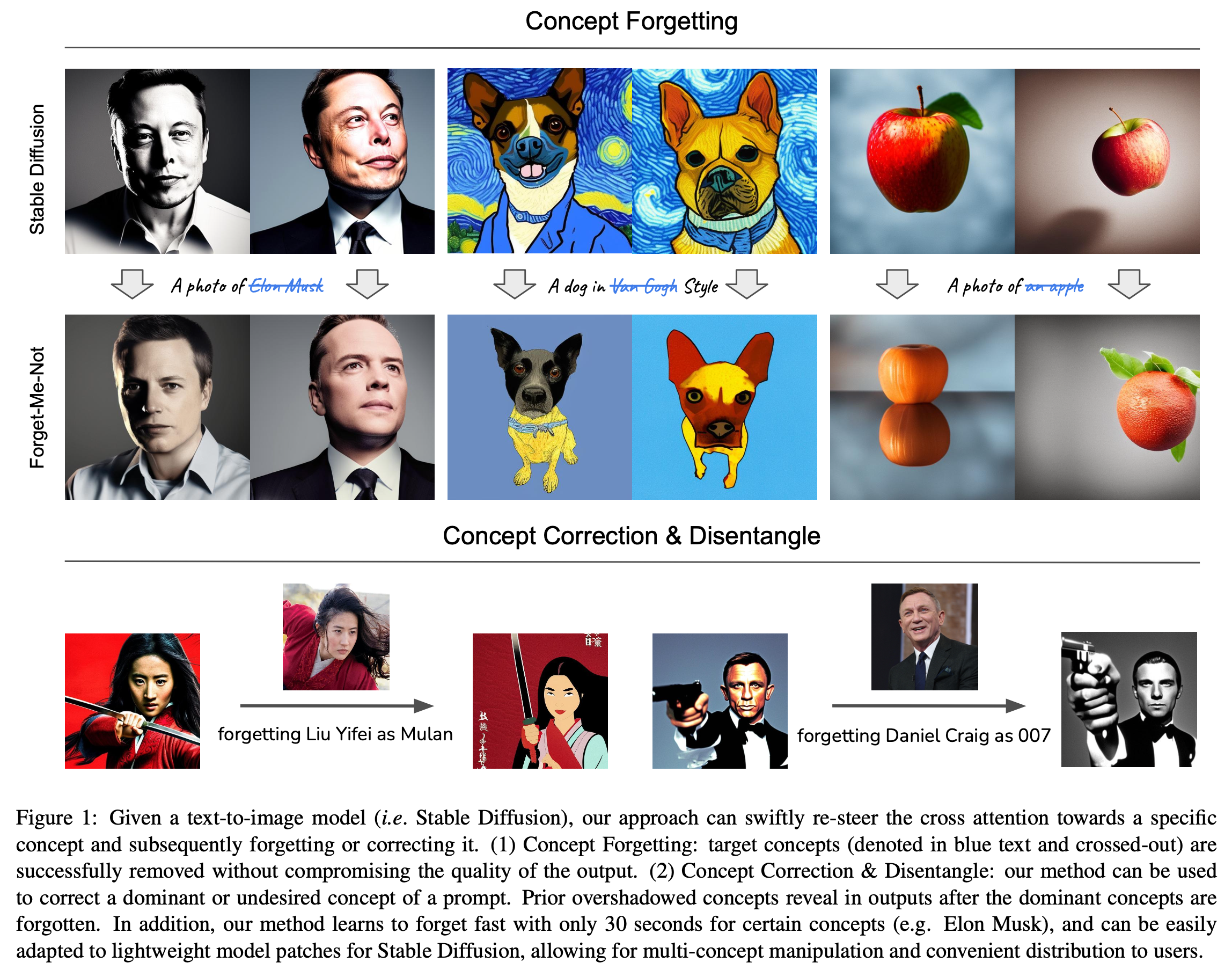

深度学习模型的遗忘问题曾经是学术界的主要关注点,但现在却已成为行业中普遍存在的难题。文本到图像生成技术的重大进展引发了隐私、版权和安全等全球性讨论,因为这些模型学习了许多未经许可的个人身份信息、内容、艺术作品和可能有害的物料,并随后用于生成和分发无法控制的内容。为了应对这一挑战,本文提出了一种名为“Forget-Me-Not”的高效低成本解决深度学习模型的遗忘问题,曾经是学术界的研究关注,现在已经成为工业界一个普遍存在的问题。文本到图像生成技术的重大进展引发了有关隐私、版权和安全的全球性讨论,因为这些模型学习到了大量未经授权的个人身份证号码、内容、艺术创作和潜在有害材料,随后利用这些信息生成和分发难以控制的内容。为了解决这一挑战,本文提出了一种高效、低成本的解决方案——“Forget-Me-Not”,它可以安全地从一个良好配置的文本到图像模型中删除指定的 ID、对象或风格,时间仅需要短短 30 秒,并且不会影响其生成其他内容的能力。除了本文的方法,本文还引入了“Memorization Score (M-Score)”和“ConceptBench”来衡量模型生成通用概念的能力,这些概念被分为三大类:ID、对象和风格。使用 M-Score 和 ConceptBench,本文证明 Forget-Me-Not 可以有效地消除指定的概念,同时保持模型在其他概念上的性能。此外,Forget-Me-Not 还提供了两个实用的扩展功能:a)删除潜在有害或 NSFW 内容,b)通过“概念修正和解耦”提高模型的准确性、包容性和多样性。它还可以被适配为 Stable Diffusion 的轻量级模型补丁,实现概念操作和便捷分发。

总结:本文提出了一种名为 Forget-Me-Not 的解决文本到图像生成模型中训练的遗忘问题的方法。该解决方案可以有效地删除指定的 ID、对象或风格,而不会影响模型生成其他内容的能力,并且可以在短短 30 秒内完成。此外,该方法引入了 Memorization Score (M-Score) 和 ConceptBench 来衡量模型生成通用概念的能力,并可用于删除潜在有害或不良内容,并提高模型的准确性、包容性和多样性。由于这个问题已经成为工业界普遍存在的一个难题,本文所提出的解决方案具有实际价值,并且可以通过开源代码和 ConceptBench 来推动安全、包容的生成模型的发展。

标题:Forget-Me-Not: Learning to Forget in Text-to-Image Diffusion Models

作者:Eric Zhang, Kai Wang, Xingqian Xu, Zhangyang Wang, Humphrey Shi

代码:https://github.com/SHI-Labs/Forget-Me-Not

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง