本文发布了Pythia,这是一套经过一致数据排序和跨多个数量级的模型架构训练的语言模型。文章展示了Pythia如何被用来为公共模型套件提供前所未有的细节水平的实验,通过提供关于性别去偏见、记忆和术语频率效应的新分析和结果。这些分析将激发进一步的后续工作,展示预训练数据如何推动更复杂任务中能力的获取和出现,这些模型及其数据集工具将对各种从业者广泛有用,并建议将该套件用作LLM新实验设置的框架。

标题:Pythia: A Suite for Analyzing Large Language Models Across Training and Scaling

作者:Stella Biderman, Hailey Schoelkopf, Quentin Anthony, Herbie Bradley, Kyle O’Brien, Eric Hallahan, Mohammad Aflah Khan, Shivanshu Purohit, USVSN Sai Prashanth, Edward Raff, Aviya Skowron, Lintang Sutawika, Oskar van der Wal

[EleutherAI & Booz Allen Hamilton & Yale University & University of Cambridge & Indraprastha Institute of Information Technology Delhi, India & Datasaur.ai & University of Amsterdam]

简介:

-

大型语言模型(LLMs)在训练过程中是如何发展和演变的?这些模式是如何随着模型的扩大而变化的?

-

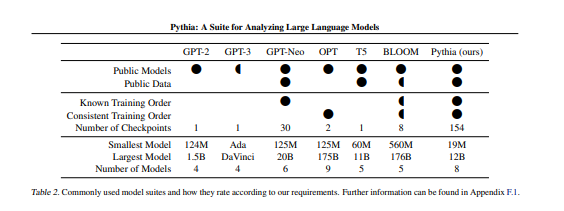

为了回答这些问题,我们介绍了Pythia,这是一套16个LLM,都是在公共数据上以完全相同的顺序训练的,参数大小从70M到12B不等。我们为这16个模型中的每一个提供了154个检查点的公开访问权限,同时还提供了下载和重建其精确训练数据的工具,以便进一步研究。

-

我们希望Pythia能促进许多领域的研究,我们提出了几个案例研究,包括记忆的新结果、术语频率对少许射击性能的影响,以及减少性别偏见。我们证明,这种高度控制的设置可以用来产生对LLMs及其训练动态的新见解。

训练过的模型、分析代码、训练代码和训练数据:https://github.com/EleutherAI/pythia

https://arxiv.org/pdf/2304.01373.pdf

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง