【推荐理由】大型语言模型在复杂的语言任务上的出色表现引发了有关它们能力本质的热烈讨论。本文从本质上讨论了大规模语言模型的这种向量接地问题。

The Vector Grounding Problem

Dimitri Coelho Mollo, Raphaël Millière

[Umeå University & Columbia University]

【论文链接】https://arxiv.org/pdf/2304.01481.pdf

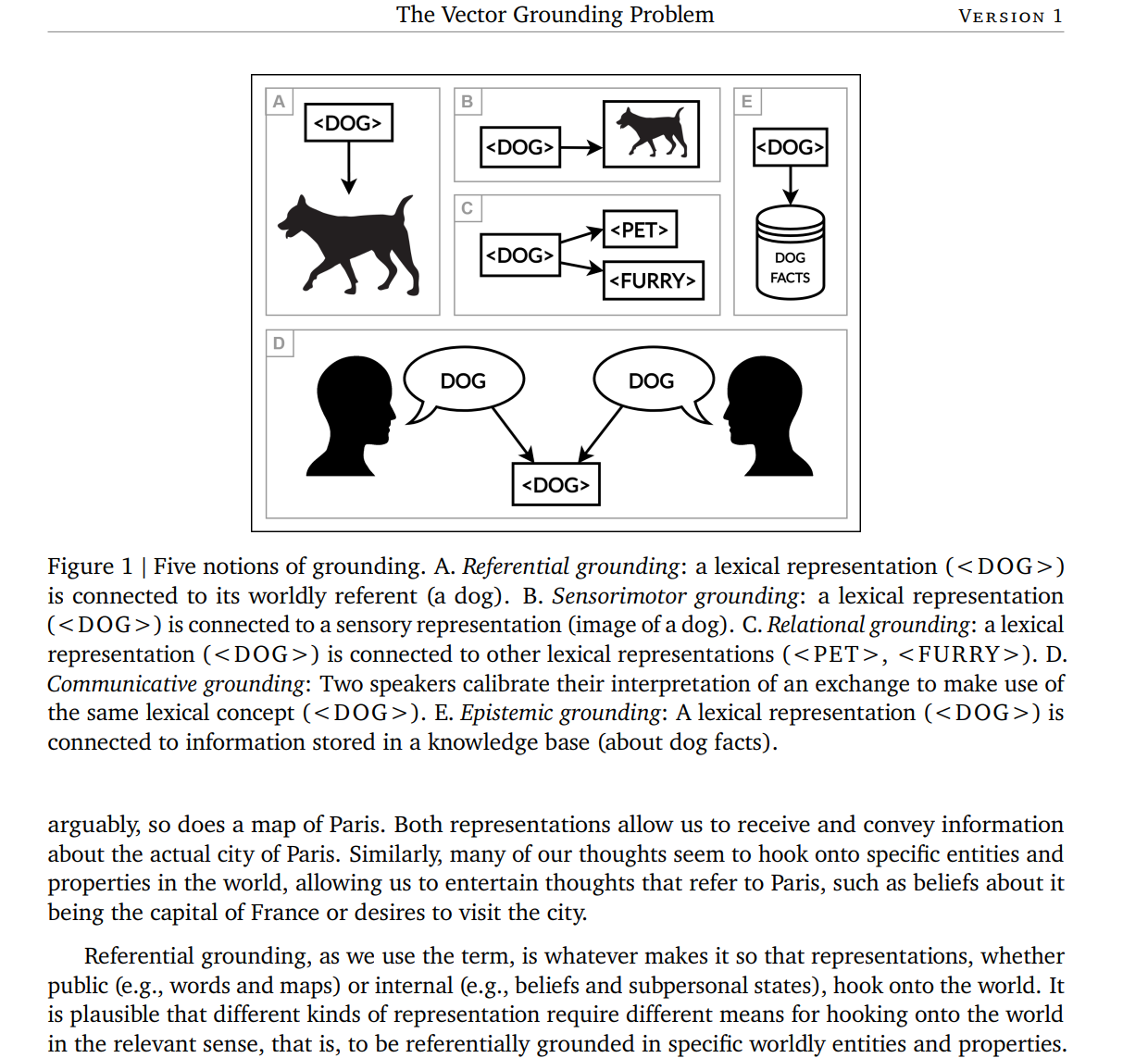

【摘要】大型语言模型(LLMs)在复杂的语言任务上的出色表现引发了有关它们能力本质的热烈讨论。与人类不同,这些模型仅通过文本数据学习语言,没有与现实世界的直接交互。尽管如此,它们可以生成关于各种主题的看似有意义的文本。这一印象深刻的成就重新点燃了对经典的“符号接地问题”的兴趣,该问题质疑了经典符号AI系统的内部表征和输出是否能够拥有内在的含义。与这些系统不同,现代LLMs是计算向量而不是符号的人工神经网络。然而,这种系统也存在类似的问题,我们称之为向量接地问题。本文有两个主要目标。首先,区分了内部表征可以在生物或人工系统中接地的各种方式,确定了文献中讨论的五个不同的概念:指涉性、感觉运动性、关系性、交际性和认识性接地。不幸的是,这些接地概念经常混淆。文章澄清了它们之间的差异,并认为指涉性接地是向量接地问题的核心。其次,借鉴哲学和认知科学中的表征内容理论,作者提出某些LLMs,特别是那些通过人类反馈进行强化学习调优(RLHF)的模型具有克服向量接地问题所需的必要特征,因为它们处于构成内在含义的世界所需的因果历史关系中。文章还认为,也许出乎意料的是,多模态和具身化既不是人工系统指涉性接地的必要条件,也不是充分条件。

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง