【推荐理由】本文为解决CLIP等大模型进行图像生成过程中产生的模式崩塌问题,提出了一种图像特定提示学习(IPL)方法,该方法为每个源域图像学习特定的提示向量。在各种域上的定性和定量评估表明,IPL有效地提高了合成图像的质量和多样性。

Zero-shot Generative Model Adaptation via Image-specific Prompt Learning

Jiayi Guo, Chaofei Wang, You Wu, Eric Zhang, Kai Wang, Xingqian Xu, Shiji Song, Humphrey Shi, Gao Huang

[Tsinghua University, BNRist & UCAS & SHI Labs @ Oregon & UIUC & Picsart AI Research (PAIR)]

【论文链接】https://arxiv.org/pdf/2304.03119.pdf

【项目链接】https://github.com/Picsart-AI-Research/IPL-Zero-Shot-Generative-Model-Adaptation

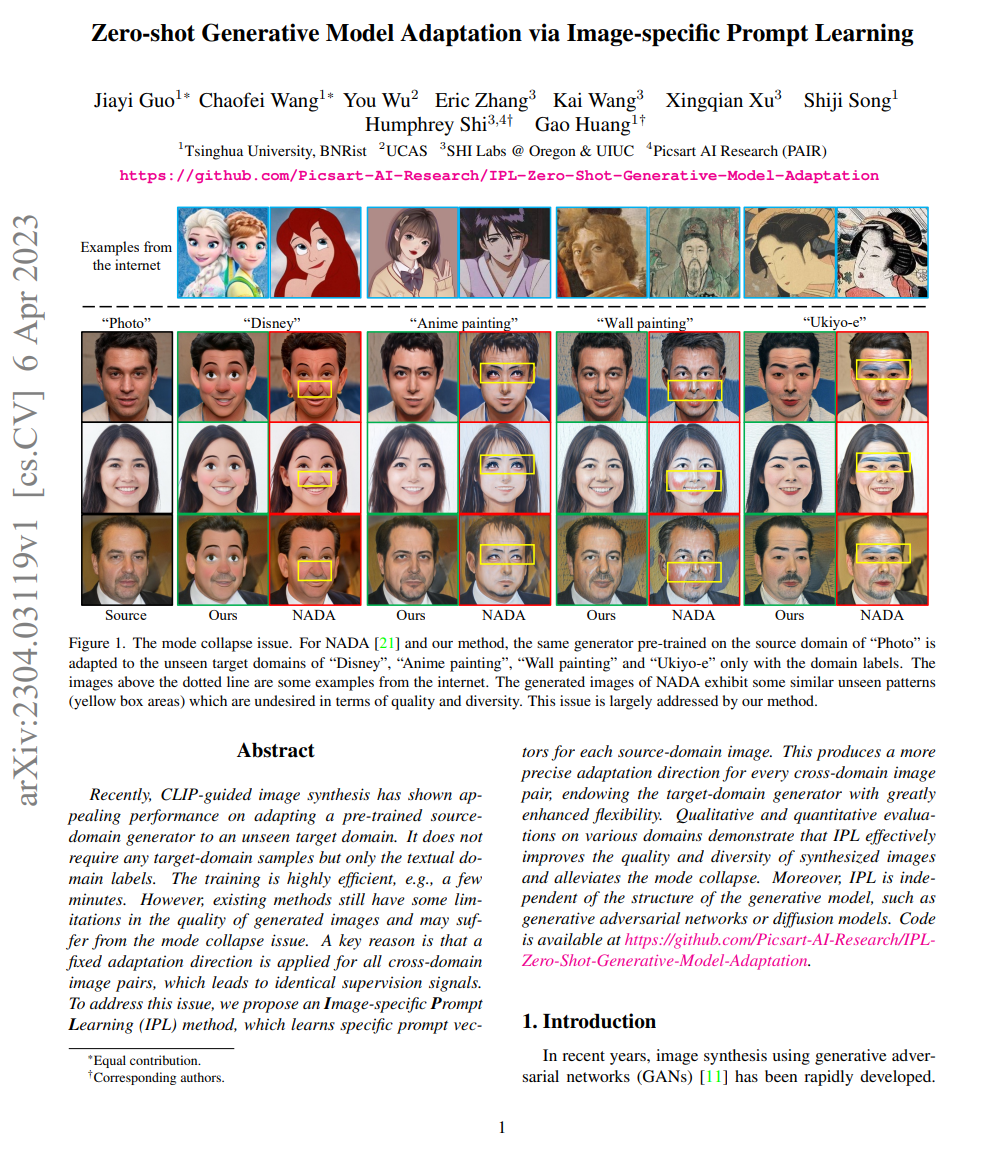

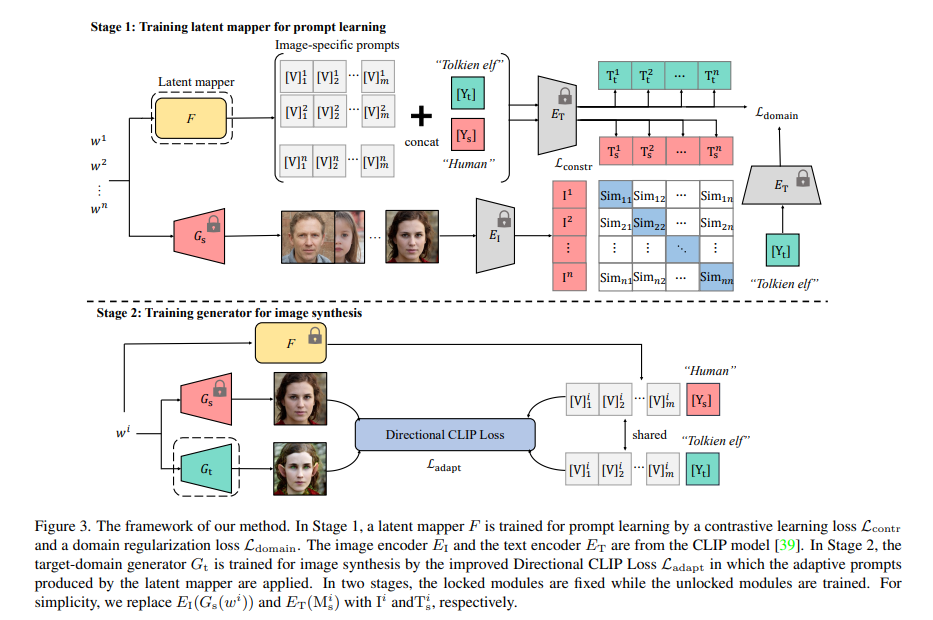

【摘要】最近,CLIP引导的图像合成在将预训练的源域生成器适应到未见过的目标域方面表现出引人注目的性能。它不需要任何目标域样本,只需要文本域标签。训练非常高效,例如几分钟。然而,现有方法仍然存在一些限制,如生成图像的质量可能较低,可能会遭受模式崩溃的问题。一个关键原因是对于所有跨域图像对都应用了固定的适应方向,这导致了相同的监督信号。为了解决这个问题,作者提出了一种图像特定提示学习(IPL)方法,为每个源域图像学习特定的提示向量。这为每个跨域图像对产生了更精确的适应方向,赋予了目标域生成器极大的灵活性。对各种域的定性和定量评估表明,IPL有效地提高了合成图像的质量和多样性,并缓解了模式崩溃。此外,IPL独立于生成模型的结构,如生成对抗网络或扩散模型。

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง