【推荐理由】本文提出了一种新颖的反渲染框架,用于大型城市场景,能够从一组姿态RGB图像(可选深度)中联合重建场景几何、空间变化材料和HDR照明。

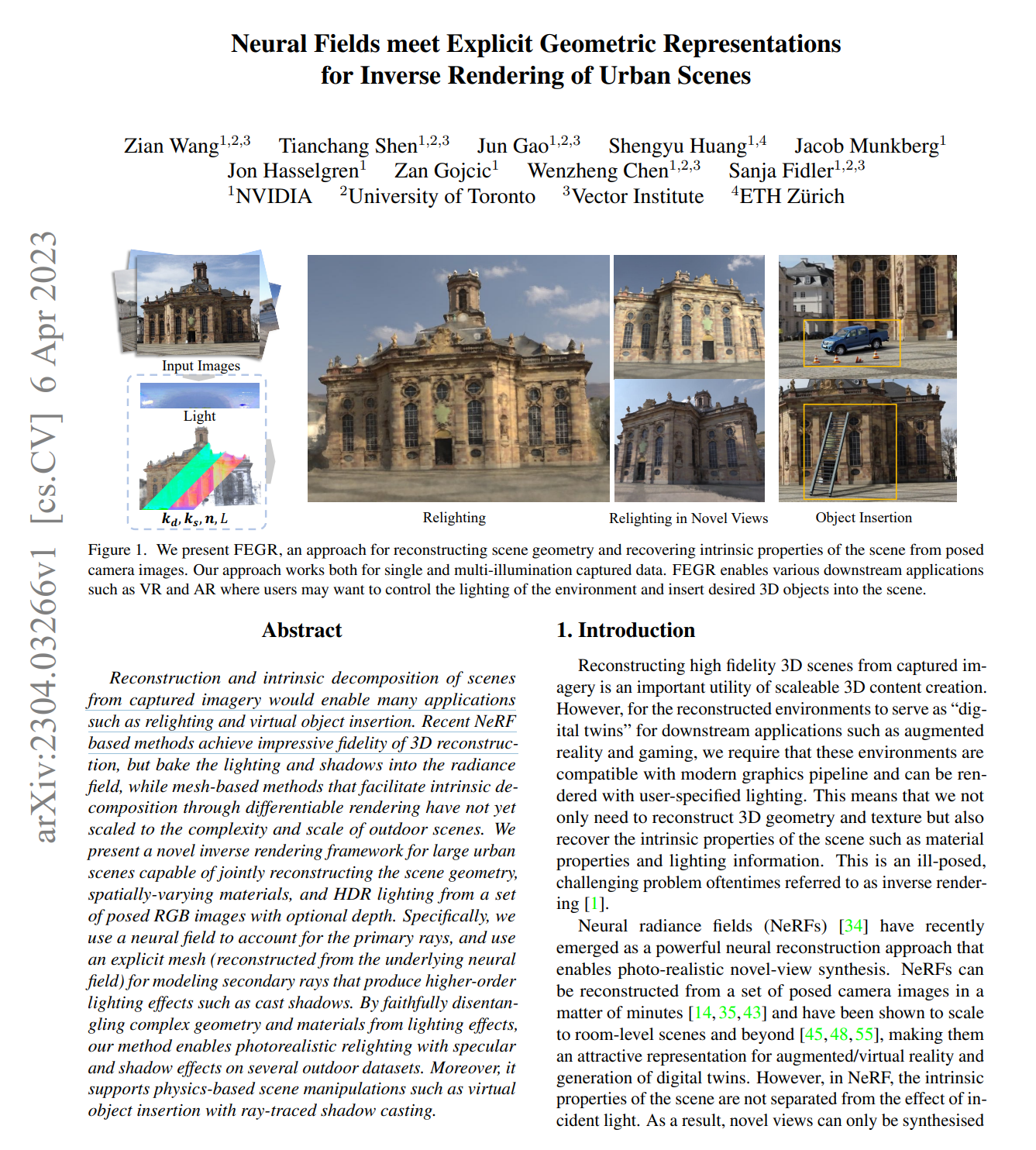

Neural Fields meet Explicit Geometric Representation for Inverse Rendering of Urban Scenes

Zian Wang, Tianchang Shen, Jun Gao, Shengyu Huang, Jacob Munkberg, Jon Hasselgren, Zan Gojcic, Wenzheng Chen, Sanja Fidler

[NVIDIA & University of Toronto & Vector Institute & ETH Zürich]

【论文链接】https://arxiv.org/pdf/2304.03266.pdf

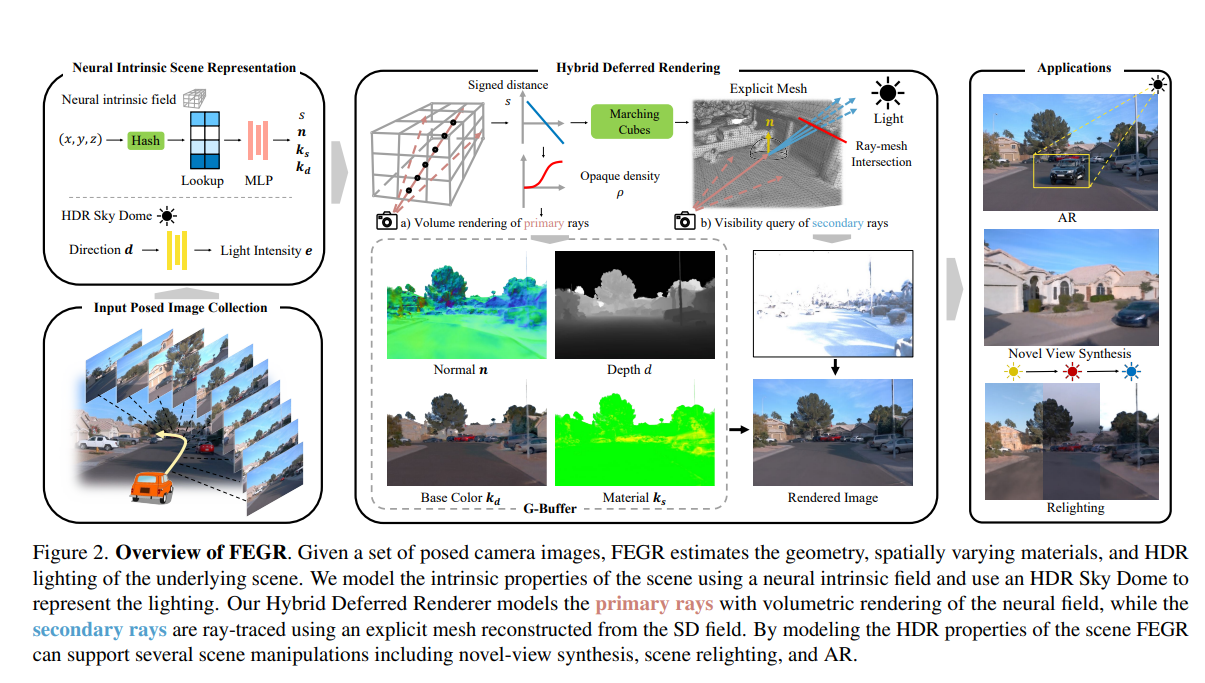

【摘要】从捕捉到的图像中重建和内在分解场景能够实现许多应用,例如重新照明和虚拟对象插入。最近基于 NeRF 的方法实现了令人印象深刻的 3D 重建保真度,但将光照和阴影嵌入辐射场中,而促进内在分解的网格方法通过可微分渲染尚未扩展到室外场景的复杂性和规模。本文提出了一种新颖的反演渲染框架,可同时从一组姿态 RGB 图像(可选深度)中重建大型城市场景的几何、空间变化材料和 HDR 照明。具体而言,我们使用神经场来解决主要射线,并使用明确的网格(从底层神经场重建)来建模产生更高阶光效果(如投射阴影)的次要射线。通过忠实地将复杂的几何和材料与光照效果分离,该方法在几个室外数据集上实现了具有镜面和阴影效果的逼真重新照明。此外,它支持基于物理的场景操作,例如通过光线跟踪投射阴影进行虚拟物体插入。