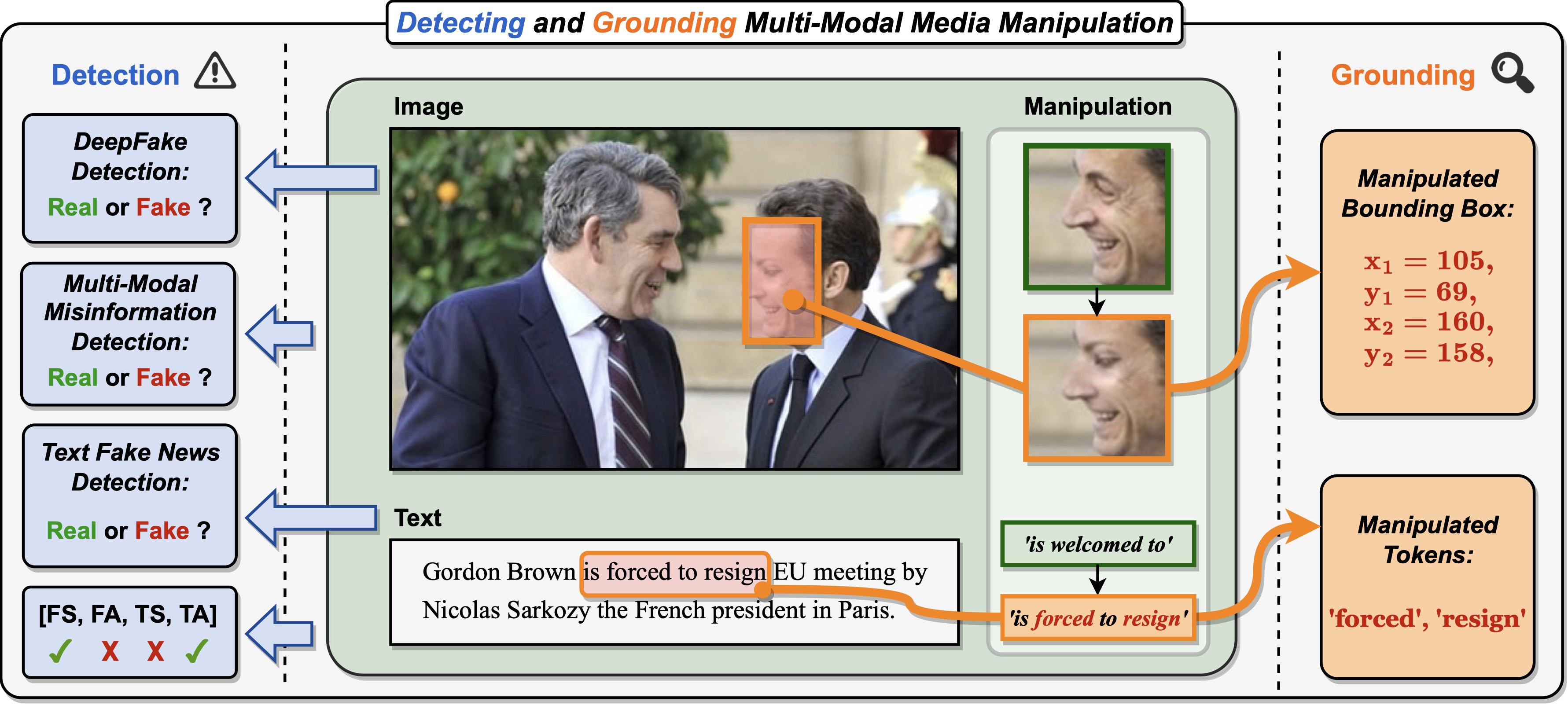

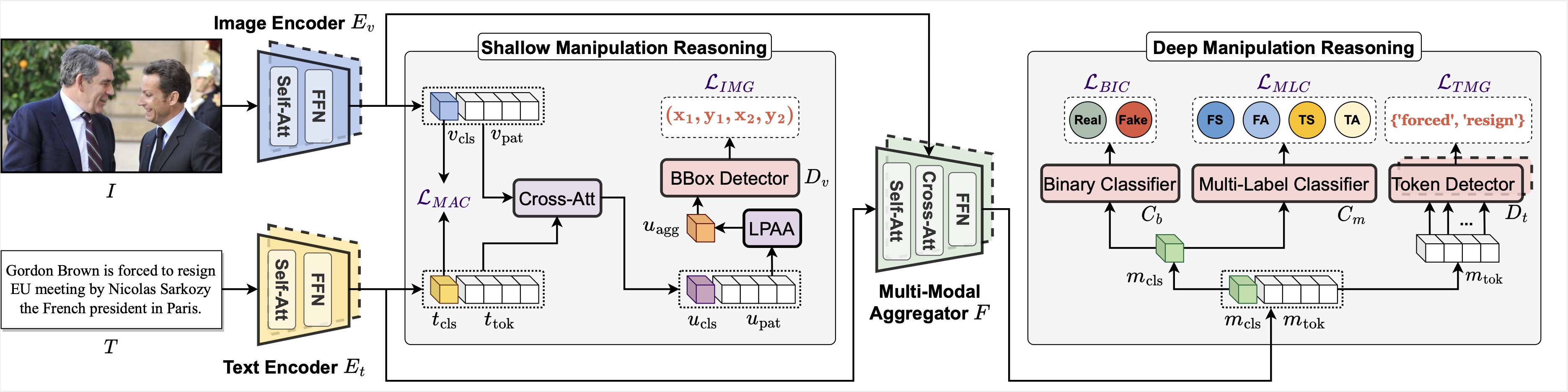

虚假信息已成为迫切需要解决的问题。伪造媒体在网络上广泛存在,包括视觉和文本形式。尽管已经提出了各种深度伪造检测和文本虚假新闻检测方法,但它们仅适用于基于二进制分类的单模式伪造,更不用说分析和推理跨越不同模态的微妙伪造痕迹了。在本文中,我们强调了多模态虚假媒体的一个新的研究问题,即检测和定位多模态媒体操纵(DGM^4)。DGM^4不仅旨在检测多模态媒体的真实性,还旨在确定操纵内容(即图像边界框和文本标记),这需要更深入的多模态媒体操纵推理。为了支持大规模调查,我们构建了第一个DGM^4数据集,其中图像-文本对通过各种方法进行操纵,并具有丰富的不同操纵注释。此外,我们提出了一种新颖的分层多模态操纵推理变形器(HAMMER),以充分捕捉不同模态之间的细粒度交互。HAMMER执行以下操作:1)基于浅层操纵推理的两个单模态编码器的操纵感知对比学习,2)基于多模态聚合器进行的模态感知交叉注意力的深度操纵推理。基于交互的多模态信息,从浅到深地集成了专用的操作检测和定位头。最后,我们建立了一个广泛的基准,并为这个新的研究问题设置了严格的评估指标。全面的实验表明了我们模型的优越性和一些有价值的发现,有助于未来的多模态媒体操纵研究。

总结:

本文提出了一种用于检测和定位多模式媒体操纵的方法。该方法可以准确地检测图像和视频中的操纵区域,并且可以将操纵区域与原始语料库中的文本进行对应。该方法结合了多个任务,包括操纵检测、操纵类型分类、框定和定位。通过结合视觉和语言信息,该方法能够自动分析媒体内容,并检测出任何不当的图像和视频编辑。该方法在多个真实数据集上进行了测试,结果表明其在多个指标上都比其他竞争方法具有更好的表现。在对抗性攻击的情况下,该方法也表现出了较好的鲁棒性。该方法可应用于新闻和社交媒体等各种媒体场景,能够帮助人们有效地识别和应对媒体操纵现象。

标题:DGM4: Detecting and Grounding Multi-Modal Media Manipulation

作者:Rui Shao Tianxing Wu Ziwei Liu

代码:https://github.com/rshaojimmy/MultiModal-DeepFake

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง