标题:SparseFormer: Sparse Visual Recognition via Limited Latent Tokens

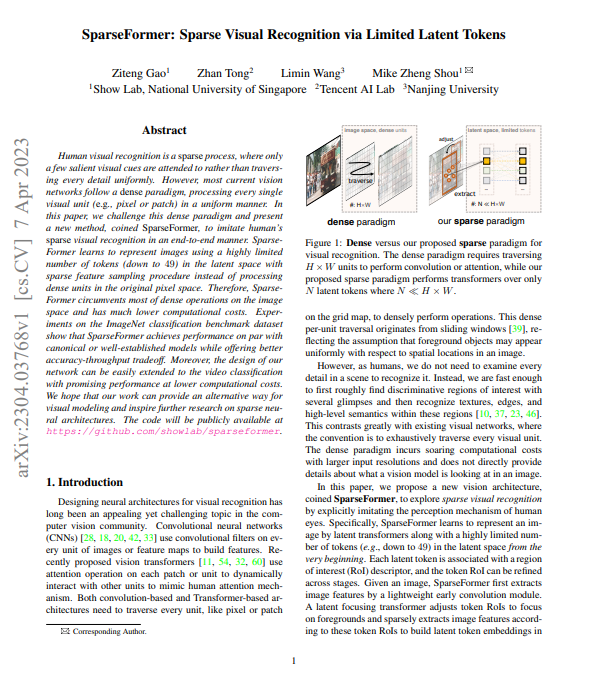

人类的视觉识别是一个稀疏的过程,只有少数突出的视觉线索被关注,而不是均匀地遍历每一个细节。然而,目前大多数的视觉网络都遵循密集的模式,以统一的方式处理每一个视觉单元(例如,像素或斑块)。

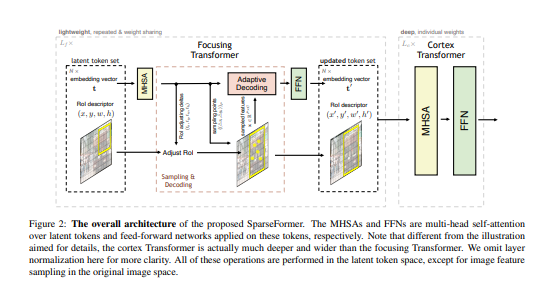

在本文中,我们挑战了这种密集范式,并提出了一种新的方法,即SparseFormer,以端到端的方式模仿人类的稀疏视觉识别。SparseFormer学习使用潜伏空间中高度有限的标记(低至49个)来表示图像,采用稀疏特征采样程序,而不是处理原始像素空间中的密集单元。因此,SparseFormer规避了对图像空间的大部分密集操作,并具有更低的计算成本。

在ImageNet分类基准数据集上的实验表明,SparseFormer实现了与经典或成熟模型相同的性能,同时提供了更好的准确性-吞吐量权衡。此外,我们的网络设计可以很容易地扩展到视频分类中,并以较低的计算成本获得良好的性能。我们希望我们的工作能够为视觉建模提供一种替代方法,并激发对稀疏神经结构的进一步研究。

该代码将在以下网址上公开提供:https://github.com/showlab/sparseformer

https://arxiv.org/pdf/2304.03768.pdf

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง