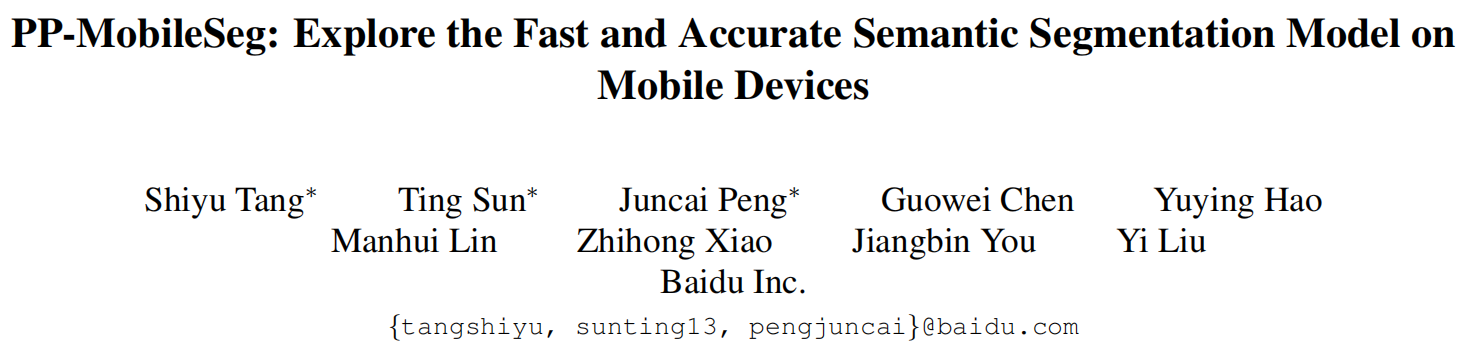

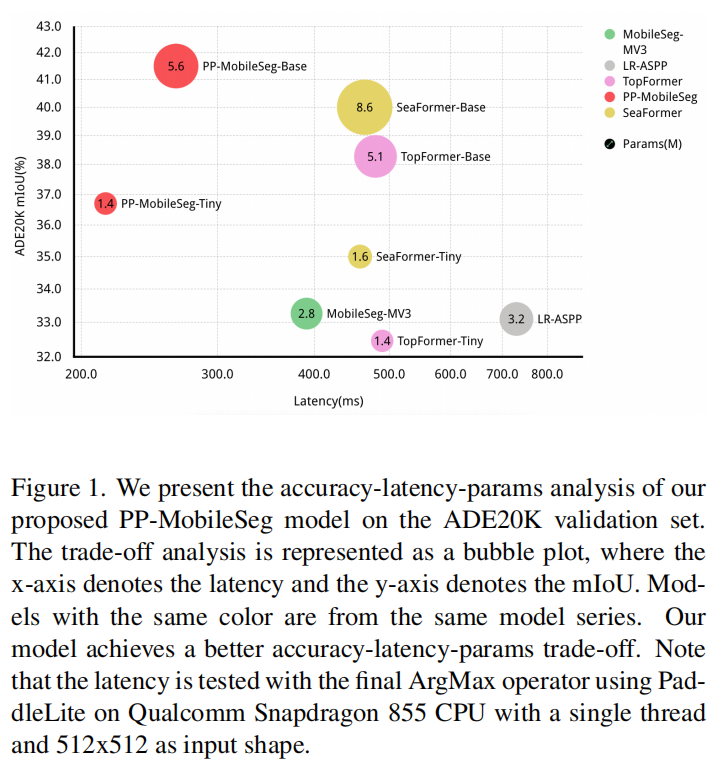

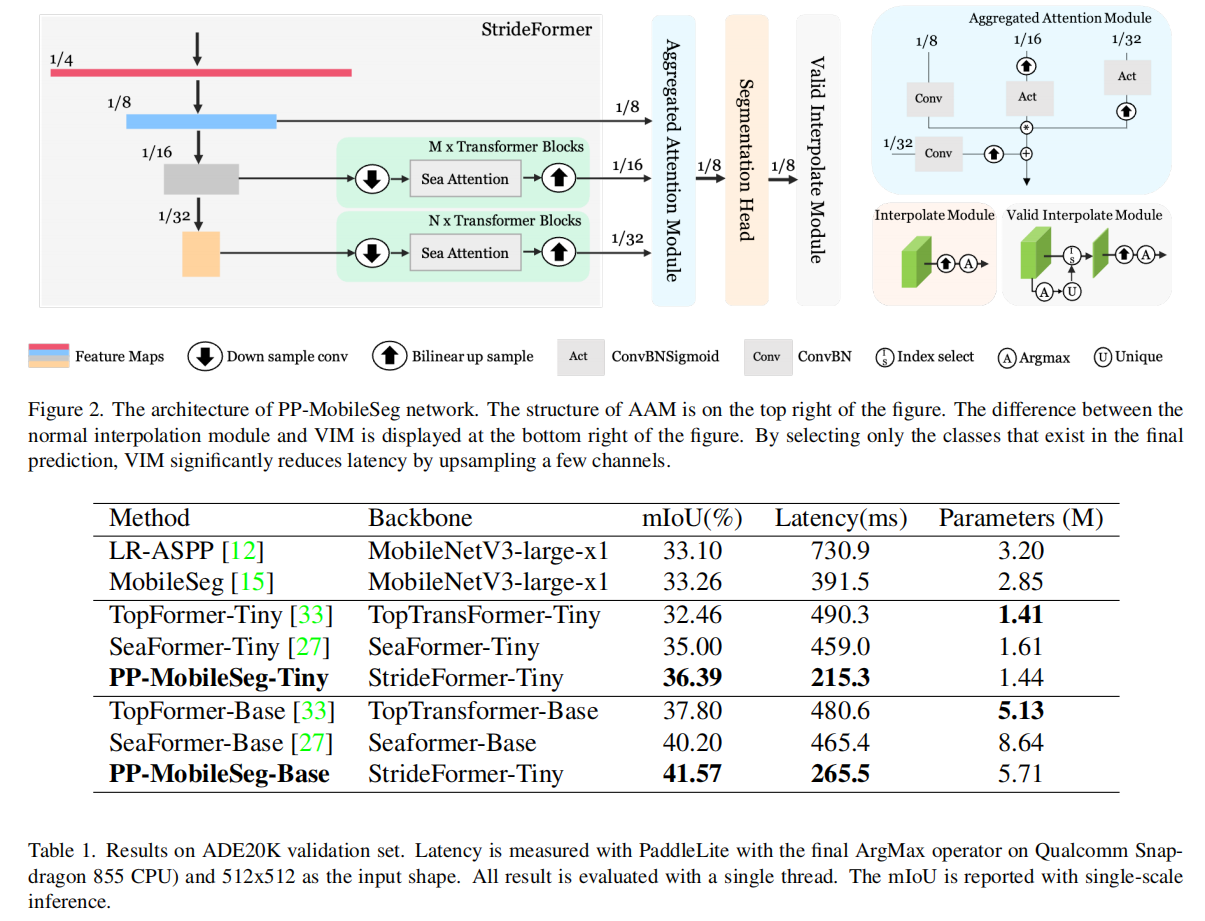

Transformer在计算机视觉领域的成功,已经引发了多次适用于移动设备的尝试。但是它们在一些现实世界的应用上的表现仍然不太令人满意。为了解决这个问题,本文提出了PP-MobileSeg,一种在移动设备上实现最先进性能的语义分割模型。PP-MobileSeg包括三个新颖的部分:StrideFormer骨干网络、聚合注意力模块(AAM)和有效插值模块(VIM)。StrideFormer骨干网络采用了MV3模块和多步SEA注意力,它能够以最小参数开销提取丰富的语义和详细的特征。AAM通过语义特征集成投票对详细特征进行过滤,然后将它们与语义特征结合起来增强语义信息。此外,作者还提出了VIM来将下采样的特征上采样到输入图像的分辨率。它通过只插值在最终预测中存在的类,显著地减少了模型的延迟时间。广泛的实验表明,PP-MobileSeg在精度、模型大小和延迟等方面取得了卓越的平衡,比其他方法更好。在ADE20K数据集上,PP-MobileSeg比SeaFormer-Base更准确,mIoU提高了1.57%,参数减少了32.9%,在Qualcomm Snapdragon855上加速了42.3%。

总结:

本文介绍了一种基于轻量化网络结构的快速准确的语义分割模型,名为PP-MobileSeg。该模型可以在移动设备上实现高效实时的语义分割,具有较低的延迟和更少的计算量。文章列举了在多个语义分割数据集上的实验结果,并与其他经典模型进行了比较。结果表明PP-MobileSeg在速度、精度和模型大小等方面都能够达到最先进水平。文章还探讨了模型的优化和加速方法,以及可能的应用场景,如智能手机上的实时分割和机器人视觉等。

标题:PP-MobileSeg: Explore the Fast and Accurate Semantic Segmentation Model on Mobile Devices

作者:Shiyu Tang, Ting Sun, Juncai Peng, Guowei Chen, Yuying Hao, Manhui Lin, Zhihong Xiao, Jiangbin You, Yi Liu

项目:https://github.com/PaddlePaddle/PaddleSeg/tree/release/2.8

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง