AI 生圖是透過訓練模型學習自行生成圖像,而電腦繪圖則是由使用者透過軟體或工具手動繪製圖像。

儘管可能較缺乏人工繪圖的細節與創意,但是都是由 AI 自己生成,每張絕無僅有,這樣應該也算是有些創意吧?

究竟這個「安能辨我是 AI」的新時代,到底是怎麼突然降臨的呢?

現代魔法師的誕生

現在夯、猶如魔法的 Midjourney,使用者針對想要創作的內容和風格,給出關鍵字如 Hyper realistic、Xerox Art、masterpiece、underwater,以及畫面比例等參數,甚至是特定藝術家的名字,大約 30 秒到 1 分鐘,就能完成作品,對一般民眾來極容易上手。

如果生成出不對勁的怪圖,只要請它參照範例、補充關鍵字,或是你本身就有一點修圖能力,就可以產出高品質的美圖。因此,我們也可以說這是一種能和 AI 繪師對話的語言介面,新的職業「AI 溝通師」也隨之出現。

AI 生圖其實也不是什麼新技術,早就有人採用一種名為 GAN 的對抗式生成網路的演算法來生成圖片。在 2018 年也有人用來生成某種藝術作品,並拍賣出高價,當然在當時與其說是美麗的藝術,其實更多是個噱頭。

從模仿到創造

為了達成「創新」,AI 研究者放棄了 GAN 中讓 AI 互相競爭找出「最佳解」的對抗式思維,提出一種名為「Diffusion model」擴散模型的新概念。

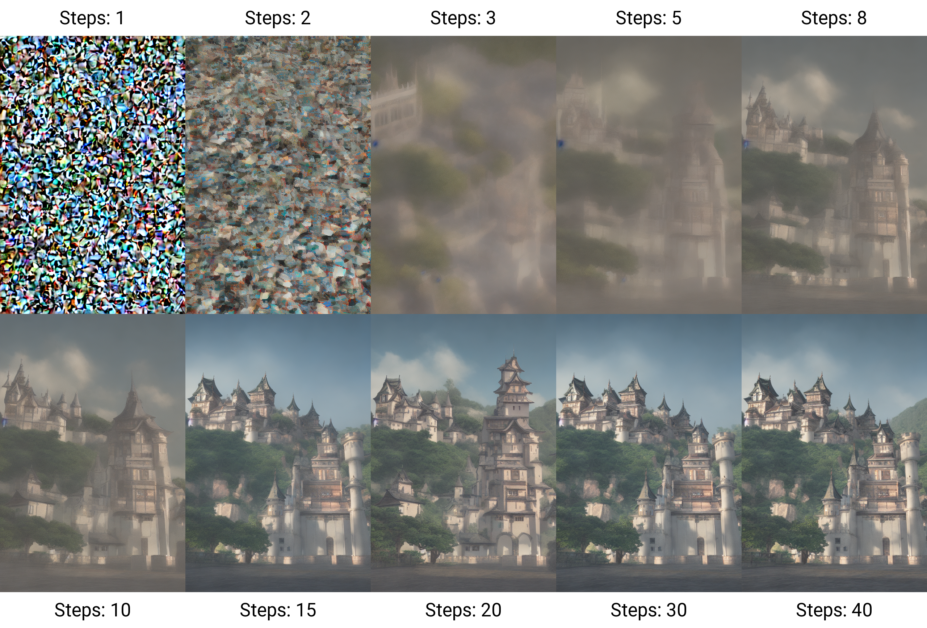

如果觀察 Stable diffusion 或 Midjourney 生圖過程,可以發現到,圖片會從一團什麼都沒有的雜訊開始,逐漸出現五官、輪廓等特徵,最後才變成有著豐富細節的精緻畫作。

擴散模型的去噪過程。圖/維基百科

擴散模型的去噪過程。圖/維基百科Diffusion model 在訓練時則是會先看到一張完整照片,接著依照馬可夫鏈的過程,以高斯分布的方式往圖片上加入隨機噪點。待整張圖變成一團雜訊,等它學會從一張圖到混亂雜訊的過程後,再習得如何從混亂雜訊中生成圖的能力;於每一步加噪的過程中學會降噪,使用時間鉗形攻勢,完成雙向學習。

Diffusion model 在接下來的訓練中,會不斷調整自己的參數,學習自己生成圖片。這個訓練好的 Diffusion model 其實就像個大型藍色窗簾機器人,從雜訊中抓出特定特徵,例如看到兩點一線,就說是人類的眼睛與嘴巴,接著漸漸畫出人類的面貌。

過程中還會加上一個名為「變方自編碼器」(Variational Auto-encoder ,VAE)的加持,使它輸出的不只是原本的訓練或輸入的圖片,而是真正能夠「無中生有」的連續性畫素,而這就是擴散模型被稱為生成模型的原因。另外,隨著步驟越多,解析度或細節可以更高,每一次相同的關鍵字或輸入圖檔,經過模型輸出的結果都有著不確定性。

從二維到三維

當你以為畫奇幻插畫和二次元美少女就是極限了,最新進展絕對更令人大開眼界!

前陣子開發出來的模型,能讓使用者自己上傳作品或相同風格的畫風,來產出更多樣化的素材。例如不久前在日本被下架的 mimic;而 DALL-E 則推出 Outpainting 功能,例如輸入知名畫作,它會替其擴張圖片,算出可能的背景樣式。

DALL-E 算出知名畫作《戴珍珠耳環的少女》的可能背景樣式。圖/OpenAI

DALL-E 算出知名畫作《戴珍珠耳環的少女》的可能背景樣式。圖/OpenAI若再將繪圖 AI 訓練到不只能輸出圖片,甚至能輸出擬真的照片呢?已經有人這麼做了。

最近最紅的生成模型,可以把疫情期間我們一張張戴口罩的照片全自動 PS 出嘴巴鼻子、輕易更換穿搭風格等。新出的 AI 繪圖軟體 ControlNET,甚至只要提供骨架甚至幾個線條,就能繪出相同姿勢的人物圖像。

如果我們能夠生成無法辨別的真人外觀,再搭配已經有的 3D 骨架建模生成模型,豈不是可以達成科幻電影「虛擬偶像(Simone,2002)」的劇情,生成一個假演員來演戲拍廣告!

這些 AI 生成模型其實都只是為我們所用的工具,這波 AI 繪圖師的加入,肯定會大量取代中階以下的商用和插畫家的需求,並解決業主和設計師之間的溝通成本,各家美術或遊戲公司紛紛開出 AI 溝通師的職缺。追隨主流審美的人類繪師受創最深,而對已有強烈藝術風格的大師或非主流藝術家來說,目前相對不受影響。

使用 AI 完成的藝術作品。圖/GIPHY

使用 AI 完成的藝術作品。圖/GIPHYAI 繪圖工具的出現,掀起了一股巨浪。如今不僅有人能利用 AI 生成作品得獎,也開始能看到有人使用 AI 創作進行營利、販售。

然而創作領域中模仿、挪用、抄襲、致敬等等的問題在 AI 出現以前就是個難解之題,來到大生成時代,這類問題只會越來越多,我們又該如何面對它呢?

歡迎訂閱 Pansci Youtube 頻道 獲取更多深入淺出的科學知識!

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง