本篇文章将从技术角度出发,并以最近推出的苹果MR为例,分析AR世界里所需要依托的三个关键技术点:眼动追踪、手动识别和空间计算。让我们一起看看作者对这三个技术点的分析吧~

用眼睛看,用手操作,是我们在物理世界里再自然不过的交互方式了。但要在AR世界里延续这种自然交互,却需要依托的三个关键技术点。

Apple Vision Pro的发布没有让我们失望,在里面,我看到了这三个技术带给自然交互的力量。

一、眼动追踪技术

我们在现实中如果需要与哪个物体有进一步的交互,都会自然地将视线集中在它的身上,当我们耗费注意力让视线聚焦在它身上的时候,就已经代表了我们的选择。

这个过程涵盖了目前界面领域上的两个状态:激活态(聚焦)和点击态(选择)。眼动追踪技术,实现的是看到聚焦这个过程。

这个技术当然并不是首创。AR眼镜的先驱,Microsoft Holoens第2代的交互就主打了Eye-gaze,就是用眼睛来聚焦的功能。

而在之前,Microsoft Holoens第1代的头动(Head-gaze)交互其实也已经有用眼睛来看和激活的概念了。但Head-gaze里使用头部微微移动来控制屏幕中心的一个点(Gaze)来激活内容,和我们本来的自然交互始终是有差距的,因为实际上我们聚焦一个物体,并不需要每次都靠头动,靠眼睛动就行了。

不过,虽然眼动追踪技术更解决自然交互的标准,但头动交互并不是没有可取之处,比如我团队目前自研的眼镜还只能支持Head-gaze交互。这种交互手段的成本和技术难度更低,比起用手/鼠标/遥控器等去聚焦激活的方式,它更加贴近我们用眼睛看这个自然交互理念。

另外,眼动追踪技术实现了激活态,却还没真正实现选择,也就是那个点击态。作用是告诉机器我确认是它了。

严格来说,对于不需要操作的东西,省去手这个确认操作是很有必要的。比如,我一边吃零食一边追剧的时候,就很希望不用每次操作前都要擦一擦我的脏手……在制造领域,类似这种解放双手的需求也经常被客户提出。

为了更自然的交互,也许这也可以成为我们畅想的一部分。之前我写过一个专利,就是靠脑电波技术来进行简单的确认。

二、手势识别技术

眼动追踪满足用眼睛看这部分的交互,用手操作,则需要手势识别技术。

这也不是什么新技术了,之前很多ARVR的设备上都有搭载,当然实现程度还要实际体验再确认。

Vision Pro的宣传视频里,手势识别看上去很自然,手甚至都不需要抬起来,这应该是依靠4组下视角相机(这大概也是需要12个摄像头配置的原因之一吧)。

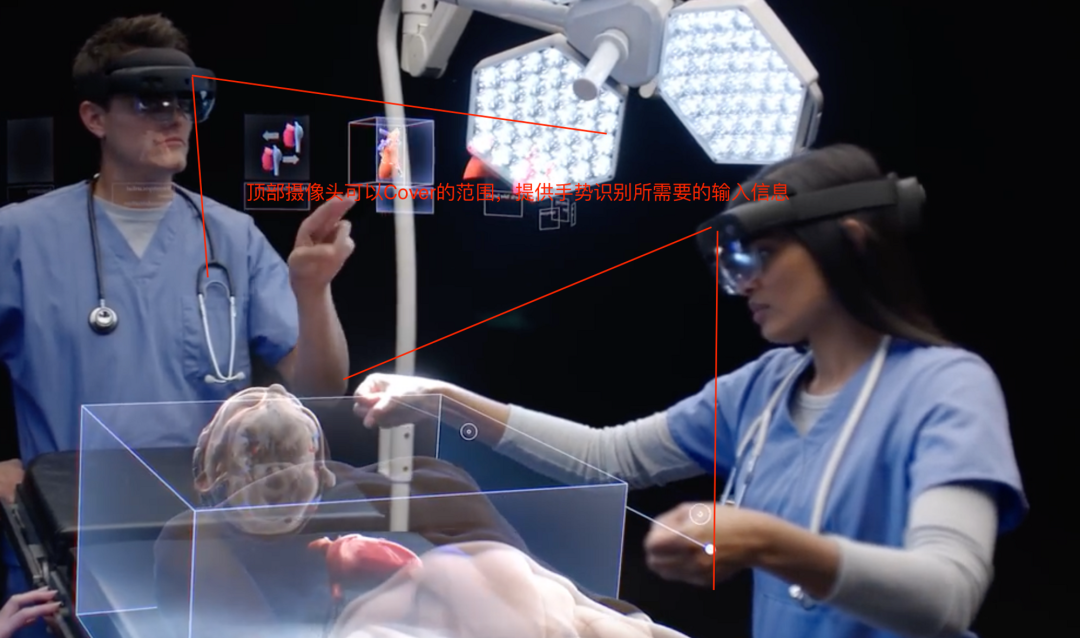

相比Hololens2的宣传视频,可以看出手势是在头顶摄像头涵盖范围的。

因为手势识别是需要依托摄像头的(计算机需要输入才能知晓你的手在怎么动),那么同样的手势从不同角度拍摄的结果就不一样,识别的结果也会受到影响。

另外,2D手势识别和3D手势识别技术的体验感也不太一样。

三、空间计算

要让眼睛看得更爽,用手操作得更自然,设备需要有对空间的理解能力。空间计算,也是Vision Pro想主推的,对于这个能力的注重,让他们认为这块能力可以划分一个时代。

“空间计算时代”。

没有空间计算能力,也就是如果机器不能理解空间的话,很多交互都自然不起来。我们现在所听到的Nerf、SLAM、3DOF、6DOF,都属于空间计算技术的一员。

从体验角度来说,空间深度所带来的物体之间、物体与用户之间的距离感知; 用户在不同位置和姿态下的视角朝向所带来的物体形状变化;真实环境中因时间和天气等光线不同所导致的色彩感知变化;甚至不同空间位置所传来的声音等,空间计算能给予设计师更多自然交互的空间。

可以说,空间计算,是能让AR在未来,成为不同于普通屏幕界面的、我们真正所期待的“凡所看之处,皆可成为界面”的关键技术。

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง