Cognitive Architectures for Language Agents

T Sumers, S Yao, K Narasimhan, T L. Griffiths

[Princeton University]

语言Agent的认知架构

要点:

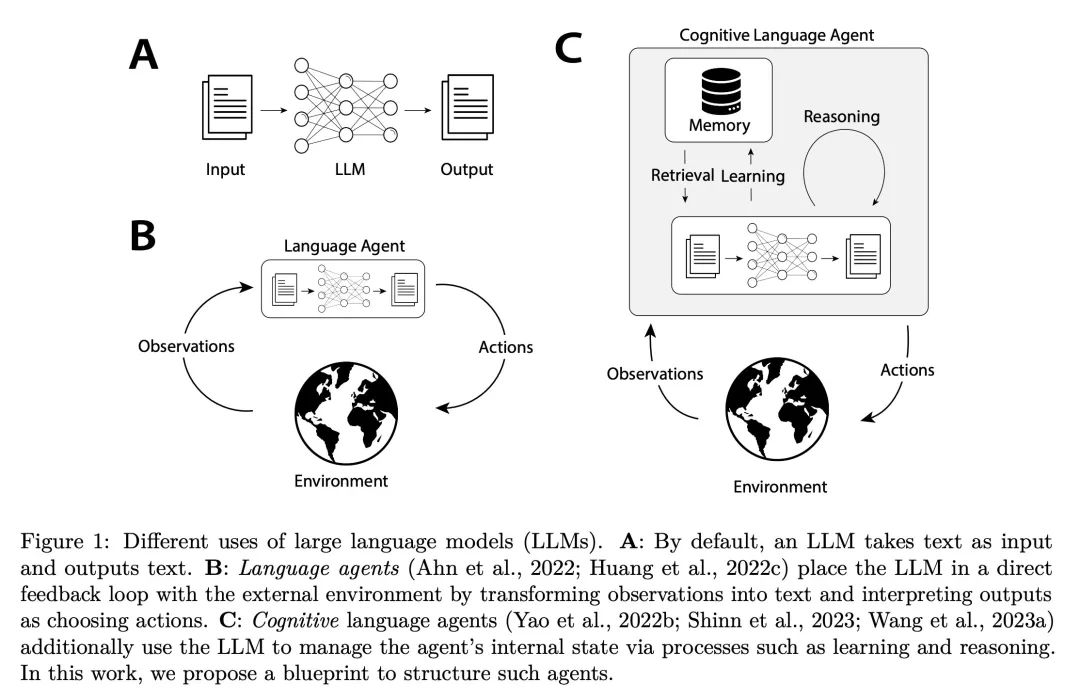

- 大型语言模型(LLM)与符号AI中的经典概念产生系统具有类比关系,正如产生系统重写字符串,LLM定义了对文本扩展的分布。

- 提示策略可以看作是在LLM上施加算法控制流,类似于如何将产生系统扩展成完整Agent的认知架构。

- 这暗示LLM可以融入认知架构,具有记忆、学习、推理和决策模块。

- 提出认知语言Agent架构(CoALA)作为设计LLM智能体的框架,灵感来自如Soar等符号架构,但适应利用LLM的优势。

- CoALA将智能体结构化为工作记忆、情节记忆、语义记忆和程序记忆,定义了内部推理和外部设定动作。

- CoALA提供了将LLM扩展成具有规划、学习和开放式改进能力的完全自主Agent的蓝图,也阐明了安全性考量。

- 该框架有助于系统地表征和比较最近的交互式LLM Agent,强调了未来方向,如长期记忆、学习新技能和审慎规划。

动机:在使用大型语言模型(LLM)进行自然语言处理时,存在对外部环境的世界知识有限以及缺乏理论框架的问题。本论文旨在借鉴符号人工智能的智能体设计历史,为构建更强大的语言智能体提供一个系统性的框架。

方法:结合了生产系统和认知架构的概念,将LLM与生产系统进行类比,并提出认知语言智能体(CoALA)的概念框架,用于系统化地组织LLM的推理、基础、学习和决策等方法。

优势:通过引入认知架构的思想,提供了一种设计和构建更强大的语言智能体的方法,并为未来的工作指明了方向。

一句话总结: 提出一种基于认知架构的语言智能体的概念框架,将大型语言模型与生产系统进行类比,系统化地组织了LLM的推理、基础、学习和决策等方法。

https://arxiv.org/abs/2309.02427

正文完

可以使用微信扫码关注公众号(ID:xzluomor)

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง