新智元报道

编辑:Aeneas 好困

【新智元导读】Wayve推出的LINGO-1,让自动驾驶长嘴了!这车该怎么开,它自个给自个解说,大语言模型,再也不是黑盒了。

自发明以来,自动驾驶最让人担心之处,莫过于人类无法知道它的脑子里到底在想些什么。

今天开始,它居然可以把自己的想法「讲出来」了?

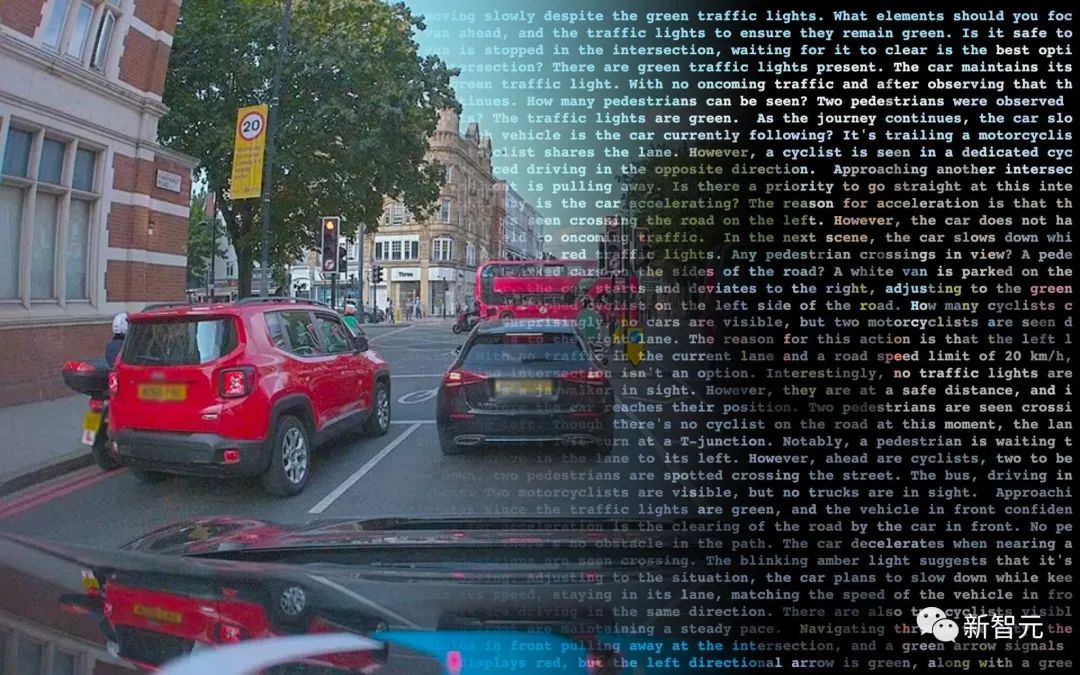

最近,Wayve推出了基于视觉语言行动的大模型(VLAMs)的自动驾驶交互大模型LINGO-1,把大语言模型和自动驾驶进行了深度融合。

具体来说,LINGO-1训练了一个视频语言模型,它可以说是相当有个性——可以对眼前正在进行的场景发表评论!

-你在干嘛? -我在小心翼翼地穿越车流,因为目前路面情况很复杂。

-你在干嘛? -我在小心翼翼地穿越车流,因为目前路面情况很复杂。

-下一步你打算要做什么? -我要准备左转了。

-眼前的场景中有哪些潜在风险? -信号灯,骑自行车的人,过马路的行人

你对智驾系统的疑惑,它统统给你解释清楚。

问:为什么停下了?答:因为现在是红灯。

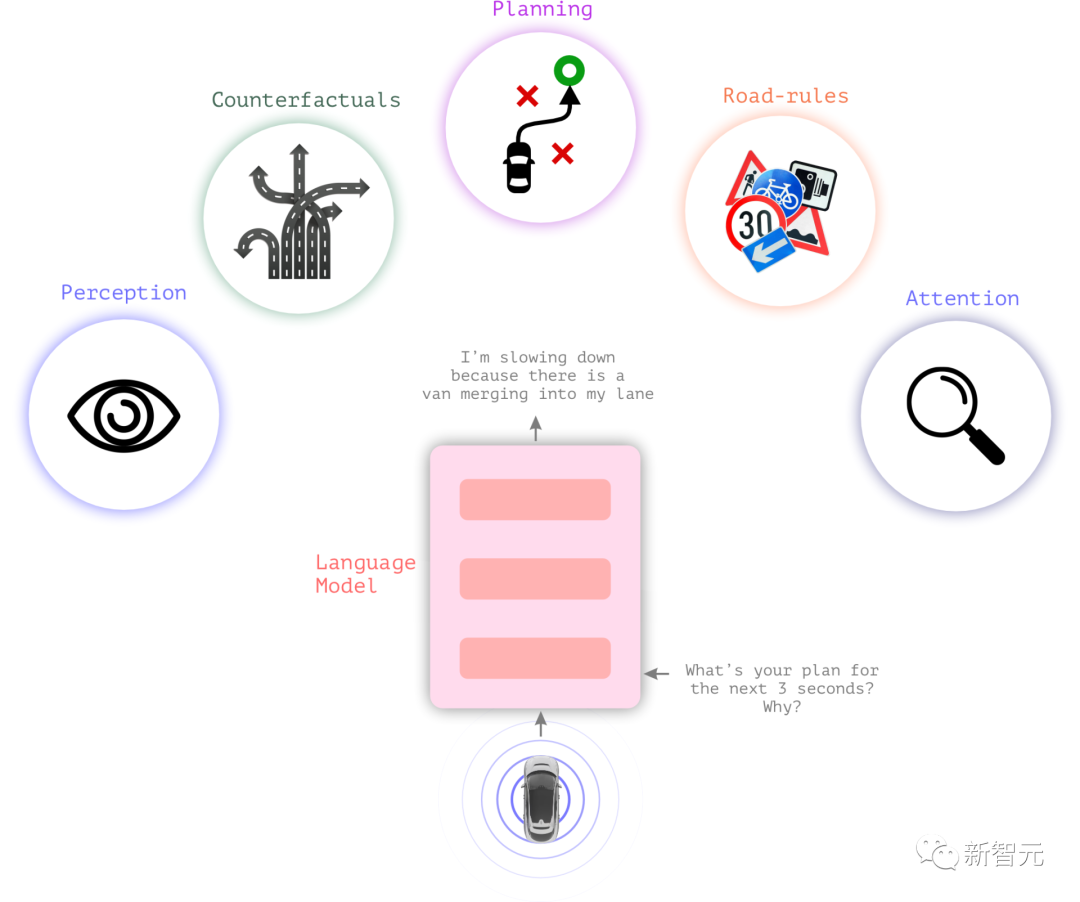

在经过各种视觉和语言数据的训练之后,LINGO-1不仅可以执行视觉问答(VQA)任务,如感知、反事实、规划、推理和注意力,而且还能对驾驶行为和推理进行描述。

也就是说,我们可以通过对LINGO-1进行提问,来了解影响驾驶决策的因素是什么。

网友感慨道:「端到端的黑盒,就这么被打开了,简直是GPT时代的大力出奇迹。自动驾驶系统离真实的物理世界交互,又前进了一大步。」

可以想象,随着我们突破具身人工智能的界限,视觉-语言-行动模型将产生巨大的影响,因为语言提供了一种新的模式,来增强我们解释和训练自动驾驶模型的方式。

自动驾驶车里进来一个捧哏的?

LINGO-1中的独特之处在于引入了一个人类专家,对驾驶场景的语言评论解说数据进行训练,让模型把环境感知、行动决策和类人的场景解读联系在一起。

这样,它就可以通过自然语言交互,来解读自动驾驶系统的决策和行动了。

英伟达高级AI科学家Jim Fan兴奋地点评道:这是我近期读到的自动驾驶领域最有趣的作品!

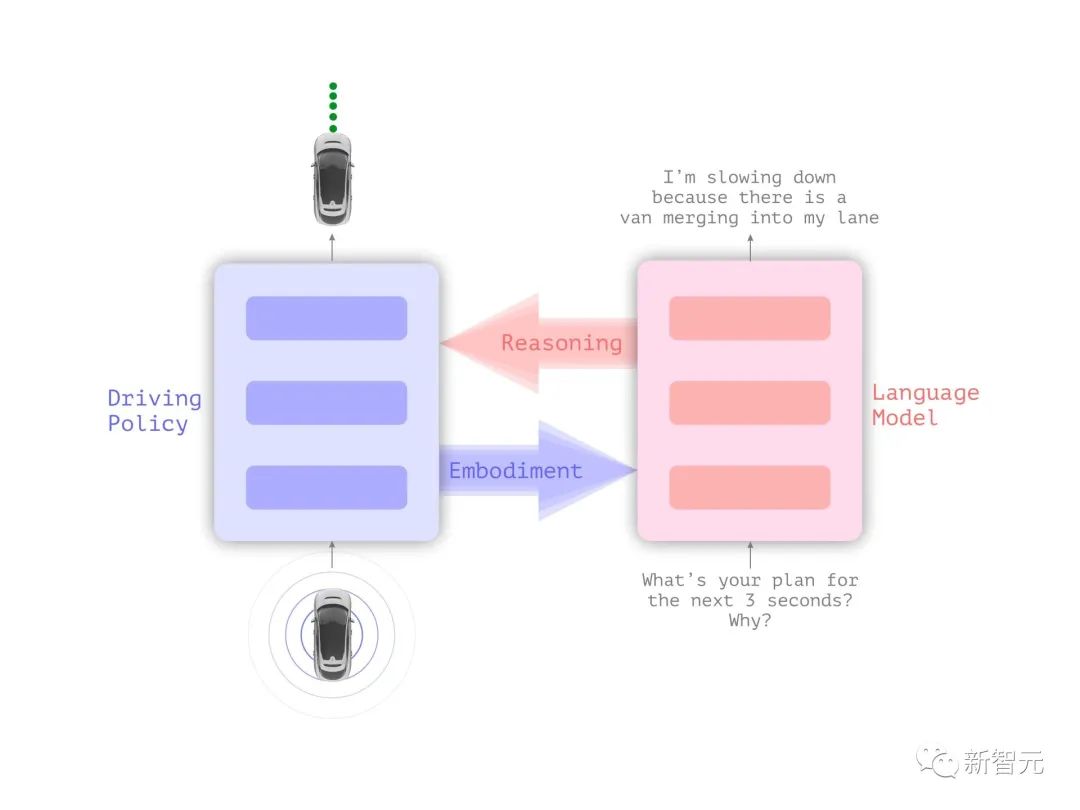

从前的自动驾驶,是「感知 -> 驾驶操作」,而以后的自动驾驶,加进了推理的这一步,是「感知->文字推理->行动」。

这个新加的显式推理步骤,有哪些优点?Jim Fan解释如下——

– 可解释性:驾驶模型不再是一个神秘的黑盒。

– 反事实情景:它能够想象出训练数据中没有的场景,并推理出如何正确地进行处理。

– 长尾编程:驾驶中存在大量边缘场景,要对所有场景进行良好的数据覆盖是不可能的。与其收集成千上万的示例来对一个案例进行「神经编程」,不如让人类专家编写提示(prompt)来解释少量的示例,从而指导系统如何处理特定或复杂的情景。

不仅如此,LINGO-1还和游戏人工智能领域的一些研究密切相关,比如MineDojo和思想克隆,它们都是AI智能体。

前者可以学习一种奖励模型,把评论文本和「我的世界」(Minecraft)游戏视频像素关联起来。后者可以实现「像素->语言->行动循环」的一整套链路。

LINGO-1——开环驾驶解说员

自个解说自个

模型在关注什么?在做什么?现在,这些都不是谜了。

LINGO-1会对你解释清楚,它的每一步行动是在干嘛。

比如它想超越一辆停在路边的车辆——

比如它想超越一辆停在路边的车辆——

LINGO-1:由于车流缓慢,我正在超车。

LINGO-1:我正在超越一辆停在路边的汽车。

LINGO-1:由于前方道路畅通,我正在加速。

驶近斑马线时——

LINGO-1:我正在保持车速;道路仍然畅通无阻。 LINGO-1:现在正在刹车减速。 LINGO-1:在斑马线处停下。 LINGO-1:我正在从停止的位置加速。LINGO-1:我正在加速,因为道路通畅。

在十字路口左转时——

LINGO-1:我保持不动,因为前车也停了下来。 LINGO-1:我正在加速,因为前车已经驶离。 LINGO-1:我正在踩刹车,准备在路口停车。 LINGO-1:我正在前进,因为车道畅通。 LINGO-1:完成左转,沿着路线行驶。

视觉问答(VQA)

除了能解说自个儿,LINGO-1还能针对你的提问进行答疑,让我们能够评估它的场景理解和推理能力。 比如,如果问LINGO-1,在这个十字路口要注意什么?它会说:「我得注意前面的信号灯、我前面骑自行车的人和正在穿过道路的行人。」

比如,如果问LINGO-1,在这个十字路口要注意什么?它会说:「我得注意前面的信号灯、我前面骑自行车的人和正在穿过道路的行人。」 问一下LINGO-1,现在是什么天气?会对驾驶产生什么影响?它会说:「现在是雨天,我开车时需要极其小心,因为雨天路面湿滑,能见度降低。」

问一下LINGO-1,现在是什么天气?会对驾驶产生什么影响?它会说:「现在是雨天,我开车时需要极其小心,因为雨天路面湿滑,能见度降低。」 LINGO-1,你该怎样安全地和自行车并排行驶?它会说:「我得和骑自行车的人保持距离,必要的时候停下来,它是一个潜在危险。另外路边停的车我也得注意。」

LINGO-1,你该怎样安全地和自行车并排行驶?它会说:「我得和骑自行车的人保持距离,必要的时候停下来,它是一个潜在危险。另外路边停的车我也得注意。」

关键:驾驶解说数据集

开发LINGO-1的关键,就在于创建一个可扩展的多样化数据集。这个数据集包含了专业驾驶员在英国各地驾驶时的解说,包括图像、语言和行动数据。这让我们想起在驾校时跟教练学开车时的场景——他们会不时发表类似下面这样的评论和解说,解释自己在驾驶时为什么要有这种行为,好让学员们举一反三。

– 前方车辆/交通信号灯有变,请减速 – 现在该变换车道了 – 可以加速了,注意不要超过最高限速 – 注意!其他车辆驶入道路/停在十字路口了 – 注意前方环岛和让路标志 – 前方有停放车辆/交通信号灯/学校 – 旁边车辆正在变道/超过停在路边的车辆 – 骑车的人/行人正在斑马线上等候当以上这些语句和感官图像、底层驾驶动作在时间上同步时,研究者就得到了丰富的视觉-语言-行动数据集,可以用于训练各种任务的模型。

视觉-语言-行动模型(VLAM)

LLM崛起后,许多视觉语言模型(VLM)都将LLM的推理能力与图像和视频相结合。而Wayve进一步推出了视觉-语言-行动模型(VLAM),包含三种信息——图像、驾驶数据和语言。以前,在机器人训练(尤其自动驾驶领域)中,很少会用到自然语言。如果加进了自然语言,就会让我们更有力地解释和训练基础驾驶模型,这种崭新的模式会产生巨大的影响。通过用语言来解释驾驶场景中的各种因果因素,就可以加快模型的训练速度,推广到全新的场景中。而且,既然可以向模型问问题,我们就能知道模型究竟理解了什么,它的推理和决策能力有多强。自动驾驶系统也不再是个神秘的黑盒,我们开车时可以时不时地问问它:你在想啥?这无疑会提高大众对自动驾驶的信任。

另外,虽然只有少量的训练样本,但自然语言的快速学习能力,可以让模型迅速高效地学习新任务、适应新场景。比如,只要我们用自然语言告诉模型「这种行为不对」,就能纠正自动驾驶系统的错误行为。从此,或许只需要自然语言,就能为端到端自动驾驶建立基础模型了!

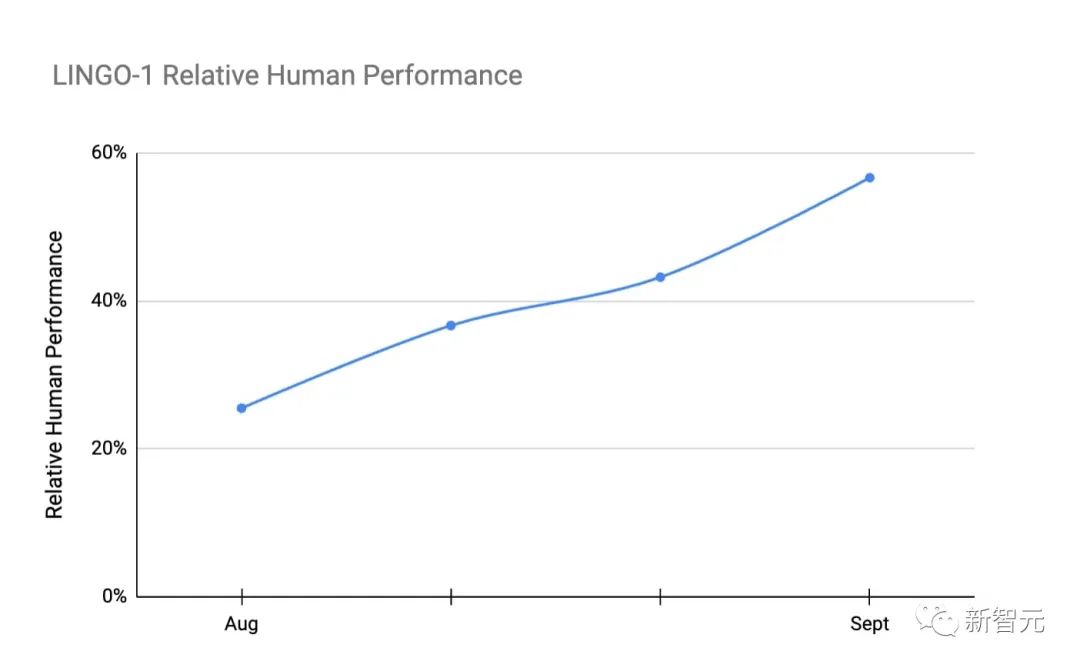

准确率60%

这段时间,团队一直在对模型架构和训练数据集进行改进。从图中不难看出,LINGO-1的性能相比于最开始已经提高了一倍。目前,LINGO-1的准确率已经达到了人类水平的60%。 显然,自然语言的引入,可以在多个方面彻底改变自动驾驶技术。

显然,自然语言的引入,可以在多个方面彻底改变自动驾驶技术。

提高端到端模型的可解释性

机器学习模型缺乏可解释性的问题,一直以来都是研究的焦点。通过创建基于自然语言的交互界面,可以让用户直接进行提问并让AI解答,从而深入了解模型对场景理解以及是如何做出决策的。这种乘客与自动驾驶汽车之间的独特对话,可以提高透明度,让人更容易理解和信任这些系统。同时,自然语言还能增强模型适应人类反馈并从中学习的能力。就像教练指导学生驾驶一样,随着时间的推移,纠正指令和用户反馈可以完善模型的理解和决策过程。

更好的规划和推理,提高驾驶性能

有两个主要的因素会影响自动驾驶性能:1. 语言模型准确解释各种输入模式场景的能力2. 模型将中层推理转化为有效底层规划的熟练程度对此,团队正在尝试通过LINGO的自然语言、推理和规划能力,来对闭环驾驶模型进行增强。

Wayve LINGO-1闭环自动驾驶模型

新场景或长尾场景的高效学习

平时,一张图片胜过千言万语。但在训练模型时,是一段文字胜过千幅图片。现在,我们不再需要成千上万个汽车为行人减速的示例,只需要几个示例,配上简短的文字说明,就可以教会模型减速,让它学会在这种情况下应该如何行动,应该考虑什么。要知道,在自动驾驶中,最重要的部分之一就是因果推理,它能让系统理解场景中元素和行为之间的关系。一个性能良好的VLAM,可以让系统将在斑马线上等待的行人与「请勿穿越」的交通信号牌联系起来。这种数据有限的挑战性场景中极有意义。另外,LLM早已从互联网数据集中掌握了大量人类行为知识,因此能够理解识别物体、交通法规和驾驶操作等概念,比如树、商店、房子、追逐球的狗和停在学校门口的公交车之间的区别。通过VLAM对图形数据更广泛的信息编码,自动驾驶会变得更先进、更安全。

局限性

当然,LINGO-1也存在着一定的局限性。

泛化

LINGO-1是根据伦敦市中心的驾驶经验和互联网规模的文本进行训练的。虽然已经学到了全世界的驾驶文化,但目前最擅长的还是对英国的交通法规进行解读。它还需要学习其他国家的驾驶经验。

幻觉

在大语言模型中,幻觉是一个众所周知的问题,LINGO-1也不例外。不过比起一般LLM,LINGO-1有一个优势:因为以视觉、语言和行动为基础,它就有了更多的监督来源,从而可以更好地理解世界。

上下文

视频深度学习之所以具有挑战性,是因为视频数据通常比图像或文本数据集大几个数量级。基于视频的多模态语言模型尤其需要较长的上下文长度,以便能够嵌入许多视频帧,来推理复杂的动态驾驶场景。

闭环推理

目前,Wayve正在研究模型的可解释性,但最终,他们LLM的推理能力能够真正影响到人类的驾驶。研究者正在开发一种闭环架构,未来能在自动驾驶车辆上运行LINGO-1。

网友讨论

对此,网友们也觉得很振奋人心。「有趣的是,我认为语言模型是用文字解释了驾驶控制模型的转向、制动和油门预测,而不是影响驾驶本身,因为自然语言会丢失所需的精度。」 「通过这种方法,我们正在非常接近AGI。」「可以认为它是在世界模型中添加语言。我一直不明白为什么以前从未尝试过,因为训练Agent进行沟通这个想法似乎大家都能想到。」

「通过这种方法,我们正在非常接近AGI。」「可以认为它是在世界模型中添加语言。我一直不明白为什么以前从未尝试过,因为训练Agent进行沟通这个想法似乎大家都能想到。」 「从单纯的感知行动到添加文本推理,这种转变改变了游戏规则!在我看来,这正是自动驾驶中缺失的部分,因为它以非技术性的方式使可解释性成为可能。」

「从单纯的感知行动到添加文本推理,这种转变改变了游戏规则!在我看来,这正是自动驾驶中缺失的部分,因为它以非技术性的方式使可解释性成为可能。」 目前来说,机器人训练与自然语言的整合,仍处于早期阶段。而LINGO-1,正式在利用自然语言加强基础驾驶模型的学习和可解释性上,迈出的重要一步。试想一下,以后我们只需要通过简单的文字提示,就能让AI告诉前面的路况,或者让AI学习不同地区的交通法规,这个场景简直太令人激动了!因此,自然语言在开发更安全、更可靠的自动驾驶汽车方面,一定大有可为。参考资料:https://wayve.ai/thinking/lingo-natural-language-autonomous-driving/?continueFlag=94beb9def3b2abc69ded207e71ffda33

目前来说,机器人训练与自然语言的整合,仍处于早期阶段。而LINGO-1,正式在利用自然语言加强基础驾驶模型的学习和可解释性上,迈出的重要一步。试想一下,以后我们只需要通过简单的文字提示,就能让AI告诉前面的路况,或者让AI学习不同地区的交通法规,这个场景简直太令人激动了!因此,自然语言在开发更安全、更可靠的自动驾驶汽车方面,一定大有可为。参考资料:https://wayve.ai/thinking/lingo-natural-language-autonomous-driving/?continueFlag=94beb9def3b2abc69ded207e71ffda33

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง