新智元报道

编辑:LRS 好困

【新智元导读】不怕多视角图像变化大,MVDiffusion整合图片全局意识,内容一致性更高!

逼真的图像生成在虚拟现实、增强现实、视频游戏和电影制作等领域有广泛应用。

随着扩散模型(Diffusion Models)在近两年的快速发展,图像生成取得了很大突破,从Stable Diffusion衍生出的一系列根据文本描述产生图像的开源或商业模型已经对设计、游戏等领域产生了巨大影响。

然而,如何根据给定的文本或其他条件,产生高质量的多视角图像(multiview images)仍然是一个挑战,已有的方法在多视图一致性上存在明显的缺陷。

目前常见的方法可以大致分为两类。

第一类方法致力于生成一个场景的图片以及深度图,并得到对应的mesh,如Text2Room,SceneScape——首先用Stable Diffusion生成第一张图片,然后使用图像扭转(Image Warping)和图像补全(image inpainting)的自回归方式生成后续的图片以及深度图。

但是,这样的方案容易导致错误在多张图片的生成过程中逐渐累积,并且通常存在闭环问题(比如在相机旋转一圈回到起始位置附近时,生成的内容与第一张图片并不完全一致),导致其在场景规模较大或图片间视角变化较大时的效果欠佳。

第二类方法通过拓展扩散模型的生成算法,并行生成多张图片以产生比单张图片更丰富的内容(如产生360度全景图,或将一张图片的内容向两侧无限外推),如MultiDiffusion和DiffCollage。但是,由于没有考虑相机模型,这类方法的生成结果并不是真正的全景图。

MVDiffusion的目标是产生内容上严格符合给定的相机模型,且全局语义统一的多视角图片。其方法的核心思想是同步去噪(simultaneous denoising)和基于图片之间对应关系(correspondence)的一致性学习。

论文链接:https://arxiv.org/abs/2307.01097

项目网站:https://mvdiffusion.github.io/

Demo: https://huggingface.co/spaces/tangshitao/MVDiffusion

代码:https://github.com/Tangshitao/MVDiffusion

发表会议:NeurIPS(spotlight)

MVDiffusion的目标是产生内容高度一致且全局语义统一的多视角图片,其方法的核心思想是同步去噪(simultaneous denoising)和基于图片之间对应关系的全局意识(global awareness)。

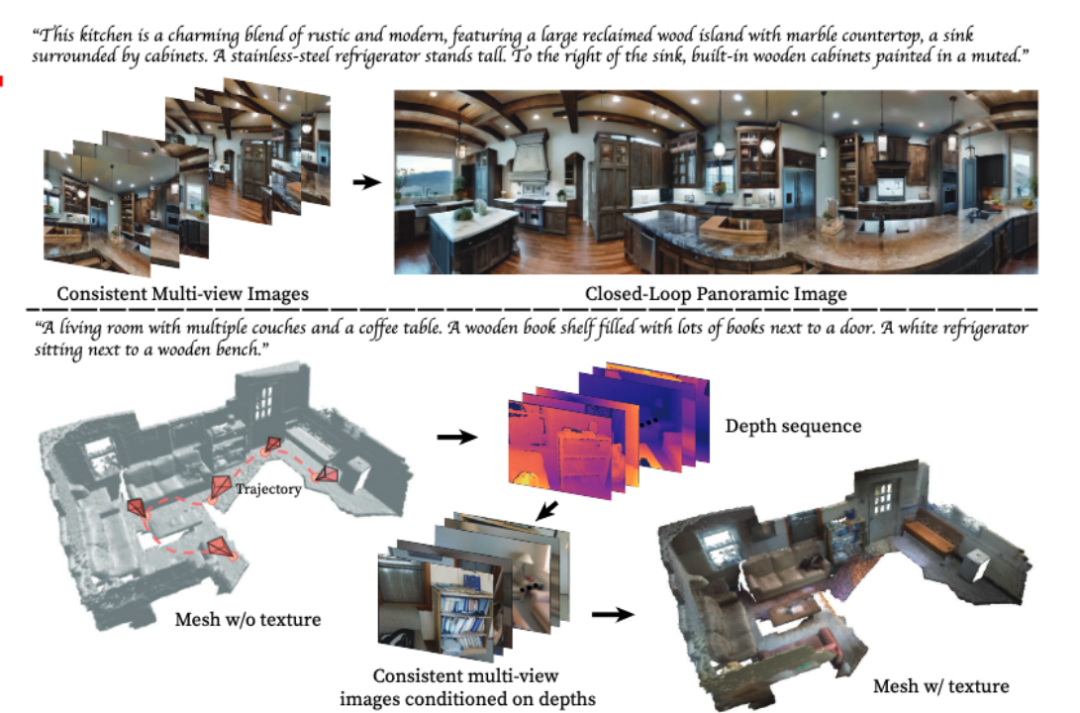

具体地,研究人员对已有的文本-图片扩散模型(如Stable Diffusion)进行拓展,首先让其并行地处理多张图片,并进一步在原本的UNet中加入额外的「Correspondence-aware Attention」机制来学习多视角间的一致性和全局的统一性。

通过在少量的多视角图片训练数据上进行微调,最后得到的模型能够同步生成内容高度一致的多视角图片。

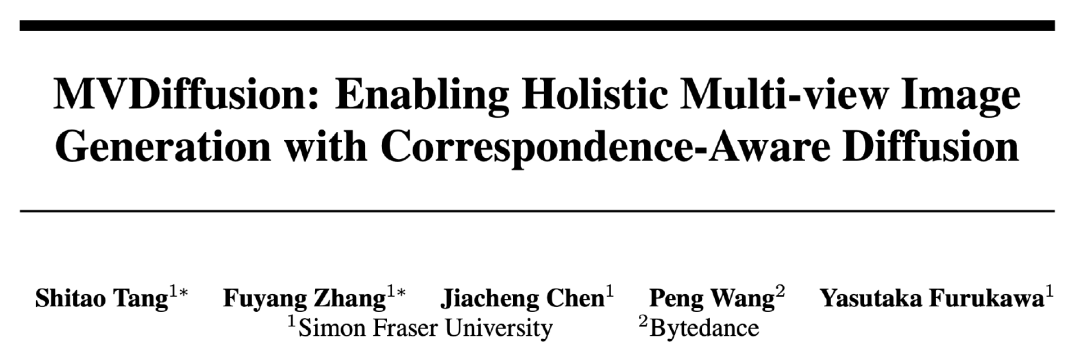

MVDiffusion已经在三种不同的应用场景取得了良好的效果:

1. 根据文字生成多视图以拼接得到全景图;

2. 将透视图像外推(outpainting)得到完整的360度全景图;

3. 为场景生成材质(texture)。

应用场景展示

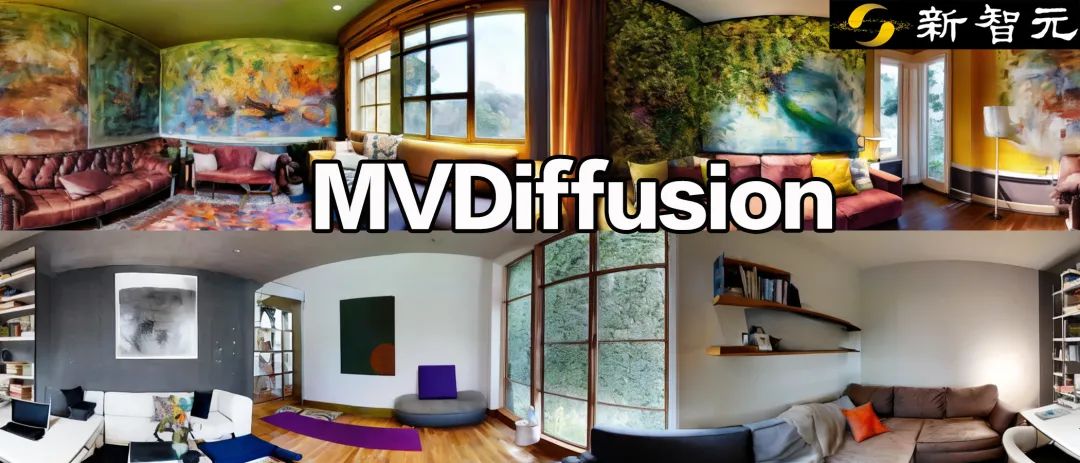

应用1:全景图生成(根据文字)

以生成全景图(panorama)为例,输入一段描述场景的文字(prompt),MVDIffusion能生成一个场景的多视角图片。

如输入「This kitchen is a charming blend of rustic and modern, featuring a large reclaimed wood island with marble countertop, a sink surrounded by cabinets. To the left of the island, a stainless-steel refrigerator stands tall. To the right of the sink, built-in wooden cabinets painted in a muted」,能得到以下8张多视角图片:

这8张图片能够拼接成一张全景图:

MVDiffusion也支持为每张图片提供不同的文字描述,但是这些描述之间需要保持语义上的一致性。

应用2:全景图生成(根据一张透视图像)

MVDiffusion能够将一张透视图像外推(outpainting)成完整的360度全景图。

比,如输入下面这张透视图:

MVDiffusion能进一步生成下面的全景图:

可以看到,生成的全景图在语义上对输入图片进行了扩展,而且最左和最右的内容是相连的(没有闭环问题)。

应用3:生成场景材质

给定一个无材质的场景mesh,MVDiffusion可以为其生成材质(texture)。

具体地,我们首先通过渲染mesh得到多视角的深度图(depth map),通过相机位姿(pose)以及深度图,我们可以获得多视角图片的像素之间的对应关系。

接着,MVDiffusion以多视角depth map作为条件,同步生成一致的多视角RGB图片。

因为生成的多视角图片能保持内容的高度一致,将它们再投回mesh,即可以得到高质量的带材质的mesh(textured mesh)。

更多效果示例

全景图生成

值得一提的是,在这个应用场景中,虽然训练MVDiffusion时用到的多视角图片数据都是来自室内场景的全景图,风格单一。

值得一提的是,在这个应用场景中,虽然训练MVDiffusion时用到的多视角图片数据都是来自室内场景的全景图,风格单一。

但是,由于MVDiffusion没有改变原本的Stable Diffusion的参数而只是训练了新加入的Correspondence-aware Attention。

最后,模型依然能根据给定的文本产生各种不同风格的多视角图片(如室外,卡通等)。

单视图外推

场景材质生成

具体方法介绍

我们将先介绍MVDiffusion在三个不同的任务中具体的图片生成流程,最后再介绍方法的核心,「Correspondence-aware Attention」模块。

图1:MVDiffusion概览

1. 全景图生成(根据文字)

MVDiffusion同步生成8张带有重叠的图片(perspective image),然后再将这8中图片缝合(stitch)成全景图。在这8张透视图中,每两张图之间由一个3×3单应矩阵(homographic matrix)确定其像素对应关系。

在具体的生成过程中,MVDiffusion首先通过高斯随机初始化生成8个视角的图片。

然后,将这8张图片输入到一个具有多分支的Stable Diffusion预训练Unet网络中,进行同步去噪(denoising)得到生成结果。

其中UNet网络中加入了新的「Correspondence-aware Attention」模块(上图中淡蓝色部分),用于学习跨视角之间的几何一致性,使得这8张图片可以被拼接成一张一致的全景图。

2. 全景图生成(根据一张透视图片)

MVDiffusion也可以将单张透视图补全成全景图。与全景图生成相同,MVDiffusion将随机初始化的8个视角图片(包括透视图对应的视角)输入到多分支的Stable Diffusion Inpainting预训练的UNet网络中。

不同的是,Stable Diffusion Inpainting模型中的UNet通过额外的输入掩码(mask)来区分作为条件的图片和将要生成的图片。

对于透视图所对应的视角,这个掩码是1,这个分支的UNet会直接恢复该透视图。对于其他视角,这个掩码是0,对应分支的UNet会生成新的透视图。

同样地,MVDiffusion使用「Correspondence-aware Attention」模块来学习生成图片与条件图片之间的几何一致性与语义统一性。

3. 场景材质生成

MVDiffusion首先基于深度图以及相机位姿生成一条轨迹上的RGB图片,然后使用TSDF fusion将生成的RGB图片与给定的深度图合成mesh。

RGB图片的像素对应关系可以通过深度图和相机位姿得到。

与全景图生成一样,我们使用多分支UNet,并插入「Correspondence-aware Attention」来学习跨视角之间的几何一致性。

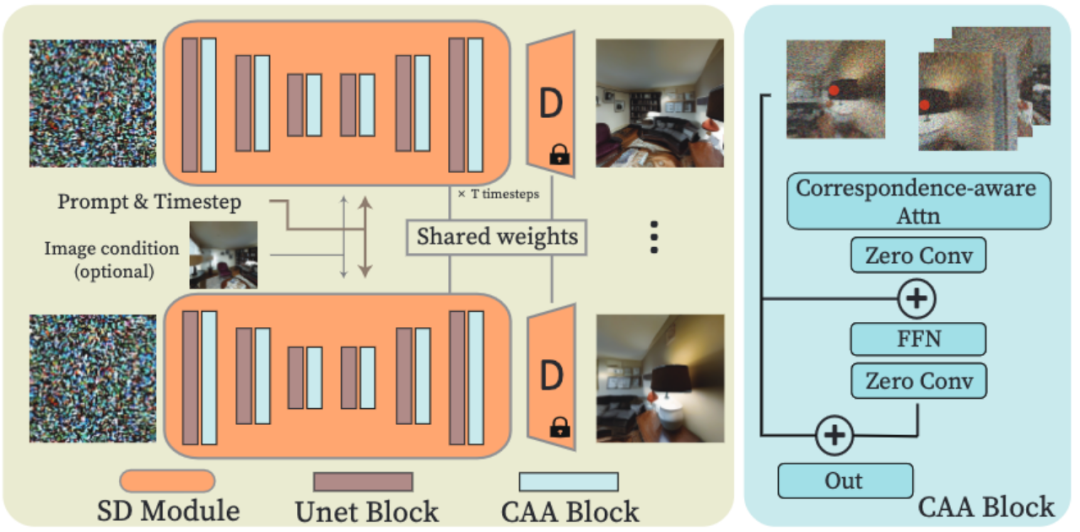

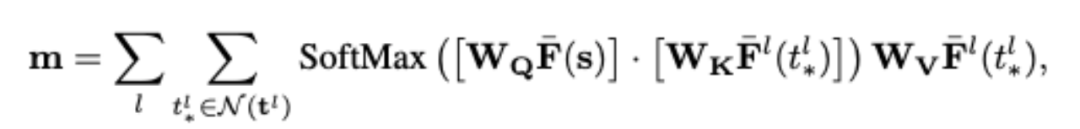

4. Correspondence-aware Attention机制

「Correspondence-aware Attention」(CAA),是MVDiffusion的核心,用于学习多视图之间的几何一致性和语义统一性。

MVDiffusion在Stable Diffusion UNet中的每个UNet block之后插入「Correspondence-aware Attention」block。CAA通过考虑源特征图和N个目标特征图来工作。

对于源特征图中的一个位置,我们基于目标特征图中的对应像素及其邻域来计算注意力输出。

具体来说,对于每个目标像素t^l,MVDiffusion通过在(x/y)坐标上添加整数位移(dx/dy)来考虑一个K x K的邻域,其中|dx|<K/2并且|dy|< K/2。

在实际使用中,MVDiffusion使用K=3,并选择9点的邻域来为全景图提高质量,而对于受几何条件限制的多视图图像生成,为了提升运行效率选择使用K=1。

CAA模块的计算遵循标准的注意力机制,如上图的公式所示,其中W_Q、W_K和W_V是query、key和value矩阵的可学习权重;目标特征不位于整数位置,而是通过双线性插值获得的。

关键的区别是基于源图像中的对应位置s^l与s之间的2D位移(全景)或1D深度误差(几何)向目标特征添加了位置编码。

在全景生成中(应用1和应用2),这个位移提供了本地邻域中的相对位置。

而在深度到图像生成中(应用3),视差提供了关于深度不连续或遮挡的线索,这对于高保真图像生成非常重要。

注意,位移是一个2D(位移)或1D(深度误差)向量,MVDiffusion将标准频率编码应用于x和y坐标中的位移。

参考资料:https://mvdiffusion.github.io/

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง