Meta AI 与 Inria 和索邦大学合作,共同开发了一种名为“Stable Signature”的隐形水印技术,用于识别由开源生成式 AI 模型创建的图像。这一技术通过在模型中嵌入水印,并将其与生成的图像相关联,防止水印被删除。与传统的水印方法不同,Stable Signature 的水印是与模型相关的,可以追溯到图像的创建者。

人工智能驱动的图像生成正在蓬勃发展,这是有充分理由的:它有趣、有趣且易于使用。虽然这些模型提供了新的创造性可能性,但它们可能会引起人们对坏人的潜在滥用的担忧,这些坏人可能会故意生成图像来欺骗人们。即使是以良好的乐趣创作的图像仍然可能走红,并可能误导人们。例如,今年早些时候,教皇弗朗西斯穿着一件华丽的白色蓬松夹克的图像在网上疯传。这些图像不是真实的照片,但很多人被愚弄了,因为没有任何明确的指标来区分内容是由生成性人工智能创建的。

在FAIR,我们对推动生成性人工智能的持续探索性研究感到兴奋,但我们也想确保我们以优先考虑安全和责任的方式这样做。今天,我们很高兴与Inria一起分享一篇研究论文和代码,详细介绍了Stable Signature,这是一种我们创建的隐形水印技术,用于区分何时由开源生成人工智能模型创建图像。隐形水印将信息融入到数字内容中。水印肉眼不可见,但算法可以检测到——即使人们编辑图像。虽然围绕水印还有其他研究,但许多现有方法在生成图像后创建水印。

根据Everypixel Journal的数据,已经使用三个开源存储库的模型创建了超过110亿张图像。在这种情况下,只需删除生成水印的行,即可删除不可见的水印。虽然这些保障措施存在的事实是一个开始,但这种简单的策略表明,利用此功能有很大的潜力。

我们今天分享的工作是为来自开源生成AI模型的图像添加水印的解决方案。我们正在探索这项研究如何可能用于我们的模型。为了与我们的开放科学方法保持一致,我们希望与人工智能社区分享这项研究,希望推进在这个领域所做的工作。

稳定签名方法的工作原理

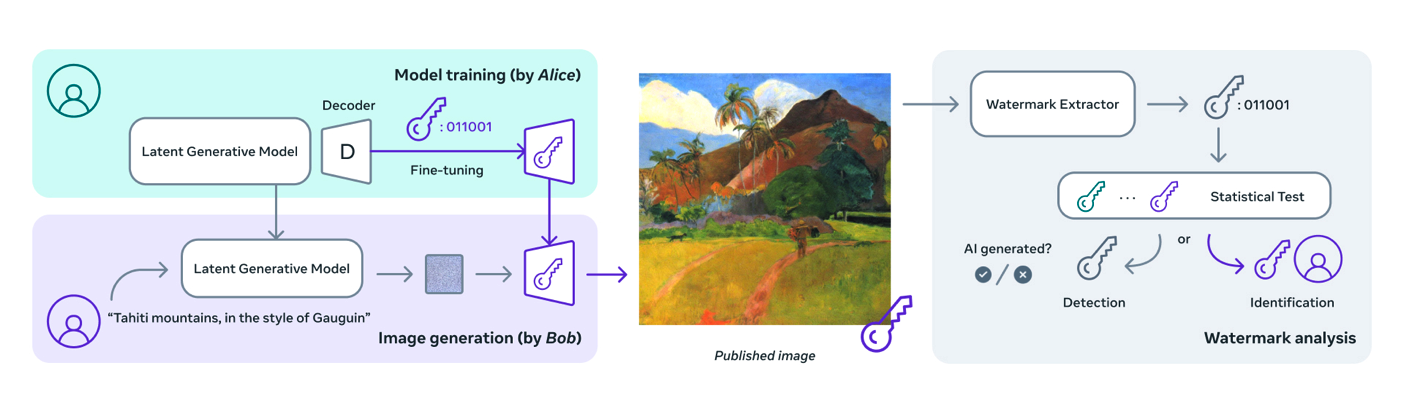

稳定签名通过在模型中用水印扎根来关闭去除水印的可能性,水印可以追溯到创建图像的地方。让我们看看这个过程如何与下面的图表一起工作。

这里训练了一个主生成模型。在分发之前,她对模型的一小部分(称为解码器)进行微调,为Bobroot给定的水印。此水印可以识别模型版本、公司、用户等。

鲍勃收到了他的模型版本,并生成了图像。生成的图像将带有鲍勃的水印。它们可以由Alice或第三方进行分析,看看图像是否由Bob生成,他使用了生成的AI模型。

我们通过两步过程实现这一目标:

- 首先,两个卷积神经网络被联合训练。一个将图像和随机消息编码为水印图像,而另一个则从水印图像的增强版本中提取消息。目标是使编码和提取的消息匹配。训练后,只保留水印提取器。

- 其次,生成模型的潜在解码器经过微调,以生成包含固定签名的图像。在此微调过程中,对批量图像进行编码、解码和优化,以尽量减少提取的消息和目标消息之间的差异,并保持感知图像质量。这个优化过程快速而有效,只需要小批量和短时间就能达到高质量的结果。

评估稳定签名的性能

我们知道人们喜欢分享和转发图像。如果鲍勃与10个朋友分享了他创建的图像,然后他们又与10个朋友分享了它呢?在此期间,有人可能会更改图像,例如通过裁剪、压缩或更改颜色。

我们构建了Stable Signature,以应对这些变化。无论一个人如何转换图像,原始水印都可能会保留在数字数据中,并且可以追溯到创建它的生成模型。

在我们的研究中,我们发现了稳定签名与被动检测方法相比的两大优势。首先,我们能够控制和减少假阳性的产生,当我们把人类生成的图像误认为是人工智能生成的图像时,就会发生假阳性。鉴于在线共享的非人工智能生成的图像很普遍,这一点至关重要。例如,最有效的现有检测方法可以发现大约50%的编辑生成的图像,但仍然产生大约1/100的假阳性率。

换句话说,在每天接收10亿张图像的用户生成内容平台上,大约1000万张图像将被错误地标记,以检测生成的图像的一半。另一方面,Stable Signature以10-10的假阳性率(可以设置为特定的预期值)检测具有相同精度的图像。此外,我们的水印方法允许我们从同一模型的不同版本中追踪图像——这是被动技术无法实现的功能。

稳定签名如何与微调配合

人工智能的一个常见做法是采用基本模型并对其进行微调,以处理有时甚至为一个人量身定制的特定用例。例如,可以向模特展示爱丽丝的狗的图像,然后爱丽丝可以要求模特在海滩上生成她的狗的图像。这是通过DreamBooth、Textual Inversion和ControlNet等方法完成的。这些方法在潜在模型级别起作用,它们不会改变解码器。这意味着我们的水印方法不受这些微调的影响。

总体而言,稳定签名与矢量量化图像建模(如VQGAN)和潜在扩散模型(如稳定扩散)配合良好。由于我们的方法不修改扩散生成过程,因此它与上述流行模型兼容。我们认为,通过一些调整,稳定签名也可以应用于其他建模方法。

提供对我们技术的访问

生成性人工智能的使用正在快速发展。目前,在整个行业中,没有任何通用标准来识别和标记人工智能生成的内容。为了构建更好的产品,我们认为责任研究的进步,就像我们今天分享的工作一样,必须并行存在。

我们很高兴分享我们的工作,并让人工智能研究社区访问这些工具,希望推动持续的协作和迭代。虽然生成性人工智能还处于早期阶段,但我们相信,通过分享我们的研究,与社区互动,并听取反馈,我们可以共同努力,确保这项令人印象深刻的新技术以负责任的方式构建、操作和使用。

我们今天分享的研究侧重于图像,但在未来,我们希望探索在更多生成的人工智能模式中集成我们的稳定签名方法的潜力。我们的模型适用于许多流行的开源模型,但仍然有局限性。它不会扩展到非潜在生成模型,因此它可能不是新一代技术的未来证明。通过继续投资这项研究,我们相信我们可以规划一个未来,即负责任地使用生成性人工智能来激发新的创造性努力。

这篇博客文章反映了Matthijs Douze和Pierre Fernandez的工作。我们要感谢Guillaume Couairon、Teddy Furon和Hervé Jégou对这项研究的贡献。

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง