丰色 发自 凹非寺

量子位 | 公众号 QbitAI

对标GPT-4代码解释器,港中大最新研究放了个“大招”:

他们开发了一个叫做MathCoder的大模型,数学能力直接在竞赛级“题库”Math上超过GPT-4。

△ 形象为羊驼是因为MathCoder底层模型来自羊驼家族

做到这一点靠的就是无缝集成代码的能力——

在遇到数学问题时,它不仅能用自然语言推理,还能自动编写和执行代码来建模、推导公式与方程。

这样的工作方式无疑和强大的GPT-4代码解释器一样。

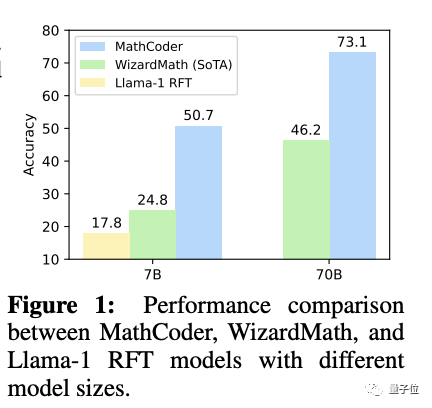

在实际评测中,MathCoder除了超过GPT-4,还顺利在MATH和GSM8K两大数据集上取得了开源LLM中的SOTA(打败了8月份才诞生的WizardMath)

这个“新王”究竟是如何诞生的?

对标GPT-4代码解释器

总的来看,港大这项研究为了提高大模型的数学推理能力,学习了GPT-4代码解释器的优点和工作原理,提出了一种微调开源语言模型的方法。

该方法最终使大模型无缝集成代码,利用代码来解决数学问题。

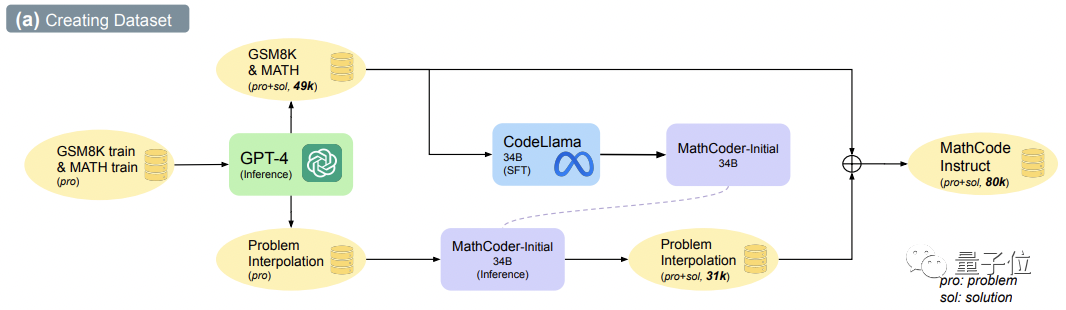

具体而言,他们首先提出了一个可以生成高质量数学题的数据集:MathCodeInstruct。

该数据集由两部分组成:

种子数据(D0):主要基于GSM8K和MATH,并利用GPT-4收集答案。

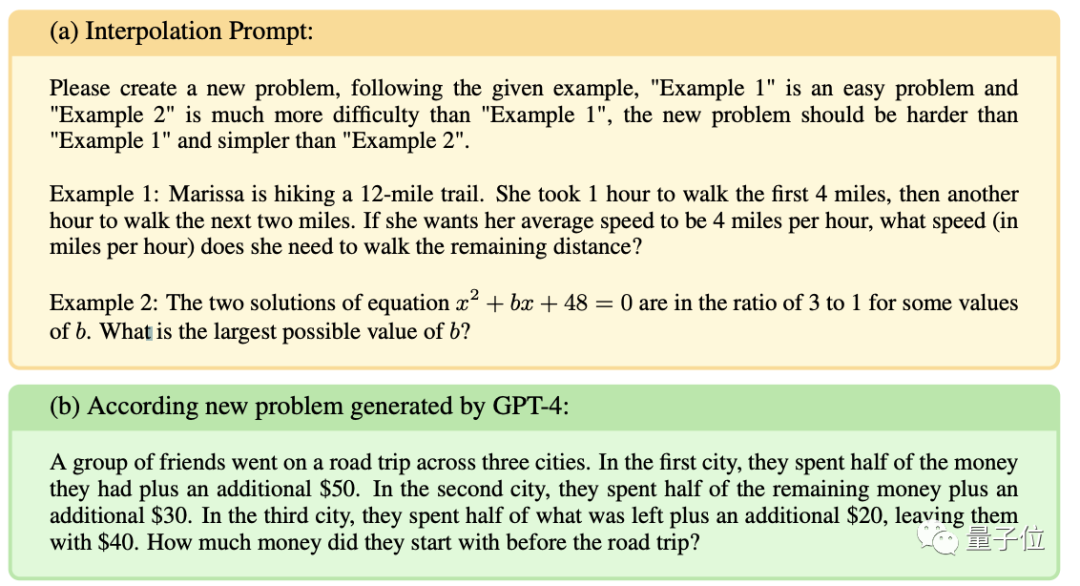

插值数据(D1):让GPT-4基于他们提出的一种叫做“问题插值提示”的方法生成。

如下图所示:

示例1和2分别来自于GSM8K和MATH,1简单,2难一些,GPT-4要做的“插值”就是生成比1难但比2更简单的新问题。

基于以上两类问题,最终MathCodeInstruct数据集一共收集了8万道数学题。

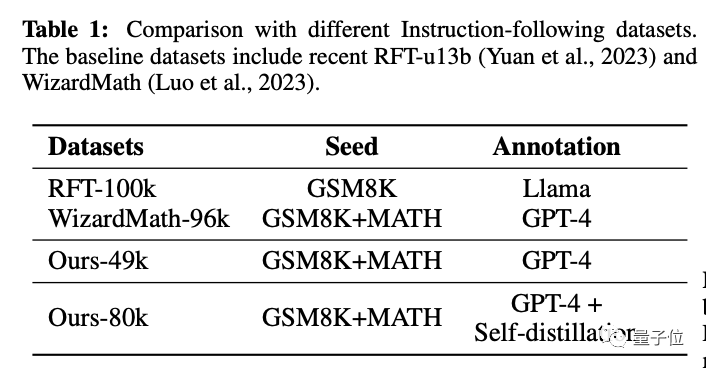

如下表所示,这比业内其他数据集规模稍小一些:

而与其他数据集相比,它的特点之一是同时弥补了GSM8K和MATH这两大重要数据集中不足的部分,给出了一些难度范围更广的问题,增强了数据集的泛化能力。

特点之二是数据集中的每道题目同时包含基于自然语言推理的部分+基于代码解决的部分(包括执行代码和代码输出结果)。

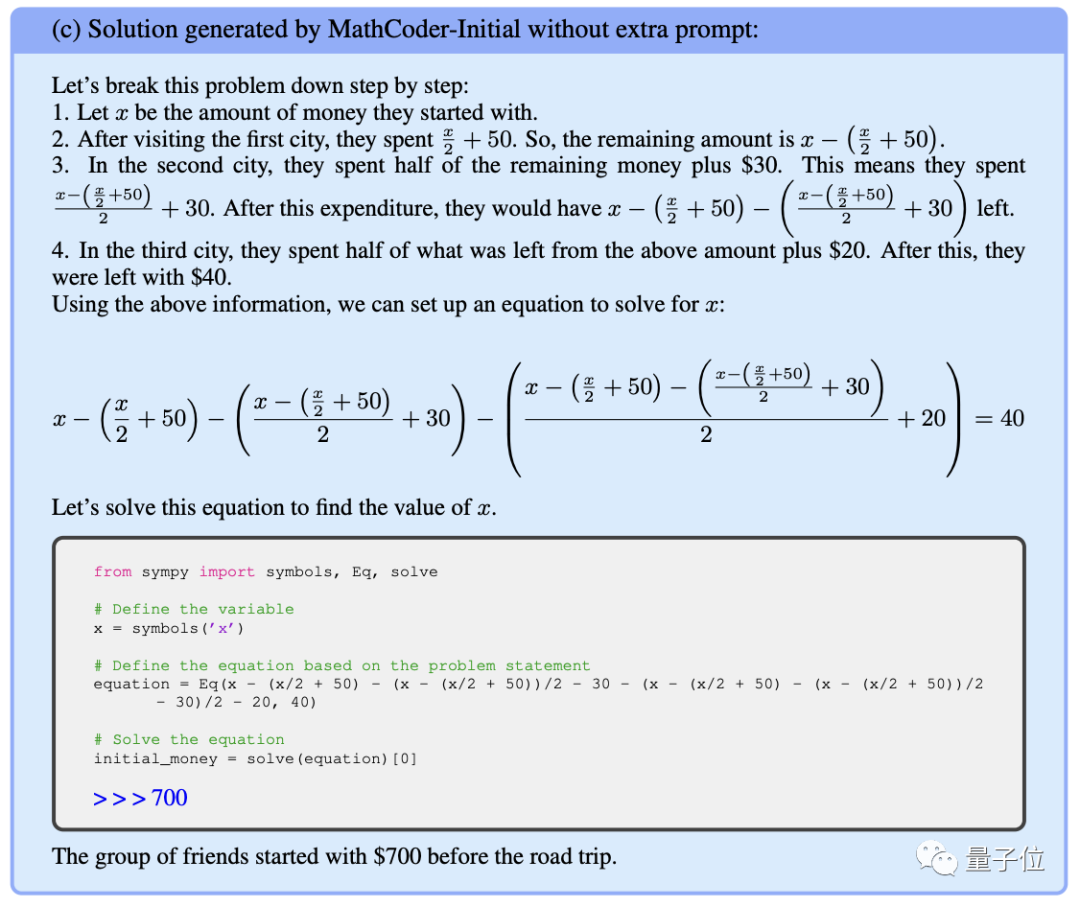

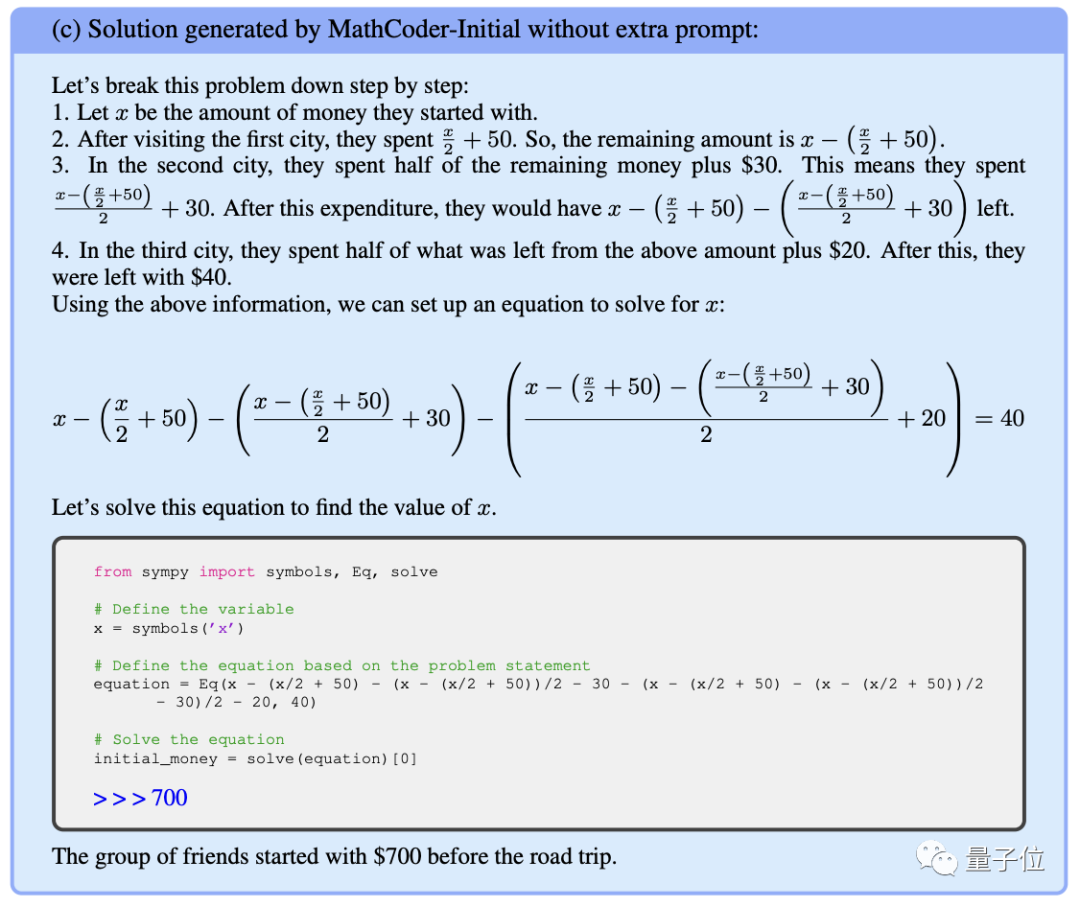

如下图所示,这是对上面GPT-4生成的“插值”问题的解决思路:

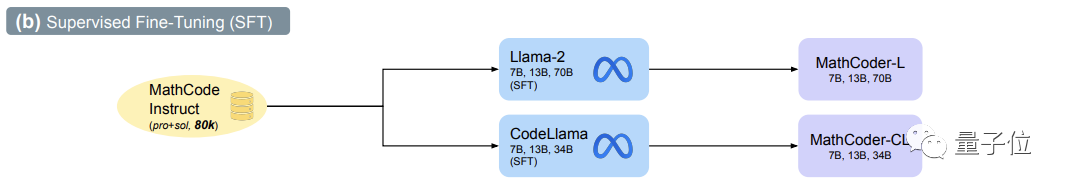

在数据集准备好以后,团队便提出了一种定制的监督微调和推理方法,最终在Llama-2和Code Llama上微调出了MathCoder。

具体而言,该方法使用特殊的token(<|text|>、<|code|>、<|execution|>)来识别训练数据集中哪一部分是自然语言、代码还是结果,让模型学习生成由这些特殊标记划分的自然语言和代码。

在推理期间,该方法还会将动态执行的结果附加到模型的先前预测中。

然后,继续基于这个新版本的输入自回归预测下一个token,以及最后的执行结果。

作者表示,通过这种方式,模型将能够“看到”执行结果,并不断地继续推理。

最终,该方法使微调模型MathCoder以类似GPT-4代码解释器的方式运行。

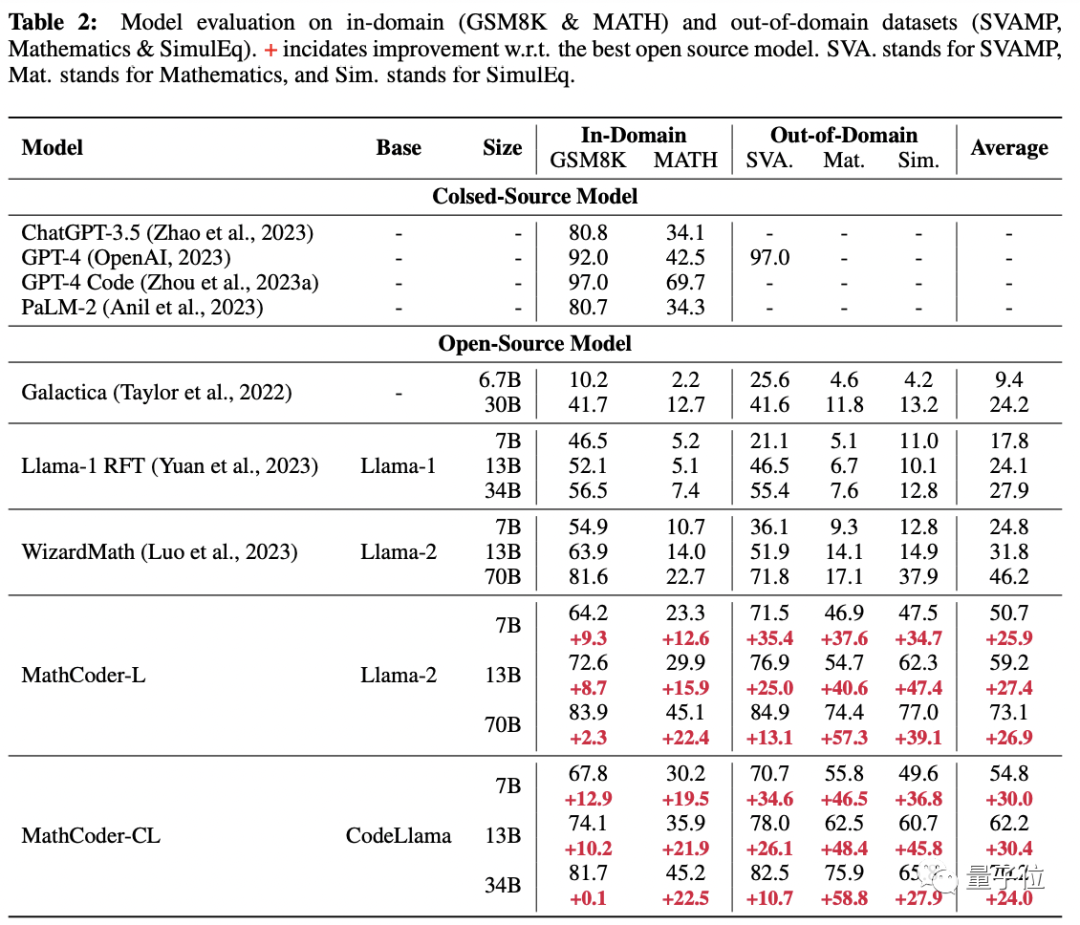

在评测中,MathCoder凭此直接在MATH和GSM8K这俩数据集上取得了45.2%和83.9%的好成绩。

该成绩证明:

其一,它超过了ChatGPT-3.5和PaLM-2等9个闭源模型,并在以数学竞赛题为主的MATH集上超过GPT-4。

其二,它打败了此前数学领域里最强的开源模型WizardMath,成为新的开源之最。

不过其三,模仿但还未超越,在这俩数据集上,MathCoder还是与GPT-4代码解释器(69.7%和97%高分)存在着一定的性能差距。

作者介绍

本研究一共10位作者,除了两位来自香港城市大学以外,其余均来自香港中文大学。

共同一作一共有6位,分别是:Ke Wang、Houxing Ren、Aojun Zhou、Zimu Lu、Sichun Luo和Weikang Shi。

通讯作者为李鸿升,为港中大电子工程系副教授,同时也就职于上海人工智能研究室。

论文地址:

https://arxiv.org/abs/2310.03731

— 完 —

「量子位2023人工智能年度评选」开始啦!

今年,量子位2023人工智能年度评选从企业、人物、产品/解决方案三大维度设立了5类奖项!欢迎扫码报名

MEET 2024大会已启动!点此了解详情。

点这里👇关注我,记得标星哦~

一键三连「分享」、「点赞」和「在看」

科技前沿进展日日相见 ~

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง