衡宇 发自 凹非寺

量子位 | 公众号 QbitAI

千亿参数大模型,支持输入的长文本首次达20万字!

在任何规模的大模型产品化队伍中,这个长度堪称目前的全球最长。

用数据说话:目前Claude支持最大长文本为100k(约8万字),而GPT-4则是32k(约2.5万字)。20万字,分别是它们的2.5倍和8倍。

这便是清华叉院助理教授杨植麟,创业大模型后拿出的第一份成绩单。

就在10月9日下午,杨植麟创业AI公司月之暗面(Moonshot AI)推出了首款大模型产品智能助手Kimi Chat。

核心被强调的亮点是:其背后虽是体量为千亿参数的“庞然大物”,但却可以hold住输入20万汉字,不管是《三体》还是《马斯克传》都能随便读。

据介绍,拓展上下文窗口长度,只是月之暗面“登月计划”的第一步;这一步的落实,实则是为下一步落子多模态提供基础——该公司预计在明年对外开放多模态版本产品。

而公司的最终目标,是在大模型领域做To C超级应用。

杨植麟身上的光环很多。

除了是清华叉院助理教授外,还有FAIR、Google Brain的工作履历,是Transformer-XL和XLNet工作一作,发明的算法曾在30多项AI标准任务取得SOTA,师从苹果公司AI负责人Ruslan Salakhutdinov、清华唐杰……

种种光环加持下,3月被曝创业后,月之暗面就自带一层神秘面纱。而后,红杉孵化式支持,循序完成两轮共计近20亿元融资,更是让公司获得了格外多的注目。

如今,这家公司首次公开亮相,回应了更多外界的议论。

“参数和上下文窗口长度共同决定模型效果”

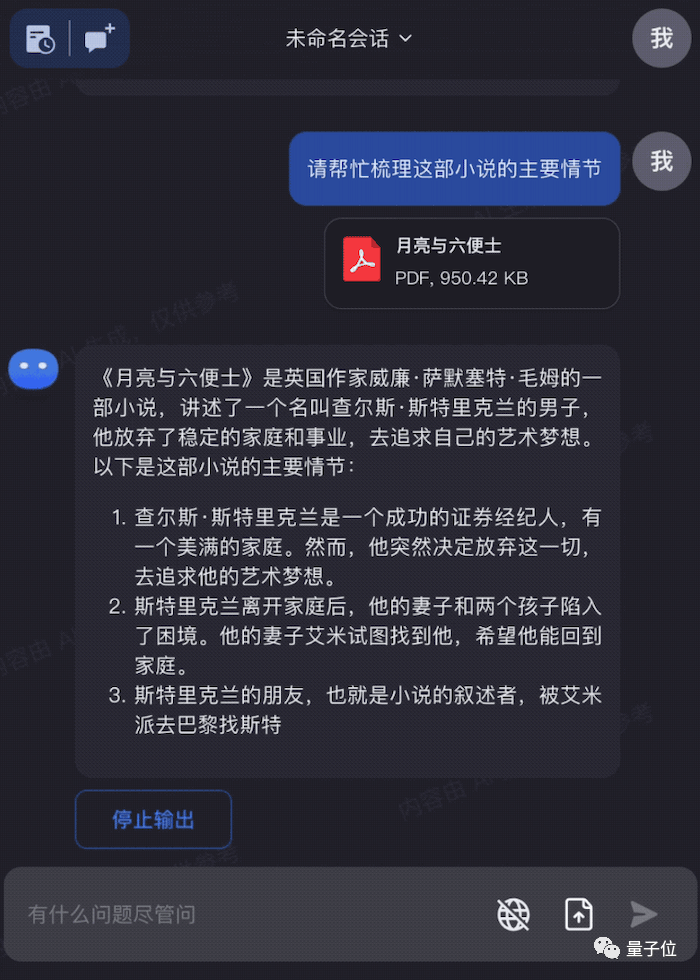

现场演示时,量子位关注到,由于支持20万字长文本,月之暗面智能助手Kimi Chat有几点新花样。

一个是提供角色简介链接,Kimi就能根据链接内的基本信息,扮演角色进行对话:

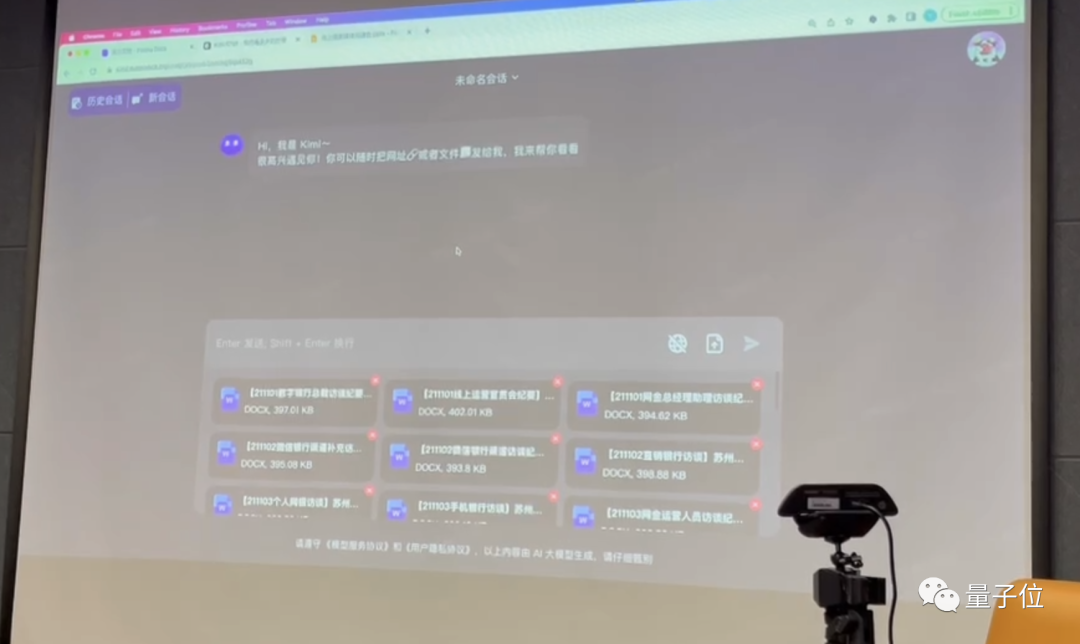

一个是能同时支持多个(现场演示时为50个)文件的上传和阅读分析:

还有一个是能根据提供的文本内容,画思维导图……

这样一个智能助手产品,月之暗面对其应用场景定位比较广泛,“包括生产力、娱乐层面的一些场景都可以”。

为什么选择以“长文本输入”为核心,来构建自家底座大模型的差异化竞争力?

月之暗面的官方回答是,这是行业现在迫切需要解决的问题,也是通往下一步,即产品化的最大卡点。

一切基于整个团队的“朴素判断”,参数量决定了大模型支持多复杂的“计算”,而能够接收多少文本输入(即长文本技术)则决定了大模型有多大的“内存”,两者共同决定模型的应用效果。

上下文对应的其实是计算机的内存。

近几十年,计算机系统的内存发生了翻天覆地的变化。《超级玛丽》初代版本使用的内存非常非常低,但现在的应用内存至少都是几个GB。

参数量决定了模型能支持多复杂的计算,但不光是要有足够多的参数量,同时要有很强的上下文。上下文是新一代大模型的标准配置。

天下大模型苦长文本久矣。

就连目前最顶尖的模型,在上下文窗口方面还有非常大的探索空间,如Claude 2最长上下文窗口100k,GPT-4最长为32k,Llama2最长支持4k。

支持这样的长度对实际应用来说,远远不够。

此处拿大模型应用的热门方向Agent举例。Agent运行需要自动进行多轮规划和决策,且每次行动都需要参考历史记忆信息才能完成,这会带来模型输入的快速增加,同时也意味着,不能处理更长上下文的模型,将因无法全面准确地基于历史信息进行新规划和决策,从而降低成功运行概率。

该怎么弥补和提升呢?

在这一点上,杨植麟把市面上现有的解决方案划分为三种类型。

-

金鱼模型。采用滑动窗口方式,实际上抛弃了很多上文,难以解决任务(包括近期MIT的工作,号称可处理无限长度文本的StreamingLLM);

-

蜜蜂模型。关注局部而忽略全局,只采样上下文中的一部分,如基于检索增强的RAG(retrieval augmented generation)方法,无法完成许多任务;

-

蝌蚪模型。长下文长度虽长,但模型参数太小(如10亿),涌现能力不够。

杨植麟将以上三种办法统称为解决大模型上下文窗口长度的捷径,并称,不会依赖这些滑动窗口、降采样、小模型等对性能损害较大的捷径方案。

具体到月之暗面自己的解决办法上,月之暗面主要在两点上发力,一是创新网络结构,二是进行工程优化。

接下来的目标,是按照产品驱动去迭代升级,把技术和产品结合到一起,最终目标是打造C端的Super App。

并且预计明年发布多模态产品,因为在杨植麟看来,无论何种模态的数据,对其进行无损压缩是可以实现高程度智能的。

无损压缩等同于对数据联合概率分布的预测,而多模态数据的生成,本质上也是在做数据的联合概率分布预测。

月之暗面创始团队

目前,刚创业起步的月之暗面已经获得了近20亿元融资,投资方包括红杉、今日资本、砺思资本等。

除了大模型火热之外,这样进展迅速的高估值、高融资和创始团队不无关系。

目前公开的资料来看,月之暗面联合创始核心团队共3人。

创始人兼CEO杨植麟,本科就读于清华大学计算机系。

高中时期,没有任何编程基础的杨植麟被选拔进信息学奥林匹克竞赛培训班,最终通过竞赛保送清华大学(非计算机系)。

直到大二时,他惊觉自己还是对计算机的兴趣更浓,于是果断转入计算机系,师从清华教授、IEEE Fellow唐杰。

计算机系就读期间,杨植麟以满分成绩通过所有程序设计课程。

2015年,他以年级第一的成绩毕业,随后远赴CMU(卡内基梅隆大学)语言技术研究所,跟随苹果公司AI负责人Ruslan Salakhutdinov和Google AI智能首席科学家William W. Cohen攻读博士学位。

△杨植麟与Ruslan Salakhutdinov(右一)、William Cohen(左一)合影

△杨植麟与Ruslan Salakhutdinov(右一)、William Cohen(左一)合影

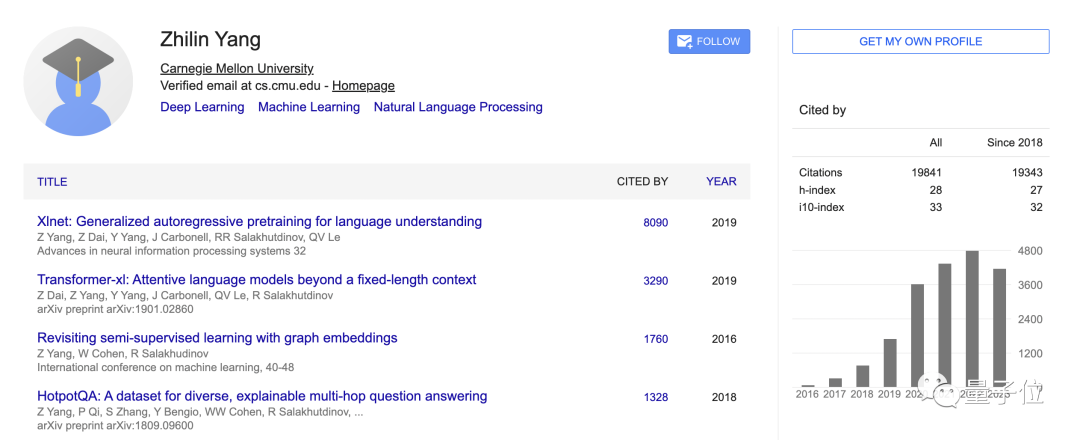

CUM就读期间,杨植麟不仅和图灵奖得主、深度学习三巨头之一Yoshua Bengio合作发布“火锅问答”数据集HotpotQA;还以一作身份,发表XLNet和Transformer-XL工作。

前者成为NeurIPS 2019与ACL 2019的最高引论文之一,Google Scholar引用次数破8000,后者引用次数也超3000。

杨植麟曾和Yoshua Bengio(图灵奖得主,深度学习三巨头之一)、Yann LeCun(图灵奖得主,又一个深度学习三巨头之一)、Quoc V. Le(Google Brain创始人之一)、何恺明(Kaiming He)等合写过论文。

据不完全统计,他曾在ICLR、NeurIPS、ICML、ACL、EMNLP等计算机顶会发表论文20余篇,研究成果累计Google Shcolar引用超过19000。

一般情况下,CMU的博士学位之旅6年起步,但仅仅花费4年时间,2019年,杨植麟就顺利拿下博士学位。

第二名联合创始人,目前是月之暗面的算法团队负责人,周昕宇。

他是清华大学2011级本科生,和杨植麟、张宇韬同为计算机系的学生。

周昕宇在毕业后选择加入旷视,工作内容是算法量产。

就职期间,他和旷视研究院基础科研负责人、ResNet作者之一张祥雨一道,研究移动端模型,以共同一作的身份撰写ShuffleNet论文,被CVPR接受。

这项工作后来影响了包括苹果3D人脸解锁在内的各种手机毫秒级人脸解锁技术。

另一名联合创始人是吴育昕,目前持有公司5.96%的股份。

吴育昕和杨植麟一样,先后毕业于清华和CMU,研究方向为计算机视觉中的检测和识别问题。

毕业后他先是在Meta的FAIR工作,曾和AI大神何恺明共同提出组归一化(GN)的方法。期间,他还创建了detectron2,这是Meta最受欢迎的AI项目之一。

在Google Scholarship上,吴育昕的被引次数超过了19000次。

这三人联手创业,目前公司规模拓展到50-60人上下。

有趣的是,月之暗面三位联创都出身清华。这不由得让人想到在今年以来的大模型热潮中,清华系占据创业团队半壁江山的现状。

包括唐杰师从的清华教授唐杰,就与另一名大模型创业明星智谱AI,有着千丝万缕的密切联系。

杨植麟倒是直言了对这种竞争格局的看法:“大模型空间非常大,很难有任何一家公司可以把所有的事情都做了。有ToB也有ToC,技术路线也不一样,我觉得这是一个巨大的空白空间。”

他认为,除了OpenAI,中国的几个公司都有机会产生自己独一无二的价值。

One More Thing

月之暗面这个公司名,来源于杨植麟最喜欢的专辑《The Dark Side of The Moon》。

在清华时,联创之一的周昕宇就和杨植麟共同创建了乐队,并创作了一首歌,有关“做了一个创业成功一夜暴富的白日梦”。

于是,媒体沟通会现场,当被问到“现在还摇滚吗”这个问题时,得到的答案是:

现在公司放着两把电吉他,还有一架钢琴(doge)。

— 联系作者 —

— 完 —

「量子位2023人工智能年度评选」开始啦!

今年,量子位2023人工智能年度评选从企业、人物、产品/解决方案三大维度设立了5类奖项!欢迎扫码报名

MEET 2024大会已启动!点此了解详情。

点这里👇关注我,记得标星哦~

一键三连「分享」、「点赞」和「在看」

科技前沿进展日日相见 ~

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง