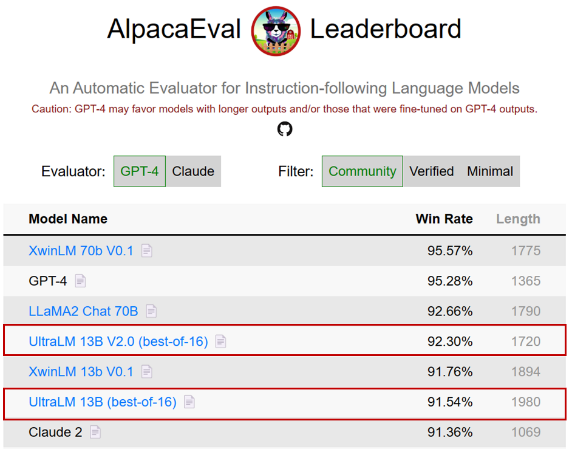

面壁智能(ModelBest)与清华 NLP 实验室持续探索大模型对齐(Alignment)技术。继 UltraLM-13B-v1.0 登顶斯坦福 AlpacaEval 开源模型榜单后,近日团队最新发布与 UltraRM 联合的 UltraLM-13B-v2.0(best-of-16采样),在 AlpacaEval 榜单取得了 92.30% 的高分,成为 70B 以下模型最高分。

UltraLM-13B-v2.0 是从 LLaMA2-13B 模型在 UltraChat 数据集上微调而来(介绍详见:OpenBMB 对齐技术 UltraLM 登顶斯坦福 Alpaca-Eval 开源模型榜单),此前在 AlpacaEval 榜单上得分为 83.60%。

为了进一步提高生成质量,团队积极探索基于人类反馈的强化学习(RLHF)技术,构建了大规模反馈数据集UltraFeedback并基于此训练了高质量奖励模型UltraRM,UltraRM进一步帮助UltraLM-13B-v2.0在AlpacaEval榜单取得了70B以下模型中的最佳性能。

UltraFeedback

大规模、多样化、细粒度的偏好数据集

—

➤ Github 地址

🔗 https://github.com/OpenBMB/UltraFeedback

➤ 论文链接

🔗 https://arxiv.org/abs/2310.01377

➤ HuggingFace 链接

🔗 https://huggingface.co/datasets/openbmb/UltraFeedback

基于人类反馈的强化学习(RLHF)被 OpenAI、Anthropic 和 Google DeepMind 等业界领先公司广泛研究并应用。然而,由于缺乏 高质量、公开可用 的偏好数据集,开源社区在 RLHF 的研究和实践上仍然处于落后状态。

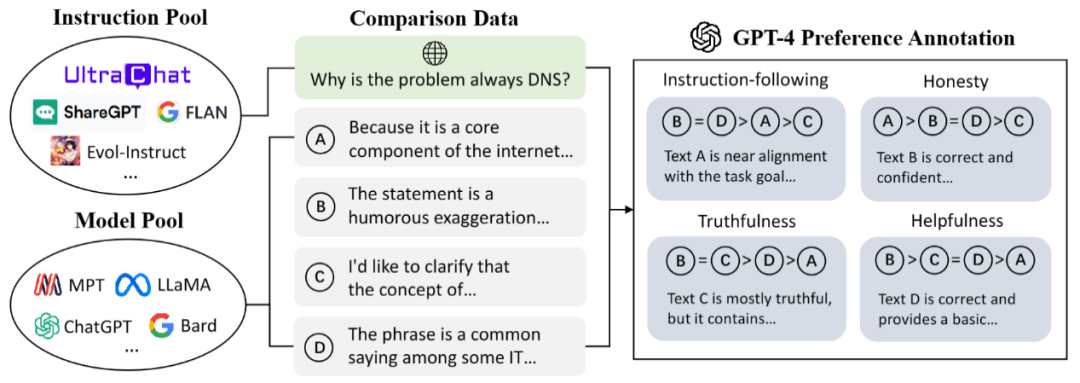

为了解决这一问题,我们构建了 UltraFeedback,一个 大规模、多样化、细粒度 的偏好数据集,包括 25 万条 对话数据以及相应的偏好标注数据,每条偏好标注均包含四个方面的细粒度得分与详细的文字说明。这一数据规模在非社区标注的偏好数据集中排在首位。

为了提升指令和模型的多样性,UltraFeedback 从多个社区开源的指令数据集中收集了约 6 万条指令。基于这些指令,UltraFeedback 从 17 种不同架构、参数量、训练数据的模型中随机选取4种不同模型,为每条指令生成 4 种有区分度的回复。

UltraRM

基于 UltraFeedback 的奖励模型

—

➤ HuggingFace 地址

🔗 https://huggingface.co/openbmb/UltraRM-13b

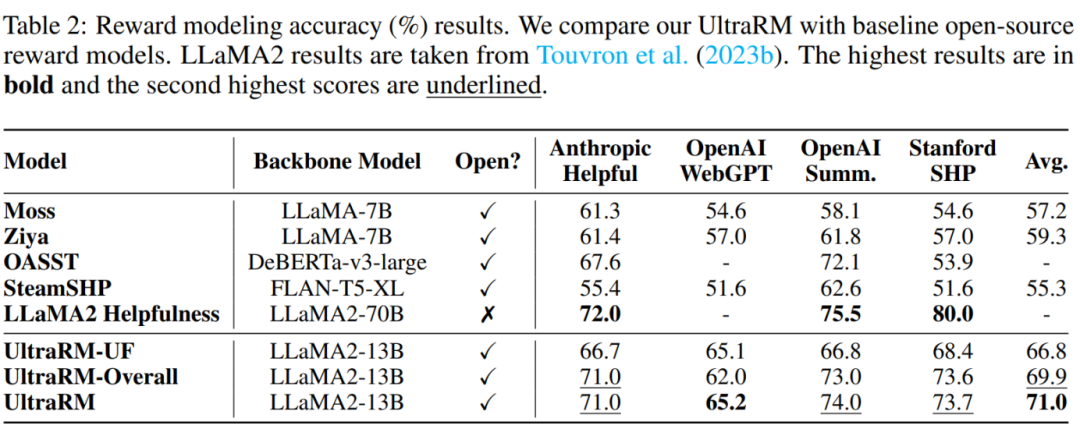

奖励模型(Reward Model)旨在区分同一个问题的不同回答好坏,是后续 RLHF的基础,也是衡量反馈数据集质量的重要维度。我们训练并发布了基于 UltraFeedback 的奖励模型(Reward Model), UltraRM,以进一步促进对齐研究。UltraRM 由 LLaMA2-13B 初始化,在 UltraFeedback 和三个开源数据集(Anthropic HH-RLHF, Stanford SHP和OpenAI Summarization)组成的混合数据集上进行微调。在四个公共偏好测试集上,UltraRM 显著超过其他开源奖励模型,达到了 SOTA 的性能。

UltraCM

基于UltraFeedback 的批评模型

—

➤ HuggingFace 地址

🔗 https://huggingface.co/openbmb/UltraCM-13b

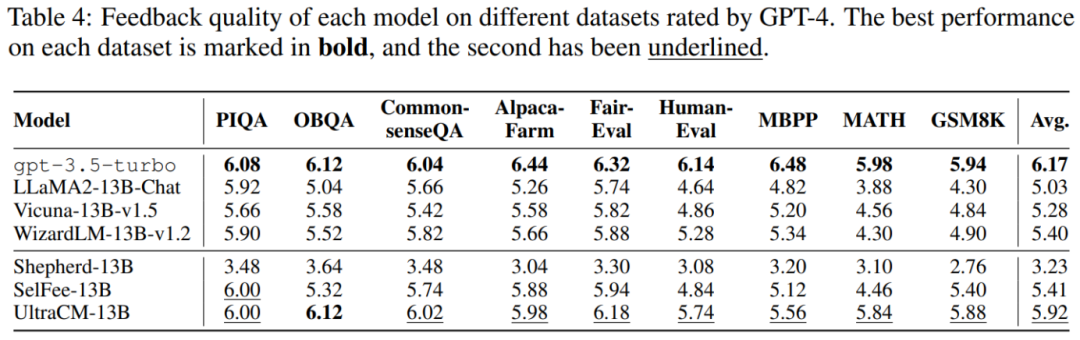

我们还训练了一个基于 UltraFeedback 的批评模型(Critique Model), UltraCM,用于自动生成文本形式的反馈。与 UltraRM 类似,UltraCM 由 LLaMA2-13B 初始化。在 9 个基准数据集上,UltraCM 优于所有开源 baseline,性能接近 ChatGPT。

UltraFeedback 的应用和热烈反馈

—

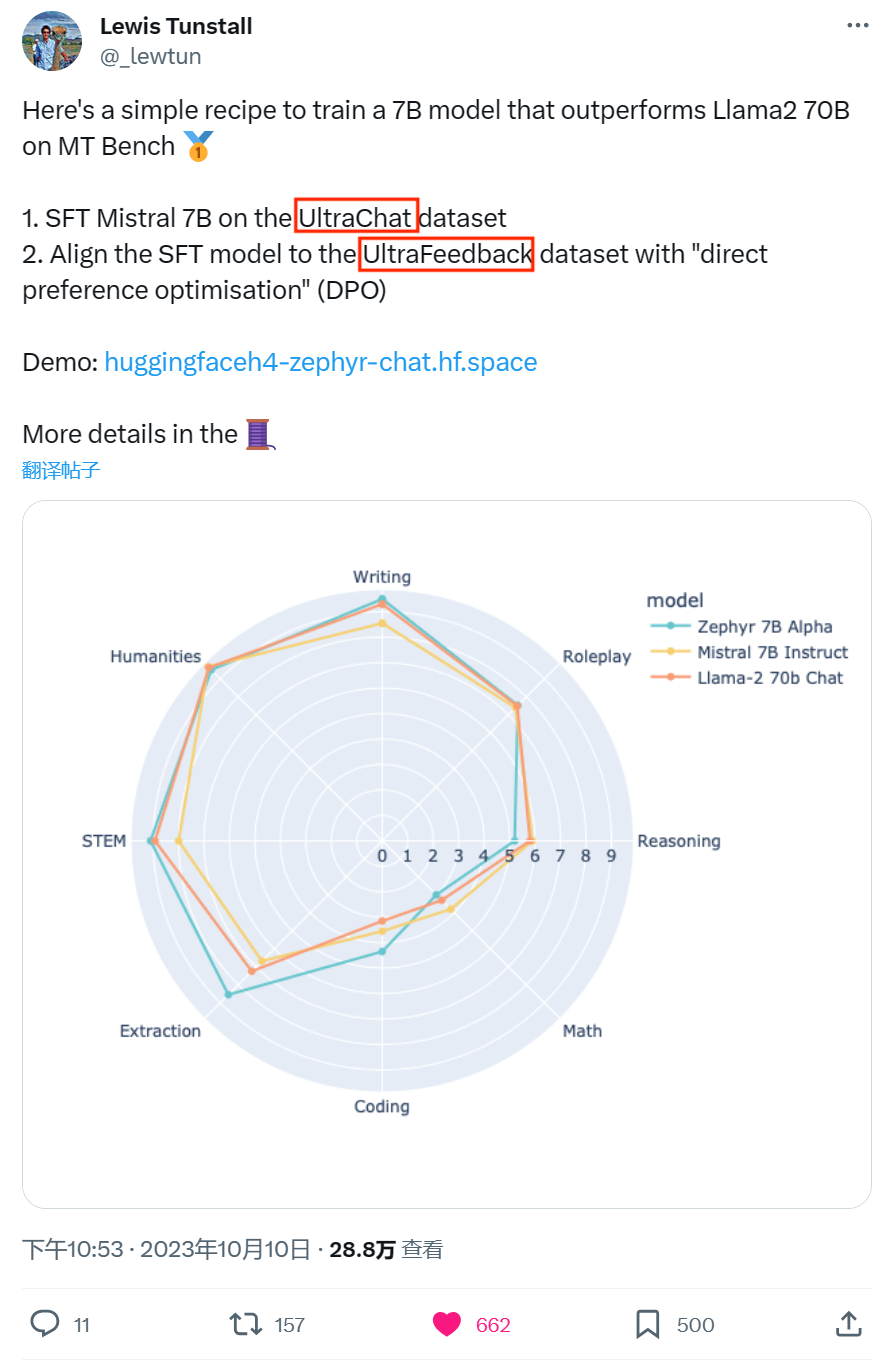

UltraFeedback 发布不足十天,已经得到开源社区的积极认可。HuggingFace 团队基于 UltraChat 和 UltraFeedback 训练了 Zephyr-7B 模型,展现出强大性能。Zephyr-7B 在 MT-Bench 上得到 7.09 分,超越 LLaMA2-70B-Chat,同时在 OpenLLM Leaderboard 的 4 个数据集上取得了 66.1 的平均分,在 Twitter 上受到广泛关注。

我们欢迎更多研究者使用 UltraChat 和 UltraFeedback 训练自己的模型,推动开源社区对齐技术研究!

➤ 加社群/ 提建议/ 有疑问

请找 OpenBMB 万能小助手:

官方网站

https://www.openbmb.org

GitHub

https://github.com/OpenBMB

https://github.com/thunlp

长期开放招聘|含实习

交流QQ群

735930538

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง