今日值得关注的人工智能新动态:

-

AI 教父:自我修改或让 AI 失去控制

-

Character.AI 引入“群聊”功能:多 AI 交互开启全新对话体验

-

微软、亚马逊等巨头企业制定 AI 招聘政策

-

Bard 在谷歌内部遭质疑

-

Mini-DALLE3:通过提示实现交互式文生图

-

大型语言模型能进行物理推理吗?

-

实证研究:指令微调的中文大型语言模型

-

技术报告:快手 KwaiYiiMath 数学大模型

-

报告:视觉计算扩散模型的最新进展

01

Nature 新研究:

在手术台上诊断脑肿瘤的AI

荷兰的科学家报告称,他们利用人工智能(AI)向外科医生提供有关肿瘤的知识,帮助他们做出选择。发表在《自然》杂志上的一项研究描述了这种方法,计算机扫描肿瘤的 DNA 片段,发现某些化学修饰,从而对脑肿瘤的类型甚至亚型做出详细诊断。

研究人员表示,在长达数小时手术的早期阶段得出的诊断结果可以帮助外科医生决定如何积极地进行手术。将来,这种方法还能帮助医生找到针对特定亚型肿瘤的治疗方法。

02

AI 教父:

自我修改或让 AI 失去控制

被称为“人工智能教父”的计算机科学家 Geoffrey Hinton 因其数十年来在人工智能(AI)和深度学习方面的开创性工作而获得 2018 年图灵奖。在谷歌工作了十年后,他于 5 月辞去了谷歌副总裁兼工程研究员的工作。快速发展的 AI 技术可能会在“5 年内”超越人类。他补充说,如果出现这种情况,AI 的发展可能会超出人类的控制能力。

Hinton 说:“这些系统可能摆脱控制的方法之一就是编写自己的计算机代码来修改自己,这是我们需要认真担心的问题。”

03

Character.AI 引入“群聊”功能:

多 AI 交互开启全新对话体验

Character.AI 是一家由前谷歌人工智能(AI)研究人员创办的 AI 聊天机器人初创公司。今天,该公司为其用户推出了一项新功能——群聊体验,用户和他们的朋友可以同时与多个 AI 角色聊天。

该公司表示,“角色群聊”功能允许用户只与自己喜欢的 AI 角色创建群聊,也可以同时与人类和 AI 伙伴进行群聊。这样做的目的是让用户能够与朋友建立社交联系,或实时分享想法和进行合作,就像其他群聊体验一样,但现在他们的 AI 同伴也参与其中。

04

微软、亚马逊等巨头企业

制定 AI 招聘政策

根据软件和人才成功公司 Criteria 发布的 2023 年招聘基准报告,如今,只有 12% 的招聘专业人士表示在招聘或人才管理流程中使用了人工智能(AI)。但 Criteria 创始人兼首席执行官 Josh Millet 表示,从简化采购到做出明智的选择决策等各个方面,AI 解决方案“正在非常积极地进行营销”。

在企业等待纽约市的 AI 偏见法等法律影响扩大到其他地方的同时,BBB 国家项目的非营利基金会——行业自律中心(CISR)发布了一套在招聘和录用中使用可信 AI 的原则和协议。该原则与亚马逊、联合利华、科氏工业和微软等公司合作,解决了在招聘中使用 AI 的透明度、公平性、非歧视性、技术稳健性、安全性、治理和问责制等一系列问题。

05

Bard 在谷歌内部遭质疑

几个月来,Alphabet 旗下的 Google 和 Discord 一直在为 Google 的人工智能(AI)聊天机器人 Bard 的重度用户提供仅限邀请的聊天服务。谷歌产品经理、设计师和工程师正在利用该论坛公开讨论 AI 工具的有效性和实用性,一些人质疑投入开发的大量资源是否值得。

Bard 高级产品经理 Dominik Rabiej 在 7 月份的 Discord 聊天中写道:“我的经验法则是,除非我能够独立验证,否则不要相信大型语言模型(LLMs)的输出。””

另外,Bard 的用户体验负责人 Cathy Pearl 在八月份说:“我仍在思考的最大挑战是:就有用性而言,LLMs 真正有用的是什么?”

06

Google DeepMind 领衔新研究:

大型语言模型可以学习规则

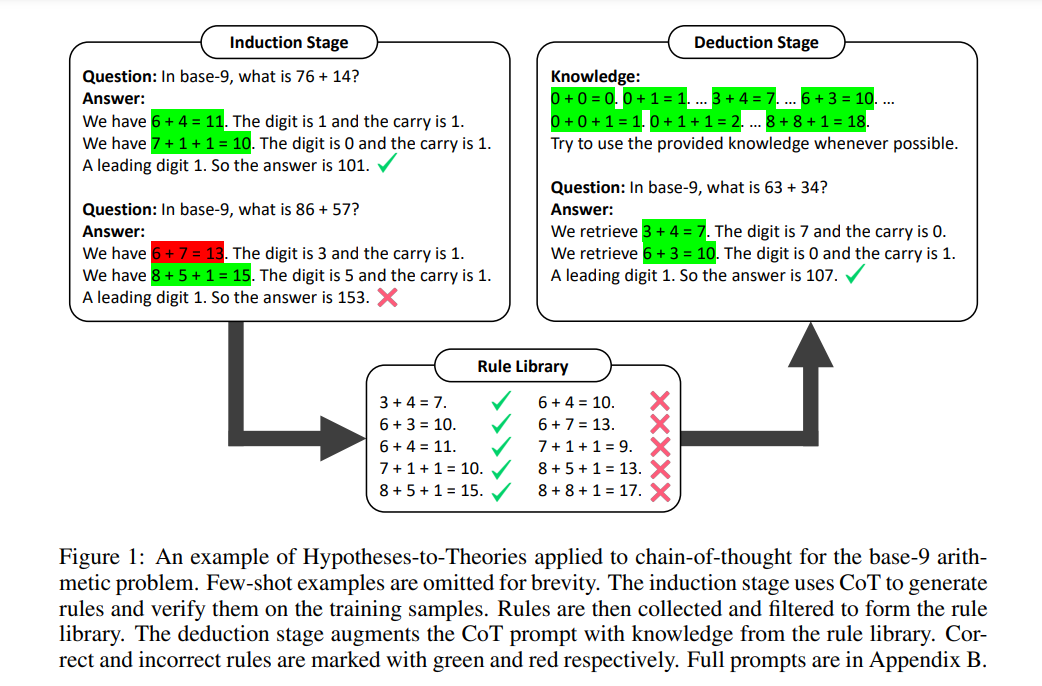

在一些例子和中间步骤的提示下,大型语言模型(LLMs)在各种推理任务中表现出了令人印象深刻的性能。然而,当隐含知识是错误的或与任务不一致时,依赖于 LLM 中隐含知识的提示方法往往会幻化出不正确的答案。

为了解决这个问题,该研究提出了 “假设到理论”(Hypotheses-to-Theories,HtT)框架,这是一个学习 LLMs 推理规则库的框架。HtT 包含两个阶段:归纳阶段和演绎阶段。在归纳阶段,首先要求 LLMs 通过一组训练示例生成并验证规则。经常出现并导致正确答案的规则会被收集起来,形成一个规则库。在演绎阶段,LLMs 将利用所学规则库进行推理,以回答测试问题。数字推理和关系推理问题的实验表明,HtT 改进了现有的提示方法,准确率绝对提高了 11-27%。

论文:

Large Language Models can Learn Rules

07

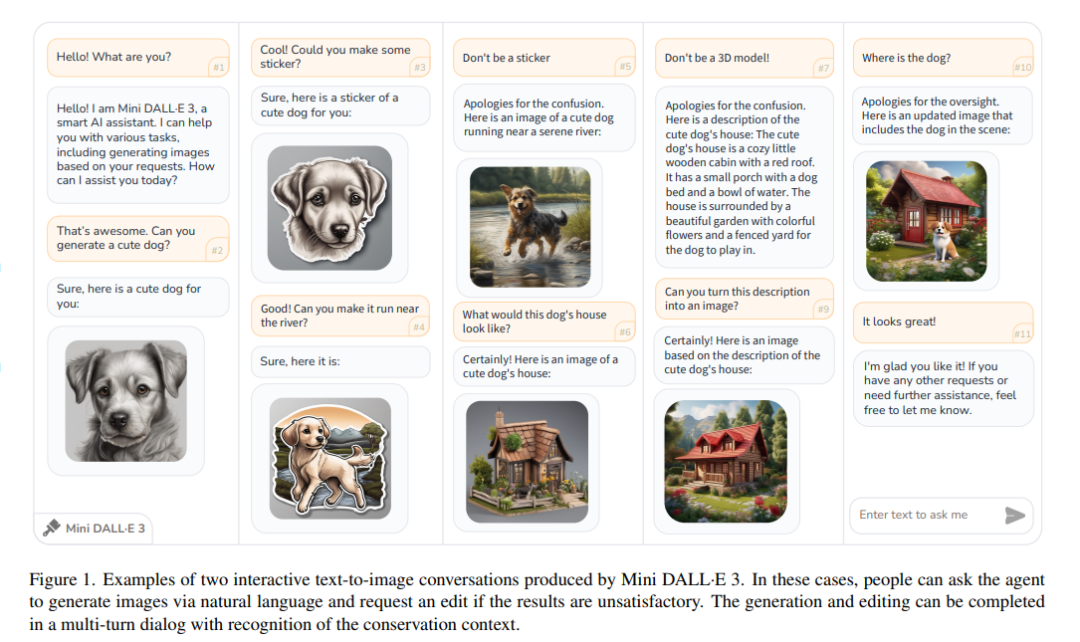

Mini-DALLE3:

通过提示实现交互式文生图

受最近发布的 DALLE3 的启发(DALLE3 是一个直接内置 ChatGPT 的 T2I 模型,会说话的人的语言),该研究重新审视了现有的 T2I 系统,努力对准人的意图,并引入了一个新任务——交互式文本到图像(iT2I),人们可以与大型语言模型(LLMs交互,使用自然语言交错生成/编辑/完善高质量图像,并回答具有更强图像和文本对应性的问题。

为解决 iT2I 问题,该研究提出了一种简单的方法,利用提示技术和现成的 T2I 模型来增强用于 iT2I 的 LLMs。研究人员在不同的 LLMs(如 ChatGPT、LLAMA、Baichuan 和 InternLM)下的各种常用场景中评估了 iT2I 方法。研究表明,此方法可以方便、低成本地为任何现有 LLMs 和任何文本到图像模型引入 iT2I 能力,而无需任何训练,同时对 LLMs 在问题解答和代码生成等方面的固有能力几乎没有影响。

论文:

Mini-DALLE3: Interactive Text to Image by Prompting Large Language Models

08

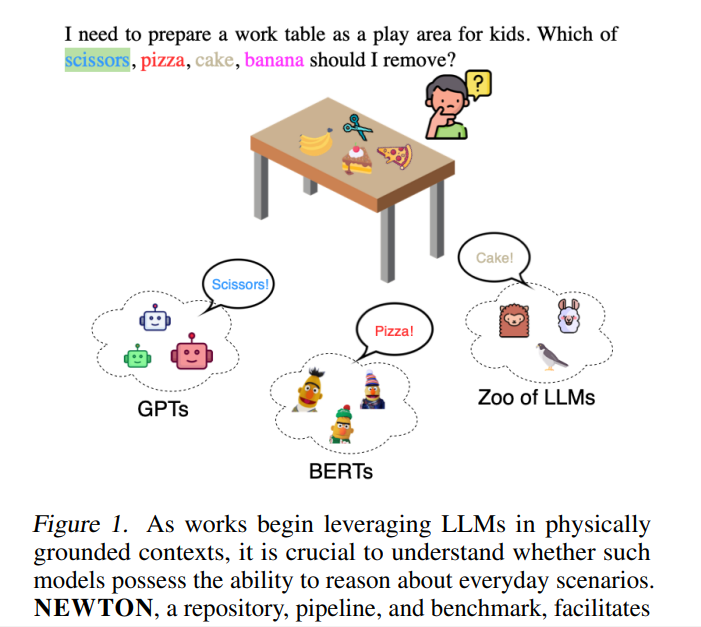

大型语言模型能进行物理推理吗?

大型语言模型(LLMs)通过其上下文表征,已被经验证明可以囊括句法、语义、词义和常识性知识。然而,人们对它们的物理推理能力,特别是理解日常物体的关键属性的探索还很有限。

为了解决这一问题,该研究引入了 NEWTON,这是一个用于评估 LLM 物理推理能力的资源库和基准。此外,为了使这一基准适用于特定领域,研究人员提出了一个管道,来生成这一基准的变体,该变体已根据与其应用相关的对象和属性进行了定制。通过广泛的实证分析,该研究结果凸显了 LLMs 在物理推理方面的能力。研究发现,GPT-4 等 LLMs 在基于场景的任务中表现出很强的推理能力,但在对象属性推理中与人类相比表现出较低的一致性(50% 对 84%)。此外,NEWTON 平台还展示了其评估和增强语言模型的潜力,为将语言模型集成到机器人操纵等物理环境中铺平了道路。

论文:

NEWTON: Are Large Language Models Capable of Physical Reasoning?

09

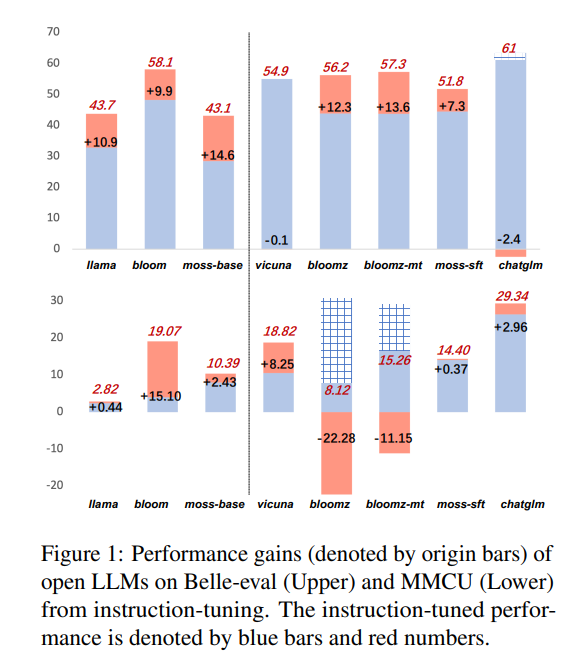

实证研究:

指令微调的中文大型语言模型

ChatGPT 的成功验证了大型语言模型(LLMs)在通用人工智能(AGI)中的潜力。随后,LLMs 的发布引发了开源社区对指令调谐的兴趣,这被认为会加速 ChatGPT 的复制进程。然而,对于中文的指令调谐 LLMs 的研究仍处于早期阶段。

该项目研究了中文的指令调谐 LLMs,为有效定制更能响应中文指令的 LLMs 提供了宝贵的研究成果。研究人员系统地探讨了 LLMs 基础、参数有效方法、指令数据类型这三个对指令调谐最重要的要素的影响。此外,他们还通过实验研究了其他因素的影响,如思维链数据和人类价值对齐。该研究将发布一个可与 ChatGLM 相媲美的功能强大的中文 LLMs。

论文:

An Empirical Study of Instruction-tuning Large Language Models in Chinese

10

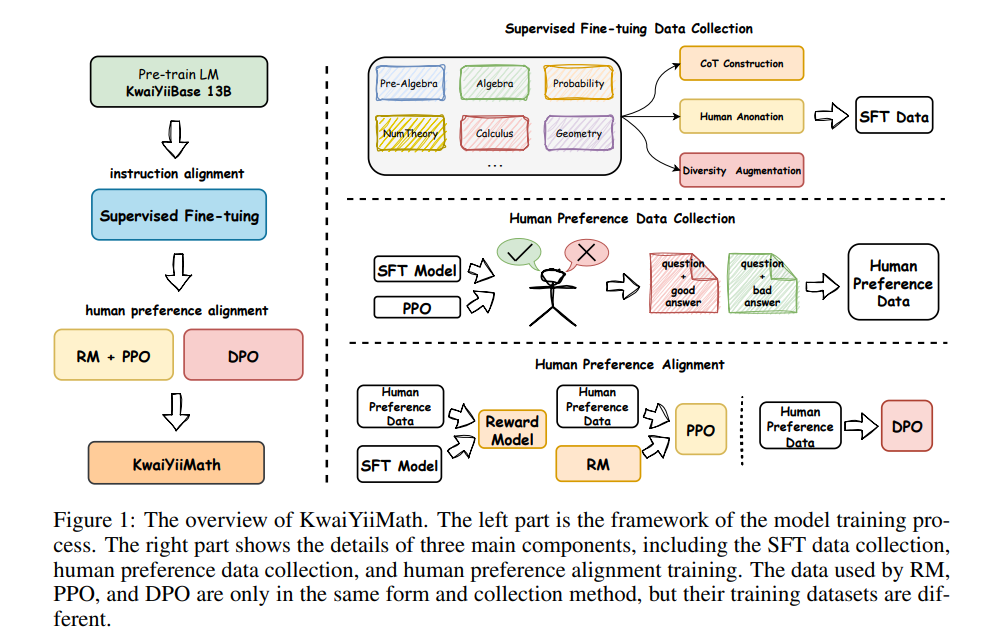

技术报告:

快手 KwaiYiiMath 数学大模型

最近,大型语言模型(LLMs)在处理各种自然语言处理(NLP)下游任务,甚至是需要多步推理的数学任务方面表现出了卓越的能力。该研究介绍了 KwaiYiiMath,它通过应用监督微调(SFT)和人类反馈强化学习(RLHF),增强了 KwaiYiiBase1 的数学推理能力,包括中英文数学任务。同时,为了评估模型生成的解题过程的正确性,研究人员还构建了一个小规模的中国小学数学测试集(命名为 KMath)。实证研究表明,KwaiYiiMath 在GSM8k、CMath 和 KMath 上的表现分别达到了同类模型的先进水平。

论文:

KwaiYiiMath: Technical Report

11

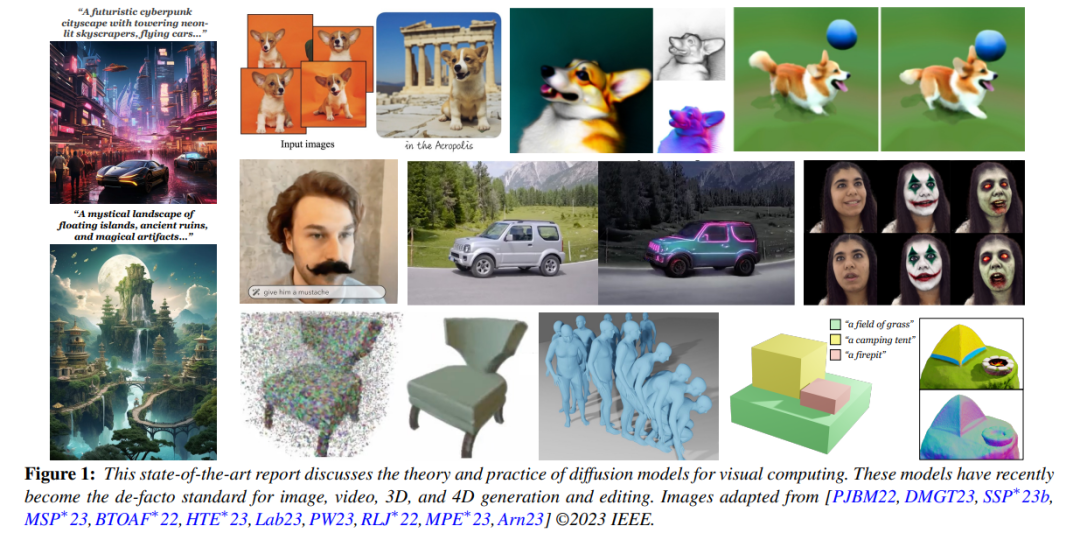

报告:

视觉计算扩散模型的最新进展

这份最新报告(STAR)旨在介绍扩散模型的基本数学概念、实现细节和流行的稳定扩散模型的设计选择,并概述这些生成式人工智能工具的重要方面,包括个性化、调节、反转等。此外,研究还全面概述了快速增长的基于扩散的生成和编辑文献,并按照生成介质的类型进行分类,包括二维图像、视频、三维物体、运动和四维场景。最后,研究人员讨论了可用的数据集、衡量标准、公开挑战和社会影响。该 STAR 为研究人员、艺术家和从业人员探索这一令人兴奋的课题提供了一个直观的起点。

论文:

State of the Art on Diffusion Models for Visual Computing

|点击关注我 👇 记得标星|

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง