Mistral 7B

Albert Q. Jiang, Alexandre Sablayrolles, Arthur Mensch, Chris Bamford, Devendra Singh Chaplot, Diego de las Casas, Florian Bressand, Gianna Lengyel, Guillaume Lample, Lucile Saulnier, Lélio Renard Lavaud, Marie-Anne Lachaux, Pierre Stock, Teven Le Scao, Thibaut Lavril, Thomas Wang, Timothée Lacroix, William El Sayed

介绍了Mistral 7B语言模型,通过利用分组查询注意力和滑动窗口注意力机制,实现了高性能和高效推理,在多个基准测试中超越了之前的模型的表现。

- 介绍Mistral 7B,一个拥有70亿参数、在保持高效的同时达到最先进性能的语言模型。它在所有基准测试中优于之前最好的13B模型Llama 2,并在推理、数学和代码生成方面优于最好的34B模型Llama 1。

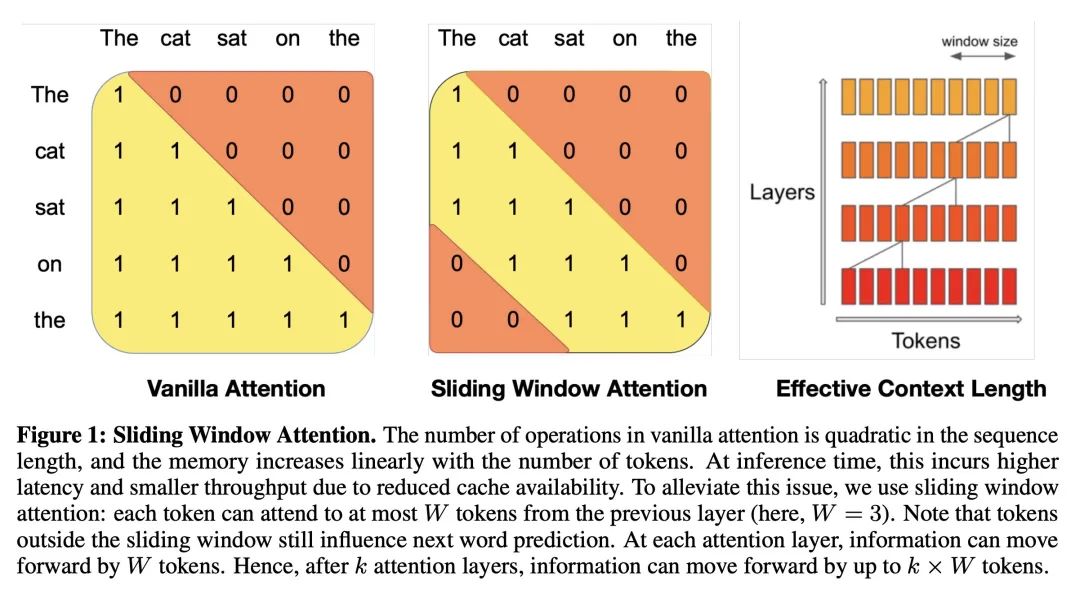

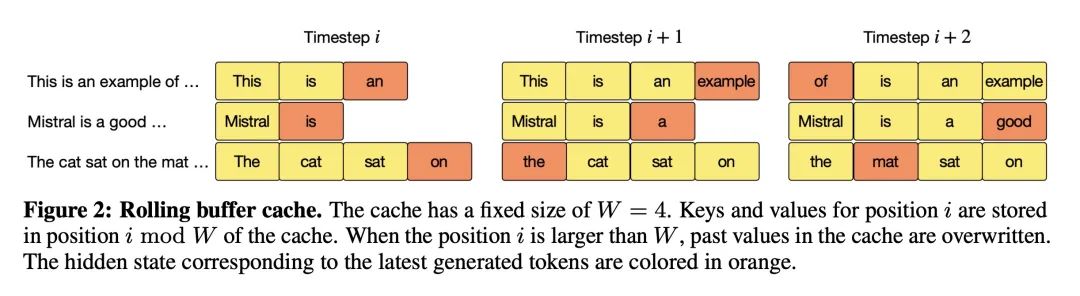

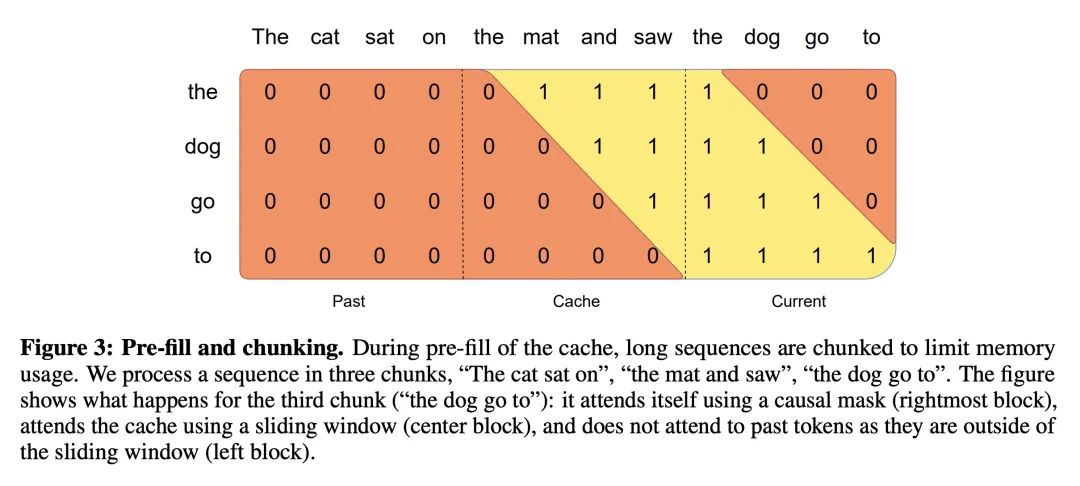

- 使用组查询注意力(GQA)来减少内存使用和增加吞吐量,还使用滑动窗口注意力(SWA)来更有效地处理长序列。

- 微调后的版本称为Mistral 7B-Instruct,在人类和自动化评估中优于Llama 2 13B-Chat模型。

- 达到比其大2-3倍的模型的性能,展示了模型设计的效率。由于优化了推理、数学和代码生成,优于更大的模型。

- 可以添加“护栏”来生成更安全、更高质量的响应,展示了进行自我反思和内容审核的能力。

- 结论:仔细的模型设计可以实现高性能和高效率,探索最优的性能与效率与成本之间的平衡仍有机会。

动机:在自然语言处理领域,为了追求更高的模型性能,往往需要增加模型的大小,但这也会增加计算成本和推理延迟,限制了在实际应用中的部署。因此,需要设计既能提供高性能又能保持高效推理的平衡模型。

方法:论文介绍了Mistral 7B,一个拥有70亿参数的语言模型。该模型利用了分组查询注意力(GQA)和滑动窗口注意力(SWA)的机制,提高了推理速度和效率。GQA加速了推理速度,减少了解码过程中的内存需求,从而实现更高的批处理大小和吞吐量;SWA通过降低计算成本,更有效地处理任意长度的序列。

优势:Mistral 7B在所有评估基准中超过了最好的开源13B模型(Llama 2),在推理、数学和代码生成方面也超过了最好的发布34B模型(Llama 1)。此外,论文还提供了Mistral 7B – Instruct,一个针对遵循指令的模型,它在人工和自动化基准测试中均超过了Llama 2 13B – chat模型。

https://arxiv.org/abs/2310.06825

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง