关键词:人体运动 生成模型 文献综述

导 读

本文是对发表于计算机视觉领域顶级期刊 TPAMI 2023 的综述论文 Human Motion Generation: A Survey 的解读。该论文由北京大学博雅特聘教授王亦洲课题组与北京大学艺术学院高峰助理教授、华为云首席科学家田奇博士合作完成。

这篇综述首次全面总结了人体动作生成领域的相关研究工作。作者首先介绍人体动作和生成模型的基础知识,然后对三个主要子任务(基于文本、音频和场景驱动的人体动作生成)的代表性方法进行了概述。此外,作者还梳理了常见数据集和评估指标,并讨论了开放问题和潜在的未来研究方向。作者希望本综述能够为这个快速发展的领域提供一个全面的概览,并启发解决现有挑战的新思路。

论文链接:

https://arxiv.org/pdf/2307.10894.pdf

Early Access:

https://ieeexplore.ieee.org/document/10313063

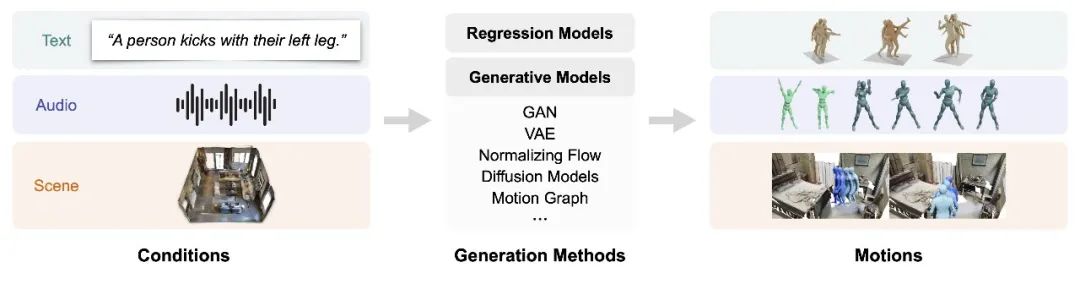

图1. 代表性的人体动作生成任务和方法概览。

01

背景介绍

人类根据自身意图和环境信息来规划和执行身体动作。作为人工智能的一项重要目标,生成人体的动作模式引起了各个研究领域的越来越多的关注,包括计算机视觉、计算机图形学、多媒体、机器人学和人机交互。人体动作生成的目标是生成自然、逼真且多样化的人体动作,在电影制作、视频游戏、增强现实/虚拟现实、人机交互和虚拟数字人等领域具有广泛应用。

随着深度学习的兴起,近年来各种生成方法取得了快速发展,如自回归模型、变分自编码器(VAE)、归一化流、生成对抗网络(GAN)和去噪扩散概率模型(DDPM)。这些方法在文本、图像、视频和 3D 物体等不同领域取得了巨大成功。另一方面,人体建模的显著进展使得从视频中提取人体动作和构建大规模人体动作数据集变得更加容易。因此,近年来数据驱动的人体动作生成引起了研究界越来越多的兴趣。

然而,人体动作生成面临的挑战不仅仅是将深度生成模型应用于人体动作数据集:

1. 人体动作高度复杂和非线性,受物理和生物力学约束;而人类大脑具有感知生物运动的专门神经机制,对稍不自然的动作模式都很敏感。因此,生成的动作在质量方面有很高的要求,需要兼具自然性、流畅性和合理性。

2. 人体动作生成的需求通常包括一个条件信号,如文本描述、背景音频或周围环境,如图1所示。因此生成的动作不仅本身应该合理,还应与条件信号协调一致。

3. 人体动作作为一种重要的非语言交流媒介,背后反映了多个潜在因素,如行为目标、个人风格、社会规范和文化表达。理想情况下,动作生成模型应该学习捕捉动作变化和与条件信号间微妙的语义关联。

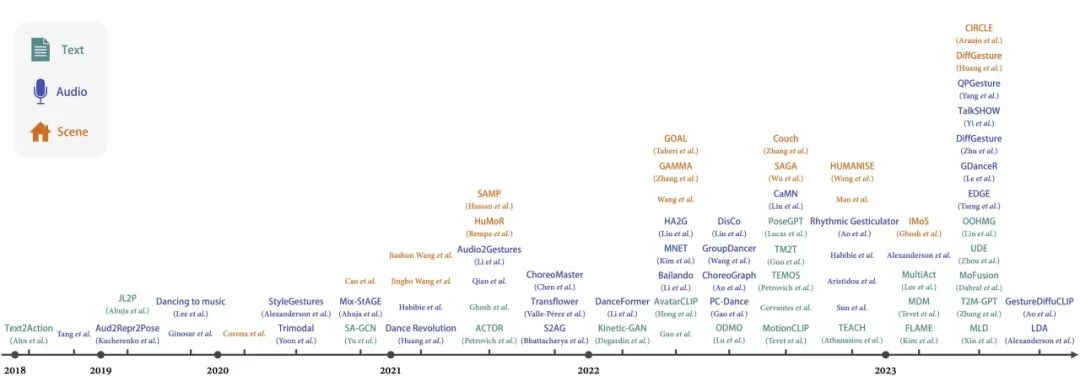

基于这一领域的快速发展和涌现的挑战,我们提供了这篇全面的综述,以帮助研究界跟踪其进展。图2总结了近年来人体动作生成方法的发展。

图2. 人体动作生成方法的近期进展(不同条件信号驱动)。

02

动作生成方法

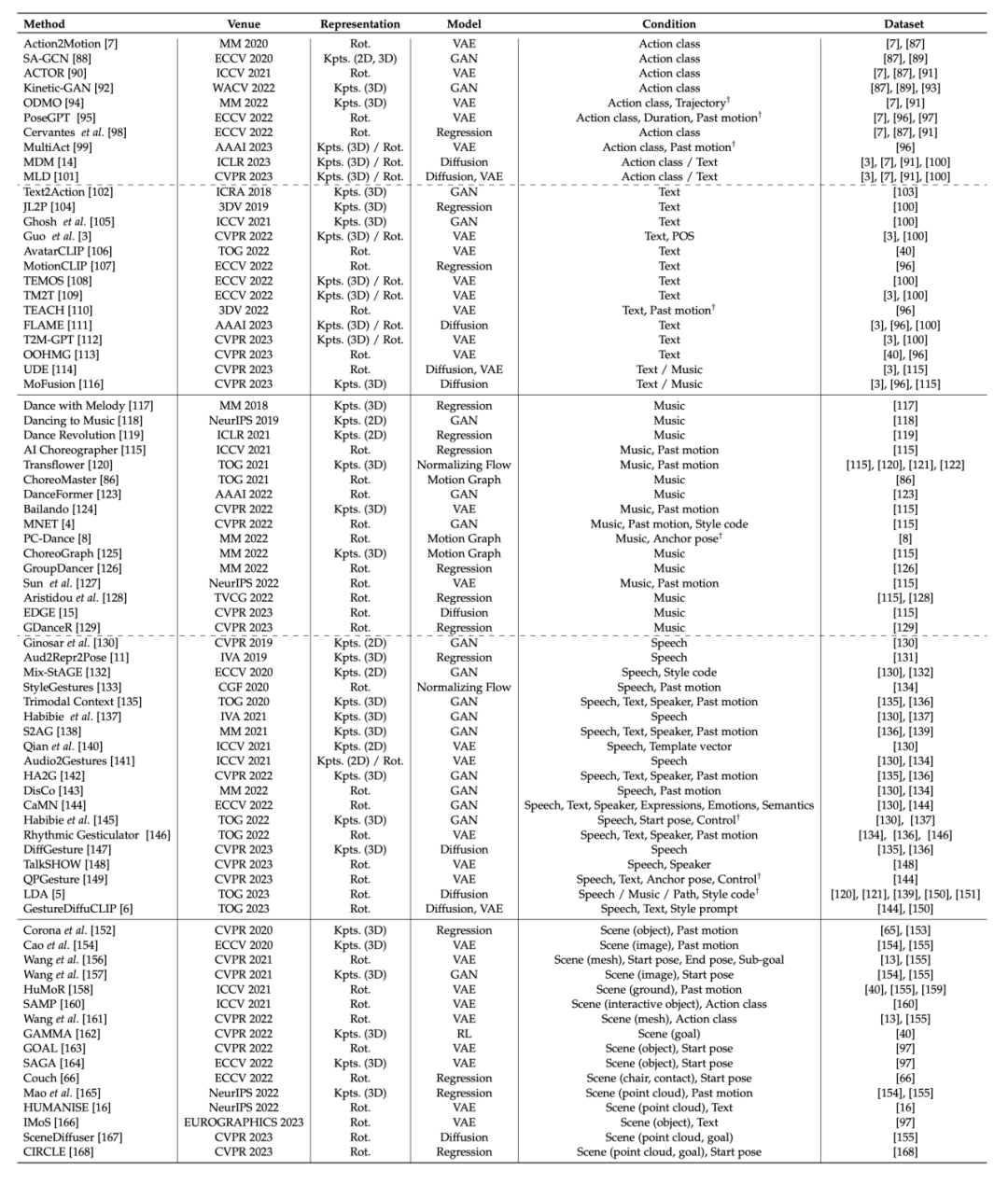

本篇综述论文主要关注基于条件信号的人体动作生成任务,包括文本驱动、音频驱动和场景驱动,并分别总结了这些方法的代表性成果,如表1所示。

表1. 人体动作生成代表性方法总结。

文本驱动

文本驱动人体动作生成任务旨在根据自然语言描述生成人体动作序列。这类方法可以分为两类:动作标签驱动和自然语言驱动。动作标签驱动利用有限的预定义标签生成动作,而自然语言驱动则可以基于多样化的文本描述生成更丰富的动作。

音频驱动

音频驱动人体动作生成任务旨在根据音频信号(如音乐或语音)生成相应的人体动作。这类任务主要可以分为音乐到舞蹈和语音到手势两个子任务。音乐到舞蹈任务生成与音乐节奏和风格相匹配的舞蹈动作,而语音到手势任务则生成与语音内容相协调的上半身动作。

场景驱动

场景驱动人体动作生成任务旨在根据场景环境生成合理的人体动作。这类方法通常采用多阶段管线,首先预测目标位置或目标交互锚点,然后规划路径或轨迹,最后沿轨迹生成动作。

03

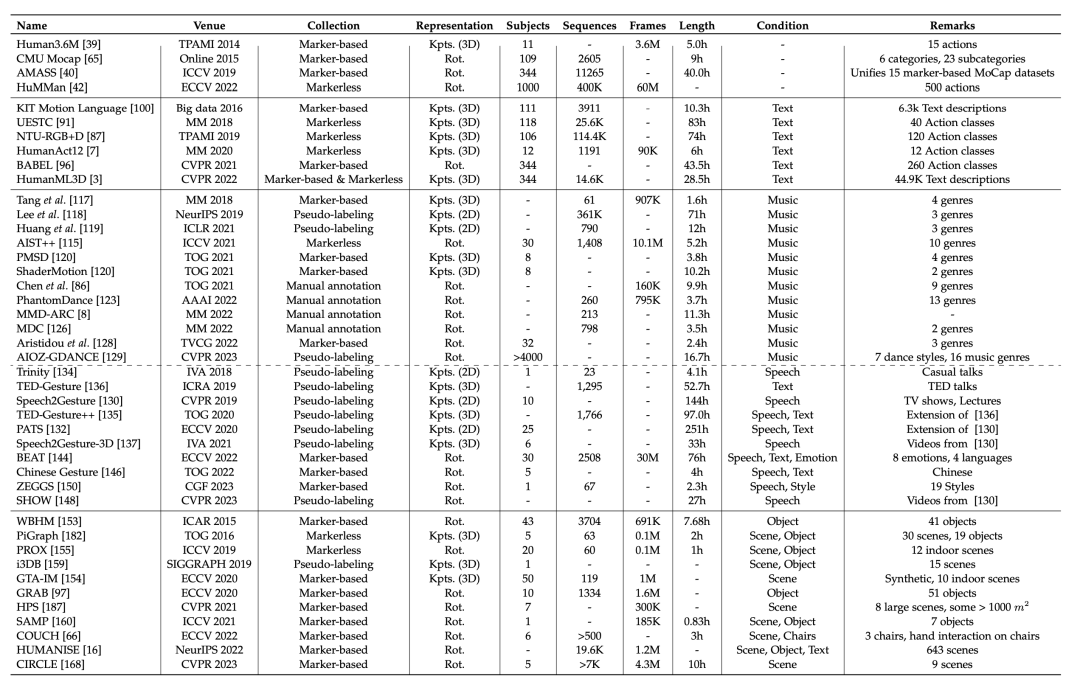

数据集

我们分别总结了与文本、音频和场景条件相关的人体动作数据集。这些数据集涵盖了各种动作类别、音频类型和场景类型,为人体动作生成研究提供了丰富的数据资源,如表2所示。

表2. 人体动作生成主要数据集总结。

04

评价指标

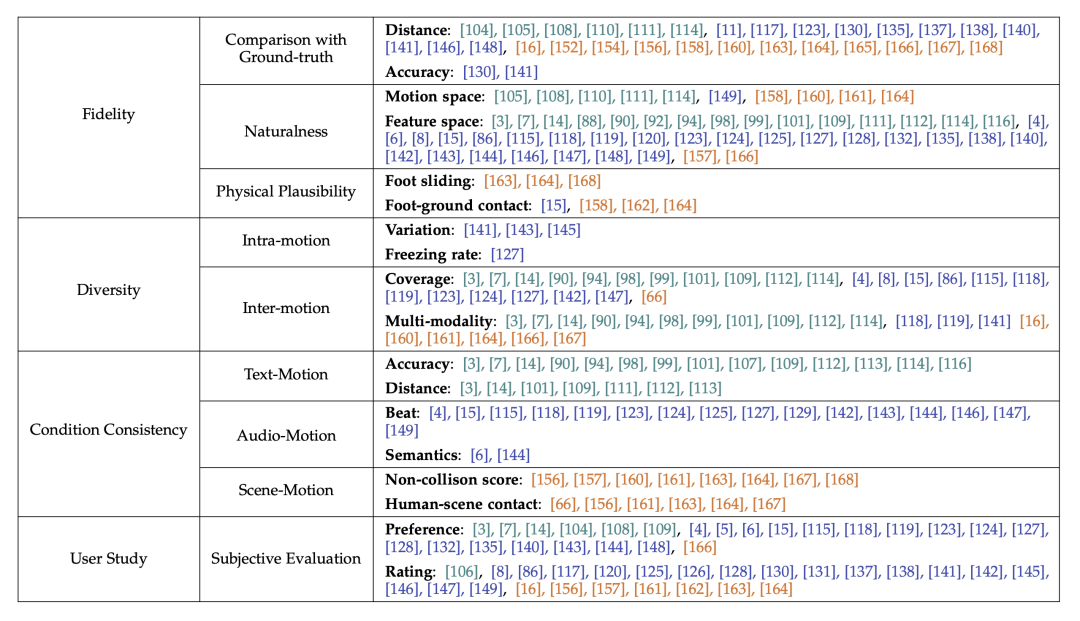

我们总结了从不同角度评价生成动作的常用指标,包括真实性、多样性、条件一致性、主观评测等等,如表3所示。这些指标可以帮助研究者比较不同方法的性能,推动领域的发展。此外,我们也探讨了现有评价指标的局限性。

表3. 人体动作生成主要评价指标总结。绿色、蓝色、橙色分别代表文本驱动、音频驱动和场景驱动的研究工作。

05

未来展望

尽管这个领域取得了迅速的进展,但仍存在一些重大挑战需要未来的探索。有鉴于此,我们从不同角度展望了几个富有前景的未来研究方向,以期能激发人体动作生成研究的新突破。未来的工作可以从数据、语义、评价、可控性和互动性等方面进行深入研究,以实现更自然、真实、多样化的人体动作生成。

数据:收集高质量的人体动作数据具有挑战性,未来研究可以探讨使用异构数据源,通过弱监督学习方法或多模态基础模型整合数据优势。

语义:人体动作不仅仅是身体部位的运动,还具有丰富的非言语沟通功能。未来研究可以深入探讨从数据、方法和评价等方面捕捉人体动作与条件信号之间的高层语义关系。

评价:合适的动作评价指标至关重要,但具有挑战性。未来工作可以关注设计更符合人类感知且具有可解释性的客观评价指标。

可控性:生成内容的可控性在实际应用中非常重要。未来研究可以进一步探索可控性,以创造更用户友好的体验,例如交互式和细粒度编辑。

互动性:人体动作的互动性尚未得到充分探讨。未来研究可以关注人体动作生成在人际互动和人与环境互动背景下的应用,例如社交群体中的互动动作和动态可操作场景中的动作生成。

图文 | 朱文韬

Computer Vision and Digital Art (CVDA)

About CVDA

The Computer Vision and Digital Art (CVDA) research group was founded in 2007 within the National Engineering Laboratory for Video Technology at Peking University led be Prof. Yizhou Wang. The group focuses on developing computational theories and models to solve challenging computer vision problems in light of biologically plausible evidences of visual perception and cognition. The primary goal of CVDA is to establish a mathematical foundation of understanding the computational aspect of the robust and efficient mechanisms of human visual perception, cognition, learning and even more. We also believe that the marriage of science and art will stimulate exciting inspirations on producing creative expressions of visual patterns.

CVDA近期科研动态

— 版权声明 —

本微信公众号所有内容,由北京大学前沿计算研究中心微信自身创作、收集的文字、图片和音视频资料,版权属北京大学前沿计算研究中心微信所有;从公开渠道收集、整理及授权转载的文字、图片和音视频资料,版权属原作者。本公众号内容原作者如不愿意在本号刊登内容,请及时通知本号,予以删除。

点击“阅读原文”转论文地址

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง