新智元报道

编辑:润 alan

【新智元导读】为什么AI教父Geoffrey Hinton在自己退休之时,警告人类,自己为人类开启的AI之门,会通向人类无法控制的未来

Geoffrey Hinton一生都在教计算机学习。现在他担心人造大脑会控制人类的未来。

纽约客记者面对面深度采访了Hinton,从他人生经历展开,向大众解释了为什么,人工智能之父,会在自己的晚年,要疾呼:AI如果不加以控制将可能毁灭人类。

「人工智能如果能获得更多控制权,会有利于他实现几乎一切目标」Hinton 谈到人工智能的未来时说道,「研究问题是:如何防止它们想要控制一切?现在没有人知道答案。」

在你的大脑中,神经元排列成大大小小的网络。随着你的每一个动作、每一个想法,这些网络都在发生变化:神经元被纳入或排除,它们之间的联系在不断加强或者减弱。

这个过程无时无刻不在进行——就在你读这些文字的时候,它也在发生——其规模之大超乎想象。

人类有大约800亿个神经元,共享1万亿个连接。人类的头骨中包含了一个星系的星球,它们一直在变化。

Geoffrey Hinton,这位常被称为「人工智能教父」的计算机科学家,递给我一根手杖。

他说:「你需要一根这个。然后,他沿着一条穿过树林的小路向岸边走去。小路蜿蜒穿过一片绿树成荫的空地,经过一对棚屋,然后沿着石阶下到一个小码头。「这里很滑,」Hinton在我们开始下坡时提醒道。

新知识会以微调的形式融入你的现有网络。有时它们只是暂时的:如果你在聚会上遇到一个陌生人,他的名字可能只会在你记忆的网络中留下短暂的印象。

但它们也可能持续一生,比如说,如果这个陌生人成为了你的配偶。

因为新知识与旧知识相融合,你所知道的知识会影响你所学到的。

如果派对上有人告诉你他的阿姆斯特丹之行,第二天,在博物馆里,你的网络可能会让你容易记住Vermeer(荷兰著名画家)。这样,微小的变化就有可能带来深刻的转变。

Hinton说:「我们在这里举行了篝火晚会。」我们站在一块突出安大略乔治亚湾的岩石台阶上,乔治亚湾一直向西延伸到休伦湖。水面上岛屿星罗棋布。

2013 年,六十五岁的Hinton将一家三人初创公司以四千四百万美元的价格卖给谷歌,然后买下了这座岛屿。

在此之前,他在多伦多大学(University of Toronto)担任了三十年的计算机科学教授,是神经网络这个并不被外界看好的子领域的领军人物。

「成绩非常一般,因此大多数研究人员觉得这个技术方向基本上是在浪费时间」

Hinton回忆说:「我们的神经网络的能力还不如一个小孩。」

十九世纪八十年代,当他看到《终结者》时,电影中毁灭世界的人工智能 「天网 」是一个神经网络并没有出乎他的意料。他很高兴看到这项技术被导演如此看好。

从着火的小凹陷处,石头上因高温而产生的裂缝向外辐射。Hinton身材高大、苗条,是个英国人。他用棍子戳了戳那个地方。

作为一个典型的科学家,他总是对物理世界中发生的事情发表评论:动物的生活、海湾中的水流、岛屿的地质。

「我在木头下面放了一个钢筋网,这样空气就能进来,温度高到金属都变软了,」他用一种奇怪的语气说。「这才是真正的火,值得骄傲!」

数十年来,Hinton不断想办法,以巧妙的方式构建更大的神经网络。

他设计出新的方法来训练神经网络,不断提升性能。

他招募研究生,让他们相信神经网络并不是一个没有前途的方向。他认为自己参与的项目可能会在一个世纪后——在他死后取得成果。

与此同时,他中年就两次丧偶,独自抚养两个年幼的孩子。在一个特别困难的时期,家庭生活和研究的压力压得他喘不过气来,他认为自己已经尽了全力。

他说:「我在 46 岁的时候就死心了。」他没有预料到,大约十年前,神经网络技术会突然飞速进步。

计算机的速度越来越快,神经网络利用互联网上的数据,开始转录语音、玩游戏、翻译语言,甚至驾驶汽车。

就在Hinton的公司被收购的同时,人工智能开始蓬勃发展,OpenAI的ChatGPT 和谷歌的Bard等系统应运而生,许多人认为它们正在以不可预知的方式改变世界。

Hinton沿着海岸出发了,我跟在后面,脚下的碎石在晃动。他说:「现在看这个。他站在一块人头大小的巨石前,挡住了我们的去路。」

「这样你就能过去了,你把棍子扔过去」—— 他把自己的棍子扔到巨石的另一边——「然后这里和这里有支点,这里还有一个手扶点」。我看着他轻车熟路地爬过去,然后,我自己也试探性地迈出了同样的步伐。

Hinton与神经网络结缘

每当我们学习时,我们的神经元网络就会发生变化,但究竟是如何变化的呢?

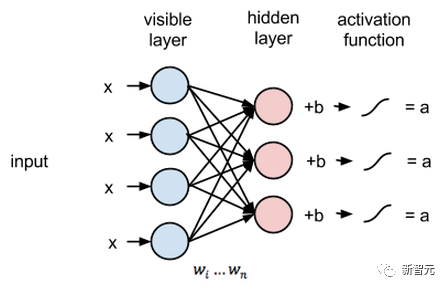

像Hinton这样的研究人员与计算机合作,试图发现神经网络的 「学习算法」,这是一个通过改变人工神经元之间连接的统计 「权重 」来吸收新知识的程序。

1949年,心理学家Donald Hebb就人们如何学习提出了一个简单的规则,通常被概括为 「同时激活的神经元将会连接在一起」。

大脑中的一组神经元一旦同步激活,就更有可能再次激活。这有助于解释为什么人类第二次做某事会感觉容易得多。

但很快人们就发现,计算机化的神经网络需要另一种方法来解决复杂的问题。

十九世纪六七十年代,作为一名年轻的研究人员,Hinton在笔记本上绘制了神经元网络,并想象着新知识到达它们的边界。

由几百个人工神经元组成的网络如何存储一个概念?如果这个概念有缺陷,它又该如何修正呢?

我们走过海岸,来到Hinton的小屋,这是岛上唯一的一间小屋。

小屋用玻璃封闭,高跷矗立在宽阔黝黑的岩石阶梯之上。有一次,我们来到这里,一条巨大的水蛇把头伸了过来。这是一段美好的回忆。

他的父亲是一位著名的昆虫学家,他的父亲向他灌输了对冷血动物的喜爱。

小时候,他和父亲在车库里养了很多毒蛇、乌龟、青蛙、蟾蜍和蜥蜴。如今,当Hinton在岛上时–他经常在温暖的月份去岛上–他有时会找到蛇并把它们带到家里,这样他就可以在一个饲养箱里观察它们。

他一生都在自下而上地思考问题,因此善于观察非人类的思维。

今年早些时候,Hinton离开了谷歌。他担心人工智能可能对人类造成危害,并开始在接受采访时谈论这项技术可能对人类构成的 「生存威胁」。

他越是使用ChatGPT——一个在大量人类写作语料库中训练出来的人工智能系统——就越是感到不安。

有一天,福克斯新闻的人写信给他,要求就人工智能问题进行采访。Hinton喜欢用电子邮件发送尖刻的单句回复——在收到一封来自加拿大情报机构的长信后,他回复道:「斯诺登是我的英雄」。

最后,他回复道:「Fox News is an oxy moron.」。然后,他灵机一动,问 ChatGPT 能否解释他的笑话。

系统告诉他,他的句子暗示福克斯新闻是假新闻,当他提示「moron 」前有个空格时,系统解释说福克斯新闻会让人上瘾,就像药物「OxyContin」一样。

Hinton大吃一惊。这种理解水平似乎代表了人工智能的一个新时代。

我们有很多理由担心人工智能的不断发展。例如,担心人类工作被计算机取代就是一个很正常的事情。

但是,Hinton与包括OpenAI首席执行官Sam Altman在内的许多著名技术专家一起警告外界,人工智能系统可能会开始独立思考,甚至试图取代或消灭人类文明。

人工智能最杰出的研究人员之一竟然说出了如此令人震惊的观点。

人类智能,到底能孕育出什么

他站在自家厨房里对我说:「很多人说,LLM就是一个很高级的自动完成功能」。

他一生中大部分时间都在忍受背痛的折磨,最终严重到他完全没办法坐着。自2005年以来,他从来没有坐着超过1个小时。

「现在,让我们来分析一下。假设你想成为预测下一个单词的高手。如果你想成为真正的高手,就必须理解别人在说什么。」

「这是唯一的办法。因此,通过训练让某个东西真正擅长预测下一个单词,实际上就是强迫它去理解。是的,这是确实只是「自动补全」–但你并没有想清楚拥有一个真正好的「自动补全」意味着什么」。

Hinton认为,大型语言模型,例如OpenAI聊天机器人背后的GPT技术,是可以理解单词和想法的含义的。

那些认为我们高估了人工智能能力的怀疑论者指出,人类思维与神经网络之间存在着巨大的差异。

首先,神经网络的学习方式与我们不同:我们是有组织地获取知识,通过经历和把握这些经历与现实和自身的关系。

而神经网络则是抽象地学习,通过处理有关它们并不真正居住的世界的庞大信息库。

但Hinton认为,人工智能系统所展示的智能超越了其人工起源。

他告诉我:「当你吃东西时,你把食物吃进去,然后把它分解成微小的各个部分。所以你可以说,我身体里的各个部分都是由其他动物的各个部分组成的。但这是不可能的。」

他认为,通过分析人类的书写,像GPT这样的大型语言模型可以了解世界是如何运作的,从而产生一个能够思考的系统。

而书写只是这个系统所能做的一部分。他接着说:「这就好比毛毛虫如何变成蝴蝶。毛毛虫变成蛹,然后从蛹里破茧成蝶」。

他开始在厨房外的一个小柜子里翻找起来。「啊哈!」他说。他兴致勃勃地把一个东西放在柜台上——一只死蜻蜓。

它保存得非常完好。他解释说:「这是我在码头发现的。它刚在石头上孵化出来,正在晾干翅膀,所以我把它捉住了。看看下面。」

Hinton捕捉到的这只蜻蜓刚从幼虫形态中蜕变出来。这只幼虫长相迥异,有自己的眼睛和腿。它的背部有一个洞,蜻蜓就是从这个洞里爬出来的。

「蜻蜓的幼虫是生活在水下的怪物,」Hinton说。「就像电影《异形》中一样,蜻蜓从怪物的背部爬出。幼虫在这个阶段变成了液体,然后蜻蜓从液体中诞生了。」

在他的比喻中,幼虫代表了用于训练现代神经网络的数据,蜻蜓则代表了由此产生的人工智能。

深度学习——Hinton开创的技术——导致了这种蜕变。

我弯下腰,想看得更清楚一些。Hinton站得笔直,他几乎总是这样,小心翼翼地保持着姿势。

「非常漂亮,」他轻声说。「你明白了吧。一开始是一个东西,现在却变成了另一个完全不一样的东西。」

几周前,当Hinton邀请我参观他的小岛时,我曾想象过可能出现的情况。也许他是一个想要独处的内向者,或者是一个有着上帝情结和未来主义情结的科技霸主。

在我抵达的前几天,他通过电子邮件发送了一张他拍摄的照片,照片上一条响尾蛇盘踞在岛上的草丛中。我不知道自己是感到高兴还是害怕。

事实上,就私人岛屿而言,Hinton的岛屿并不算大,总共只有两英亩。

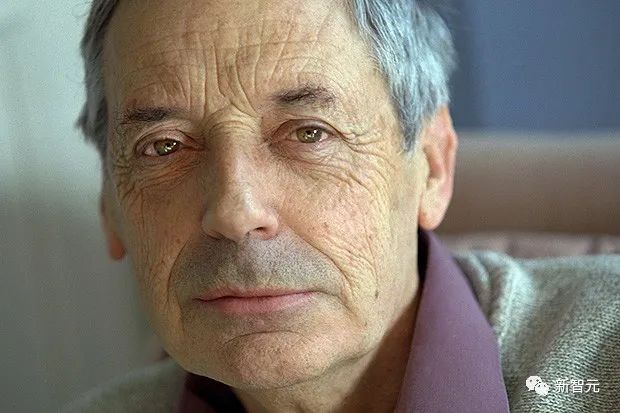

Hinton本人与硅谷的技术大亨截然相反。现年七十五岁的他有着Joshua Reynolds画作中的英伦面孔,白发衬托着宽阔的前额。他的蓝眼睛通常很稳重,只留下嘴巴来表达情感。

他是一个善于侃侃而谈的人,喜欢谈论自己。

但是他告诉作者,他并不是一个自负的人,他的生活一直笼罩在悲痛之中。

「我也许应该告诉你我的妻子们的事情,」我们第一次交谈时他说。「我有过三次婚姻。一次友好结束,另外两次悲剧收场」。

他与早年结婚的第一任妻子Joanne仍然保持着友好关系,但他的第二任和第三任妻子Rosalind和Jackie都分别于1994年和2018年死于癌症。

在过去的四年里,Hinton一直和退休社会学家Rosemary Gartner在一起。

她温柔地告诉我:「我觉得Hinton是那种总是需要伴侣的人。他是一个浪漫的理性主义者,对科学和情感有着平衡的感性认识。

他把蜻蜓放好,然后走到一张小书桌前,那里摆放着一台笔记本电脑,旁边是一堆数独谜题和一本记有电脑密码的笔记本。(他很少用笔记本,因为他设计了一套记忆系统,能在脑子里生成并回忆起很长的密码)。他问道:「我们来画画我的家谱吧?」他用两根手指输入了 「Geoffrey Hinton家谱」,然后按了回车键。

Hinton的家谱

2013 年,谷歌收购了Hinton的初创公司,部分原因是该团队发现了如何利用神经网络大幅提高图像识别能力。现在,屏幕上出现了无穷无尽的家谱。

Hinton出身于一个特殊的英国科学世家:政治上激进,富有创造力。

在他的家谱中,他的叔祖父Sebastian Hinton是丛林健身器的发明者,他的堂姐Joan Hinton是参与曼哈顿计划的物理学家。

在他上一辈,还有Lucy Everest,她是第一位当选为英国皇家化学研究所成员的女性。

Charles Howard Hinton,是一位数学家,创造了魔方的概念,魔方是通往四维空间的大门(电影《星际穿越》中出现了一个魔方)。

James Hinton,他是一位开创性的耳外科医生。19 世纪中叶,希顿的曾曾祖父、英国数学家George Boole发明了二进制推理系统,即现在的布尔代数,它是所有计算的基础。

Boole的妻子Mary Everest是一位数学家和作家,也是George Everes的侄女。

「Hinton生来就是搞科学的料,」Hinton以前的学生和合作者、现在 Meta 公司负责人工智能的Yann LeCun告诉我。

然而,Hinton的家庭比这更奇怪。他的父亲Howard Everest Hinton于19世纪10年代墨西哥革命期间在墨西哥长大,在他父亲管理的银矿上工作。

「他是个狠人」Hinton这样评价他的父亲。

家族传说说,12岁时,Howard Everest Hinton曾威胁要射杀他的拳击教练,因为他的教练太严厉了,教练把他的话当真了,就逃离了小镇。

Howard的母语是西班牙语,在伯克利上大学时,他的口音曾被人嘲笑。「他和一群同样受到歧视的菲律宾人混在一起,成为了伯克利的激进分子。

在学校,Hinton喜欢自然科学。但是,出于意识形态的原因,他的父亲禁止他学习生物学。

在布里斯托尔大学任教的Howard是昆虫学家中的印第安纳-琼斯:他把世界各地的珍稀生物装在行李中偷运回英国,并编辑了一份该领域的重要期刊。

Hinton的中间名也是Everest,所以他感受到了巨大的压力,必须做出自己的成绩。

他记得父亲曾对他说:「如果你比我努力一倍,当你比我大一倍时,你可能会有我一半优秀。」

在剑桥大学,Hinton尝试了不同的领域,但他沮丧地发现自己从来都不是班上最聪明的学生。

他曾短暂地离开大学,「阅读令人沮丧的小说」,并在伦敦打零工,然后又回来尝试建筑学,但只做了一天。

最后,他涉猎了物理、化学、生理学和哲学,寻找重点,最终选择了实验心理学学位。

他在道德哲学家Bernard Williams的办公室里 「出没」,发现他对计算机和心灵很感兴趣。

有一天,Williams指出,我们不同的思想一定反映了我们大脑中不同的物理设定。这与计算机中的情况完全不同,在计算机中,软件独立于硬件。

Hinton被这一观察所震撼;他记得在高中时,一位朋友曾告诉他,记忆可能是以 「全息 」的方式存储在大脑中的——也就是说,记忆是分散的,但可以通过任何一个部分访问整体。

他所遇到的是 「连接主义」—— 一种结合神经科学、数学、哲学和编程的方法,旨在探索神经元如何共同 「思考」。

「联结主义」的一个目标是在计算机中创建一个类似大脑的系统。

这方面已经取得了一些进展:1950 年代,心理学家、联结主义先驱Frank Rosenblatt制造了一台机器,名为 「感知器(Perceptron)」,它使用简单的计算机硬件模拟了一个由数百个神经元组成的网络。

当连接到光线传感器时,该仪器可以通过跟踪不同光线模式激活了哪些人工神经元来识别字母和形状。

在小屋里,Hinton站着来回踱步,在厨房柜台后面来回走动,并在一楼转了一圈。

他做了一些吐司,给我们每人拿了一个苹果,然后用阶梯凳为自己支起了一张小桌子。

家庭的压力让他无法满足暂时的需求。「我一直很喜欢木工活,」我们吃饭时,他俏皮地回忆道。「在学校,我晚上自己会去做木工。我经常在想,如果我是一名建筑师,是否会更快乐,因为我不必强迫自己去做。

而对于科学,我总是不得不强迫自己。因为家庭的原因,我必须成功,我必须找到一条路。这其中有快乐,但更多的是焦虑。现在我成功了,这让我感到无比欣慰。」

Hinton的笔记本电脑叮当作响。自从他离开谷歌后,他的收件箱里就不断收到关于人工智能的评论请求。他走过去看了看邮件,然后又迷失在家族树的森林里,所有这些树似乎都有这样或那样的问题。

他说:「看看这个。」

我走过去看了看屏幕。这是一棵 「学术家谱」,亨廷顿在最上面,下面排列着他的学生和他们的学生。

这棵树太大了,他必须横向滚动才能看到他的影响范围。「哦,天哪,」Hinton说。「她其实不是我的学生。”」他进一步滚动。「他才华横溢,却不善于当顾问,因为他自己总能做得更好。」

Hinton是一位精心培育人才的人,他似乎很享受被学生超越的感觉:在评估求职者时,他经常问他们的顾问:「他们比你强吗?」

回忆起1977年去世的父亲,Hinton说:「他非常好胜。我经常在想,如果他能在我身边看到我取得成功,他会不会很高兴。因为现在我比他更成功。」

根据谷歌学术的数据,Hinton现在是心理学家中被引用次数第二多的研究者,也是计算机和认知科学家中被引用次数最多的研究者。

如果说他在剑桥大学的起步是缓慢而古怪的,那么部分原因是他在一个新兴领域探索。

他合上笔记本电脑,说道:「神经网络——当时在好大学里做这个的人很少。在麻省理工学院做不了,在伯克利做不了,斯坦福也不行。」

所以Hinton作为一个新兴技术的开创者也给他带来了优势。多年来,许多最优秀的人才都来找他。

「天气不错,」希顿第二天早上说 「我们应该去砍棵树。」 他穿着一件正装衬衫,看起来不太像伐木工人。

不过,他还是搓了搓手。在岛上,他总是在砍树,以创造更有序、更美丽的场景。

几乎每个房间都有需要改的地方,在我参观的时候,Hinton已经在这些地方上上附上了小纸条,来提醒新的工人,而且经常就直接写在建筑材料上。

在一楼的浴室里,靠墙的一块底板上写着:「浴室应使用这种底板(仅限淋浴前的枫木装饰)」。在客房的壁橱里,遮蔽胶带沿着架子延伸: 「不要给架子打底,给架子支撑打底」。

给事物贴标签对人的思维很有帮助,可以帮助他们把握现实。

但人工智能这么做意味着什么呢?当Hinton在爱丁堡大学获得人工智能博士学位时,他想到了如何在计算机中模拟大脑中的 「认知」。当时,也就是 1970 年代,绝大多数人工智能研究人员都是 「符号主义者」。

在他们看来,对番茄酱的认识可能涉及许多概念,如 「食物」、「酱汁」、「调味品」、「甜味」、「鲜味」、「红色」、「西红柿」、「美国人」、「炸薯条」、「蛋黄酱 」和 「芥末」;这些概念合在一起,就形成了一个脚手架,「番茄酱 」这样一个新概念就可能被挂在上面。

一个资金雄厚的大型人工智能项目名为 「Cyc」,其核心是建立一个庞大的知识库,科学家们可以使用一种特殊的语言将概念、事实、规则以及不可避免的例外情况输入其中。(鸟会飞,但企鹅、翅膀受损的鸟或……)。

但是,Hinton对这种方法表示怀疑。这种方法似乎过于僵化,过于专注于哲学家和语言学家所拥有的推理能力。

他知道,在自然界中,许多动物在没有获得可以用语言表达的概念的情况下也能做出聪明的行为。它们只是通过经验学会了如何变得聪明。

学习,而不是知识,才是智慧的动力。

人类的复杂思维似乎往往是通过符号和文字进行的。但是,Hinton和他的合作者James L. McClelland以及David Rumelhart认为,很多行为都发生在次概念层面。

他们写道,请注意,「如果你了解了关于某个物体的新事实,你对其他类似物体的预期往往会发生变化」:例如,如果你被告知黑猩猩喜欢洋葱,你可能会猜测大猩猩也喜欢洋葱。

如何感受到神经网络的魅力

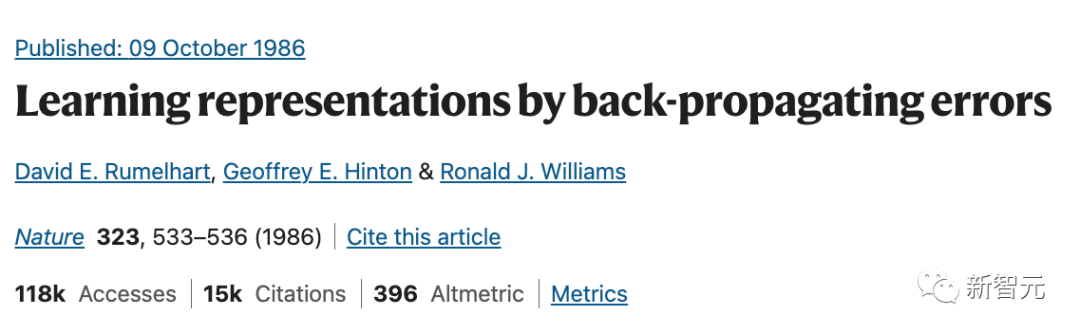

1986年,Hinton、Rumelhart和Williams在《自然》杂志上发表了一篇三页的论文,展示了这样一个系统如何在神经网络中工作。

他们指出,像玻尔兹曼机一样,反向传播并不是「大脑学习的合理模型」。与计算机不同,大脑无法倒带以审核其过去的表现。但反向传播仍然实现了类似大脑的神经特化。

在真正的大脑中,神经元有时被排列成旨在解决特定问题的结构。例如,在视觉系统中,不同的神经元「列」识别我们所看到的边缘。

因此,负责破译笔迹的网络的某些层可能会紧紧地集中在识别线条、曲线或边缘上。最终,整个系统可以发展出「适当的内部表示」。

在十九世纪五十年代和六十年代,感知器和联结主义曾短暂兴起,又渐渐衰落。反向传播作为其中的一部分,也获得了广泛的关注。

但是,受限于当时的硬件能力,构建反向传播网络的实际工作进展缓慢。「进步的速度基本上是,计算机能在一夜之间学到多少东西?」Hinton回忆道。

从概念上讲,神经网络是神秘的。不可能以传统方式编程。你不能进去编辑人工神经元之间连接的权重。而且,很难理解这些权重意味着什么,因为他们已经通过训练适应和改变了自己。

学习过程有很多种方式可能会出错。例如,在「过度拟合」中,网络有效地记住了训练数据,而不是从中学习泛化。避免各种陷阱并不总是那么简单。

新的神经网络架构被开发出来:「循环」和「卷积」网络允许系统通过以不同的方式构建自己的工作来取得进展。但就好像研究人员发现了一种他们不知道如何使用的外星技术。

「我一直相信这不是胡说八道,这不是信仰——对我来说只是完全显而易见的事实」,Hinton说。大脑使用神经元来学习,因此,通过神经网络进行复杂的学习必须成为可能。

当网络通过反向传播进行训练时,需要告诉他们什么时候错了,错了多少,这需要大量准确标记的数据。这将使网络能够看到手写的「7」和「1」之间的区别,或者金毛猎犬和红色二传手之间的区别。

但是很难找到足够大的标记良好的数据集,而且构建数据集是一项艰巨的任务。LeCun和他的合作者开发了一个巨大的手写数字数据库,后来他们用它来训练一个网络,可以读取美国邮政服务提供的样本邮政编码。

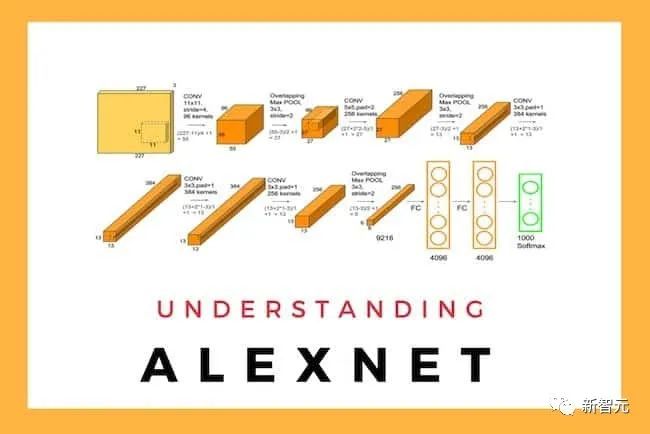

斯坦福大学的李飞飞教授率先开展了一项名为ImageNet的巨大研究。创建它需要收集超过 1400 万张图像,并手动将它们分类为两万个类别。

随着神经网络变得越来越大,Hinton设计了一种将知识从大型网络获取到可以在手机等设备上运行的较小网络的方法——蒸馏。

在蒸馏学习中,一个神经网络不仅为另一个神经网络提供正确的答案,还为另一个神经网络提供一系列可能的答案及其概率。这是一种更丰富的知识。

Hinton并不爱反向传播网络,因为这一切都是确定性的。不过,随着计算机性能的进步,反向传播的力量变得不可否认。

Hinton在脑海中做了一个计算。假设在1985年,他开始在一台快速研究计算机上运行一个程序,并一直运行到现在。如果他今天开始在目前人工智能使用的最快系统上运行相同的程序,那么只需不到一秒钟的时间就可以赶上。

在2000年左右,随着配备强大计算机的多层神经网络开始在更大的数据集上进行训练,Hinton、Bengio 和 LeCun 开始谈论「深度学习」的潜力。

这项工作在2012年跨过了一个门槛,当时Hinton,Alex Krizhevsky和Ilya Sutskever推出了AlexNet,这是一个八层神经网络,最终能够以人类水平的精度识别ImageNet中的对象。

2017年6月,Hinton、Bengio和LeCun获得了图灵奖,相当于计算机科学领域的诺贝尔奖。

Hinton相信,在某种意义上,神经网络能够产生感觉。他认为感觉是关于什么会导致行动的反事实陈述。

Hinton告诉我,他在1973年看到了一个「沮丧的人工智能」。一台计算机连接到两个电视摄像机和一个简单的机械臂上,该系统的任务是将一些积木组装成玩具车的形式。

Hinton说,「这很难,尤其是在1973年,如果这些积木都是分开的,视觉系统可以识别它们,但如果你把它们放在一小堆里,就无法识别。」

计算机无法处理这个问题,所以砰的一声,把它们摊在桌子上。如果一个人这样做了,你会说他很沮丧。这就像是想要你无法拥有的东西。

Hinton说,「每个人对人工智能的第一反应是,我们必须阻止这种情况。就像每个人对癌症的第一反应是,我们该如何切除它?但重要的是要认识到,当剪掉它只是一个幻想时。」

他叹了口气,「我们不能否认,我们需要思考,我们如何让它对人类来说不像它可能的那样可怕?」

人工智能会变得多么有用或危险?没有人确切知道,部分原因是神经网络太奇怪了。

在二十世纪,许多研究人员想要制造模仿大脑的计算机。但是,尽管像OpenAI 的GPT模型这样的神经网络是类脑的,因为它们涉及数十亿个人工神经元,但它们实际上与生物大脑截然不同。

今天的人工智能是基于云端的,存储在工厂一般的数据中心中。它们在某些方面能力很差,而在其他方面却很智能,它们为数百万用户推理,但只有在收到提示时才会回复。

他们可能已经通过了图灵测试——这是由计算先驱Alan Turing建立的长期标准。

该标准认为,任何能够在对话中令人信服地模仿人类的计算机都可以合理地说是思考。

在谷歌的最后几年里,Hinton专注于使用更接近大脑的硬件来创造更传统的类似思维的人工智能。在当今的人工智能中,人工神经元之间连接的权重以数字方式存储,就好像大脑在记录自己一样。

然而,在实际的模拟大脑中,权重被内置在神经元之间的物理连接中。Hinton致力于使用专门的计算机芯片创建该系统的人工版本。

芯片将能够通过改变它们的「电导」来学习。由于权重将集成到硬件中,因此不可能将它们从一台机器复制到另一台机器。每个人工智能都必须自己学习。「他们必须去上学。」

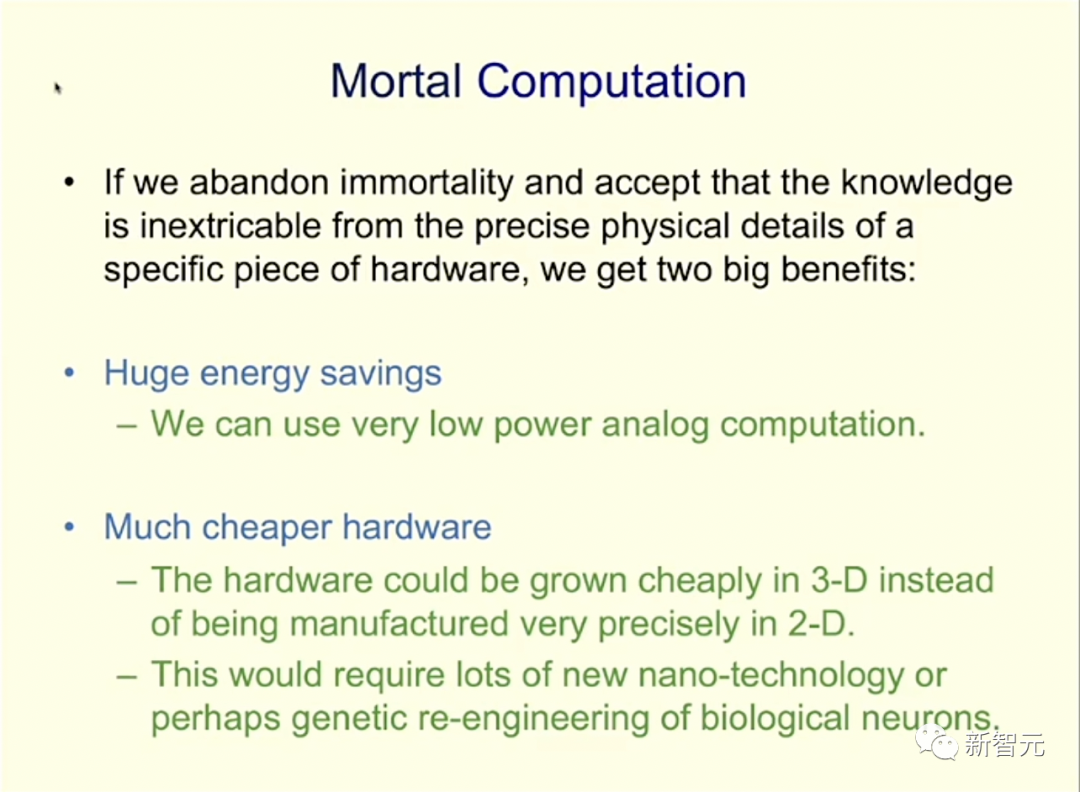

因为每个人工智能芯片获得的知识在被拆解时都会丢失,所以他称这种方法为「凡人计算(Mortal Computation)」。

在这种情况下,我们会得到更重要的东西,那就是能源效率。此外,能源效率鼓励个性:因为人类的大脑可以靠燕麦片运行,所以世界可以支持数十亿个大脑,所有大脑都不同,每个大脑都可以不断学习。

作为一项科学事业,「凡人计算」可能会让我们更接近于复制自己的大脑。但Hinton认为,数字智能可能更强大。在模拟智能中,如果大脑死亡,知识就会死亡。

相比之下,在数字智能中,如果一台特定的计算机死了,这些相同的连接强度可以在另一台计算机上使用。即使所有的数字计算机都死了,如果你把连接强度存储在某个地方,你就可以制造并运行另一台数字智能。

一万个神经网络可以同时学习一万个不同的东西,然后分享他们所学到的东西。这种不朽和可复制性的结合表明,我们应该关注数字智能取代生物智能的问题。

Hinton怀疑,对人工智能潜力的怀疑虽然令人欣慰,但往往是出于对人类例外论的不合理信念。他对当前人工智能聊天机器人「产生幻觉」这个说法提出了质疑。

「这就是人类记忆的样子。在我们看来,编造和说实话之间没有界限。说实话只是正确地编造。从这个角度来看,ChatGPT的编造能力是一个缺陷,但也是其类人智能的标志。」

Hinton经常被问到他是否后悔自己的工作。他没有。

他说,当他开始研究时,没有人认为这项技术会成功,即使它开始成功,也没有人想到它会这么快成功。正是因为他认为人工智能是真正的智能,所以他期望它将在许多领域做出贡献。

然而,他担心当有权势的人滥用它时会发生什么。蜕变还没有完成。我们不知道人工智能会变成什么样子。

对一些人来说,这是一个哥白尼式的故事,在这个故事中,我们对人类思维特殊性的直觉正在被思考的机器所取代。对其他人来说,这是普罗米修斯——偷了火,我们就有可能被烧死。

有些人认为我们在自欺欺人,被我们自己的机器和希望从中获利的公司所吸引。以一种奇怪的方式,它也可能是一个关于人类局限性的故事。

如果我们是神,我们可能会制造出一种不同的人工智能——一种我们可以管理的版本。

参考资料:https://www.newyorker.com/magazine/2023/11/20/geoffrey-hinton-profile-ai

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง