点击下方卡片,关注「集智书童」公众号

尽管伪标签方法在半监督目标检测任务中取得了显著的成功,但本文揭示了该方法存在的一些显著局限性。具体而言,伪标签方法往往会放大检测器的固有优势,同时突出其弱点,这体现在伪标签的遗漏,尤其是在小型和尾部类别物体上。

为了克服这些挑战,本文提出了一种名为Mixed Pseudo Labels(MixPL)的方法,包括Mixup和Mosaic用于伪标签数据,以减轻伪标签遗漏的负面影响,并使模型在不同的物体尺度上学习平衡。此外,通过与相关实例重新采样标记数据,提高了模型在尾部类别上的检测性能。

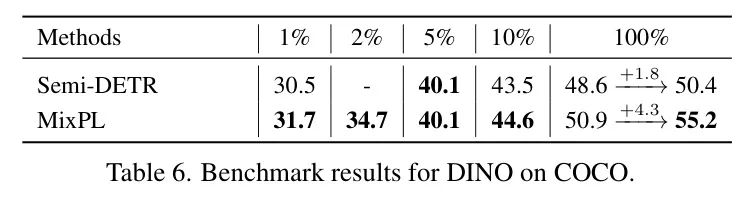

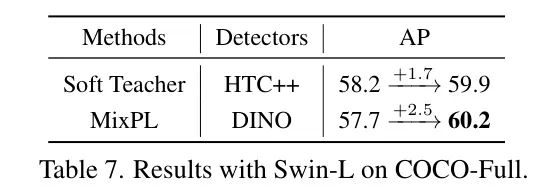

值得注意的是,MixPL始终改进了各种检测器的性能,并在COCO-Standard和COCO-Full基准测试上,与Faster R-CNN,FCOS和DINO相比,获得了新的最先进的结果。此外,MixPL在大模型上也表现出良好的可扩展性,将DINO Swin-L的mAP提高了2.5%,并在COCO val2017基准测试上,无需额外标注,实现了新的记录(60.2% mAP)。

代码:https://github.com/Czm369/MixPL

1 Introduction

在深度学习时代,目标检测取得了显著的进展,但高度依赖昂贵的人工标注。因此,半监督学习越来越受到研究兴趣的青睐,它利用 未标注 数据来提高检测器性能,而不只是依赖标注。

半监督学习方法包括从模型预测中生成伪标签,用于 未标注 数据,并使用它们训练学生模型。这种范式在图像分类方面取得了广泛成功,但在目标检测方面面临显著挑战。因为目标检测器需要在图像中检测大小和数量不同的目标,其预测结果,后来用作伪标签,可能会遗漏目标,或者包含背景区域的边界框。此外,检测器在检测不同尺度和类别目标时具有不同的能力,导致伪标签和 GT 之间的目标分布存在显著差异。因此,伪标签在识别大型目标和突出类别方面取得了显著改进,但对于识别小目标和尾部类别仍提供有限帮助。

在半监督目标检测(SSOD)的前期方法中,通过增强检测器特定组件来提高伪标签质量或学习效率,但这些方法在不同模型之间缺乏通用性。相比之下,作者的方法通过针对不同尺度和类别进行调整,利用伪标签与 GT 之间的差异,在普遍意义上提升模型性能。

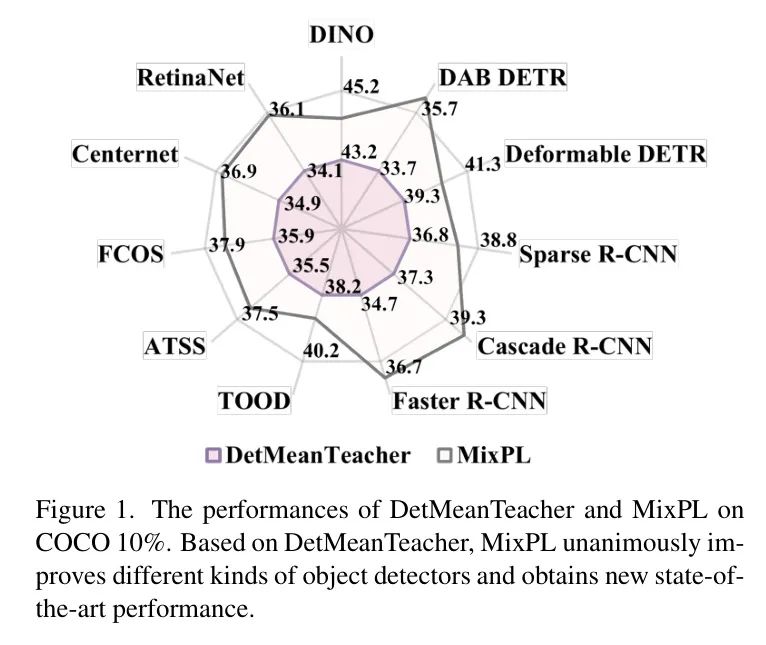

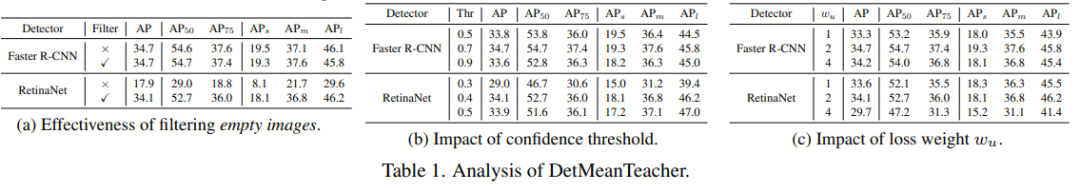

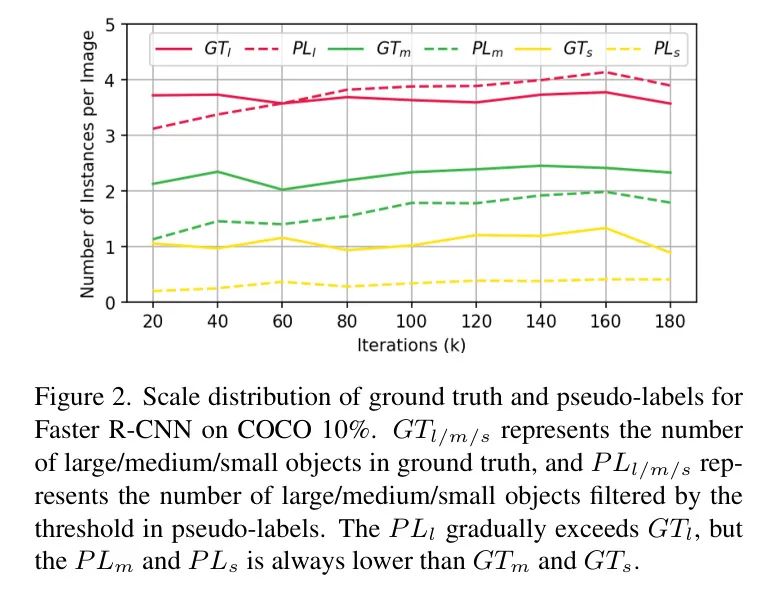

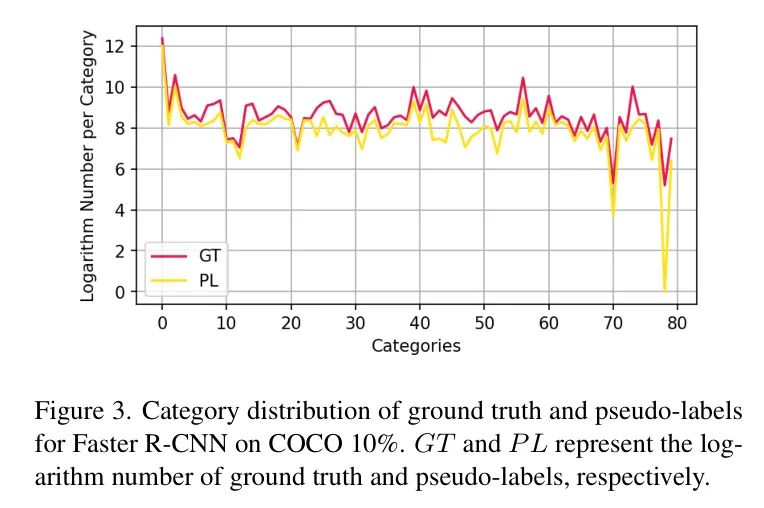

为了实现这一目标,作者首先总结了一个检测MeanTeacher框架。与图像分类中的MeanTeacher类似,DetMeanTeacher在概念上简单,适用于所有类型的目标检测器。尽管MeanTeacher被用作前期SSOD方法的基本框架,但作者发现它在实际应用中使DetMeanTeacher在不同的目标检测器上运行具有挑战性,尤其是在一阶段检测器上。这些检测器需要过滤掉没有伪标签的图像,因为它们与 GT 存在显著偏差。这启发作者利用DetMeanTeacher测量伪标签与 GT 之间的数量、尺度和类别差异。如图2和图3所示,作者基于DetMeanTeacher对Faster R-CNN生成的伪标签进行统计分析,并提出了Mixed Pseudo Labels(MixPL)以及带标记重采样,以提高检测器的半监督性能。

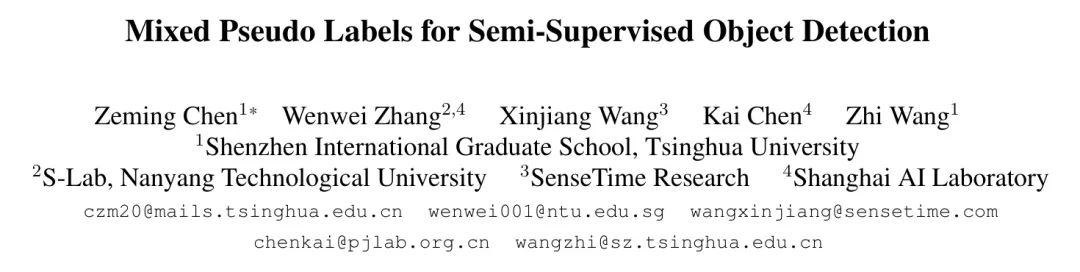

数量。在早期训练中,伪标签的数量明显低于 GT 值。实际上,由于背景-前景样本不平衡,模型倾向于将样本标记为背景。伪标签通过优化 未标注 数据中的遗漏前景,加强了将样本分类为背景的偏差。尽管遗漏检测难以避免,作者提出了Pseudo Mixup以减少负面影响。这种技术涉及将两个伪标记图像以像素方式叠加,通过使它们更类似于实际负样本,有效地减轻了错误负样本的整体负面影响,如图4所示。

尺度。在整个训练过程中,伪标签中的大型物体数量逐渐超过 GT 值,而小和中型物体始终落后于 GT 值,如图2所示。检测器在处理小型物体上存在困难,伪标签在 未标注 数据优化过程中,将它们视为背景,进一步加剧了这一问题。然而,模型在检测大型物体方面表现出色,因此作者提出了Pseudo Mosaic,将伪标签中的大型物体转换为小型物体。Pseudo Mosaic将4个下采样伪标记图像结合在一起,为小和中型物体提供更多标签,并增强跨尺度检测能力。

类别。在训练后,头类别伪标签的数量与 GT 值相匹配,而某些尾类别存在缺陷,如图3所示。与尺度问题类似,检测器在处理尾类别物体上存在困难,伪标签在 未标注 数据优化过程中,将这些物体视为背景,甚至导致某些尾类别检测性能下降。与解决尺度问题不同,作者无法将头类别伪标签转换为尾类别。因此,作者提出带标记重采样,在标记数据中过采样尾类别。尽管这可能减少头类别样本,但模型可以从 未标注 数据中有效提取头类别伪标签,确保所有类别上的性能。

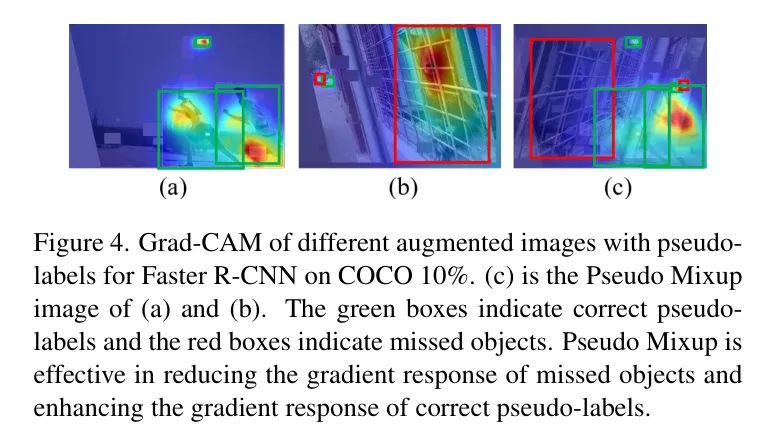

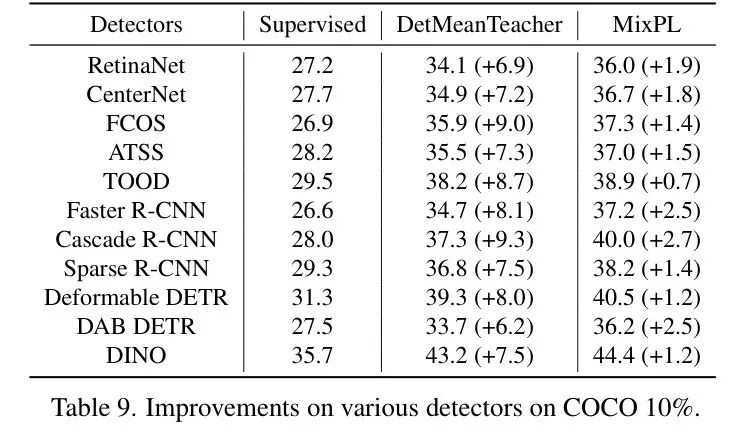

作者在DetMeanTeacher和MixPL上进行了广泛的实验。如图1所示,DetMeanTeacher在COCO 10%上与各种检测器通用。MixPL进一步提高了DetMeanTeacher在不同检测器上的性能,并在COCO-Standard和COCO-Full基准测试上,与Faster R-CNN,FCOS和DINO相比,获得了新的最先进结果。此外,与Swin-L[26]和DINO[44]相结合,MixPL表现出良好的可扩展性,并在COCO val2017上,无需额外标记数据,实现了新的记录(60.2% mAP)。

2 Related Works

Semi-supervised image classification

半监督图像分类旨在通过使用 未标注 数据与标记数据相结合来提高分类器。图像分类的半监督学习技术可以分为两种范式:

- 伪标签,它使用模型在 未标注 数据上的预测作为标签来训练模型;

- 一致性正则化,它强加同一图像模型预测的一致性。

最近,[1, 31, 36, 41, 47] 的进展协同地将这两种范式结合起来。FixMatch等代表方法预测弱增强的 未标注 图像上的伪标签,然后在强增强的伪标签图像上训练模型以确保弱增强和强增强之间的一致性。值得注意的是,这些半监督方法通常适用于不同的分类器,并且不是针对特定架构进行定制的。同样地,本文旨在设计一个有效的检测器无关的半监督目标检测(SSOD)方案。

Object detection

目标检测需要识别和定位图像中的感兴趣目标。由于图像中的目标尺度、位置和数量不同,因此提出了不同的检测架构来应对这些挑战,包括一阶段检测器,两阶段或级联检测器,以及检测器 Transformer (DETR)。与检测架构不同,不同的特征金字塔网络(FPN)被开发出来以增强多尺度特征并跨尺度检测目标。值得注意的是,本文验证了MixPL在各种不同结构的检测器上的有效性。

Data augmentation

数据增强在视觉感知和半监督学习中至关重要。除了像颜色抖动、缩放和翻转等光度变换和几何变换,混合训练数据的增强在半监督学习和目标检测中变得流行,例如CutOut,Random Erasing,Mixup,和Mosaic。尽管Mixup和Mosaic有广泛的应用,但本文揭示了它们在SSOD中的新作用,从而克服了伪标签的局限性。

Semi-supervised object detection

与只有单一错误类型的分类器预测不同,检测器预测中存在多种错误类型,包括遗漏的目标、错误的类别或不准确的位置的边界框。因此,除了直接采用现有的半监督学习范式,最近的方法探索了特定目标检测器的特殊设计,以提高伪标签的质量并探索更好的学习策略。例如,SoftTeacher利用R-CNN过滤不确定的伪标签,但无法轻松地转移到一阶段检测器。Dense Teacher探索一阶段检测器中的密集标签学习,使其不直接适用于两阶段检测器。PseCo通过利用FPN实现尺度不变性,这可能存在于DETR中。

尽管获得了有前景的结果,但这些特殊设计可能限制了它们的应用范围,并阻碍了从统一视角理解SSOD。相比之下,本文研究了SSOD中伪标签的常见问题,而无需对检测器架构做出任何假设。

3 Detection MeanTeacher

在这项研究中,作者旨在探索适用于不同目标检测器的有效SSOD方法。因此,本文从分析MeanTeacher框架开始,该框架是最近SSOD方法中共享的核心框架。

如图5所示,MeanTeacher框架包含一个教师模型和一个学生模型,它们具有相同的结构。在每个训练迭代中:

-

标记图像和 未标注 图像按照给定的比例随机采样,形成一个批次。

-

每个 未标注 图像通过弱增强和强增强进行增强,以获得两个视图,教师模型在弱增强的图像上预测伪标签。

-

伪标签通过置信度阈值进行过滤,并转换为强视图,形成具有强烈增强的伪标签数据。

-

学生模型通过优化基于标记和伪标记数据的监督损失和无监督损失进行更新,而教师模型则使用学生的指数移动平均(EMA)进行更新。

从理论上讲,MeanTeacher框架不假设特定的检测器结构,因此应适用于所有类型的检测器。为了验证这一点并了解MeanTeacher对不同检测器的影响,作者分别以单阶段检测器RetinaNet和两阶段检测器Faster R-CNN为例,应用MeanTeacher进行半监督学习。分析在COCO数据集上进行,其中10%的数据标记,其余90%的数据 未标注 。在COCO 10%标记数据上的Faster R-CNN和RetinaNet的监督 Baseline 分别为26.6% AP和27.2% AP。Faster R-CNN和RetinaNet用于过滤伪标签的置信度阈值分别为0.7和0.4。

过滤没有伪标签的图像。如表1a所示,Faster R-CNN在监督 Baseline (34.7% vs. 26.6% AP)上获得了合理的改进。相比之下,RetinaNet甚至无法超越其监督 Baseline ,仅实现17.9% AP。作者实际发现,在RetinaNet的训练过程中,一些图像(简称为_空图像_)实际上没有包含任何伪标签。这是因为教师模型并非完美,其中一些预测的边界框具有低置信度,将被置信度阈值过滤掉。由于一阶段检测器中正负样本之间的差异是一种固有问题,这些问题在这些_空图像_上可能会被显著加剧,从而使训练不稳定。为了解决这个问题,作者在训练中过滤这些_空图像_,即学生模型不会在这些_空图像_上学习。这种简单的策略带来了RetinaNet的90.5%相对改进,实现了34.1% AP。

平衡伪标签的精度和召回率。作者研究了使用过滤_空图像_策略来稳定训练的影响。如表1b所示,RetinaNet和Faster R-CNN各自具有其最优置信度阈值,其偏差会导致明显的性能下降。结果表明,对于MeanTeacher的有效性,需要一个合适的置信度阈值,这与特定的分类损失函数有关。

平衡标注数据和未标注数据的学习。作者研究了MeanTeacher中的的影响。观察到,在采用_空图像_过滤和较低置信度阈值时,RetinaNet和Faster R-CNN的最优为2,而不是以前研究中使用的。

提出的修改导致了一个适用于SSOD的通用框架,称为检测MeanTeacher,并采用了简单的策略来减少_空图像_的影响和伪标签的副作用。由于DetMeanTeacher简单而有效,与采用更复杂的设计的现有SSOD方法相比,在比较中具有竞争力。因此,作者将检测器与半监督学习框架解耦,使作者能够根据DetMeanTeacher观察到各种检测器之间伪标签与 GT 之间的差异的一致性。这一洞察启发了MixPL与标记重采样方法的提出。

4 Mixed Pseudo Labels

DetMeanTeacher的研究促使作者考虑伪标签中的遗漏检测,因为_空图像_可以被视为遗漏检测的极端案例,意味着遗漏了所有目标。因此,置信度阈值在一定程度上反映了遗漏检测的程度,而旨在确保遗漏检测的干扰小于监督学习的信号。遗漏检测的内在原因是前景-背景不平衡,导致模型倾向于将样本分类为背景。同时,由于模型在检测小目标和尾部类别目标方面的不足,遗漏检测集中在这些元素上,如图2和图3所示。

因此,作者提出了Mixed Pseudo Labels(MixPL),包括Pseudo Mixup和Pseudo Mosaic,以消除错误负样本的负面影响并补充小和中型目标的训练样本。此外,作者还提出标记重采样有助于MixPL显著提高尾部类别的检测性能。

伪Mixup。如DetMeanTeacher中所分析的,置信度阈值过滤了预测的置信度较低的边界框,这使得伪标签遗漏了一些感兴趣的目标,并在将阳性样本优化为阴性样本时,对模型的训练产生了持续的干扰。

考虑到遗漏检测是由于前景和背景样本之间的不平衡导致的,作者提出了伪Mixup。作者利用这种不平衡将两个伪标记图像叠加并合并它们的伪标签,确保一个阳性样本更有可能与一个阴性样本叠加。然后,由于阴性样本被叠加,因此这部分样本的整体负效应将显著降低。此外,作者还发现伪Mixup可以作为引入强健扰动的有效手段,为准确的正样本增加梯度响应,这对模型训练有益。

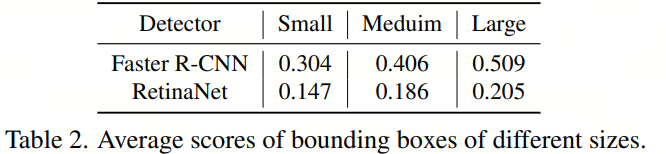

伪Mosaic。更深入地观察表1可以看出,随着阈值的增加,Faster R-CNN的持续降低,而RetinaNet的和则持续增加,这与预测框的大小和置信度之间存在强烈的相关性。在表2中,作者计算了不同大小边界框的平均得分。观察到,随着边界框大小的增加,边界框的平均得分也在增加。这种相关性最终使得伪标签中目标大小的分布显著偏离 GT 值。

为了缓解这个问题,作者提出了伪Mosaic。具体来说,伪Mosaic选择4个伪标记图像并降低采样率,然后将它们组合成1张图像,其中包含原始图像中的所有伪标签。这样做不仅将图像中的伪标签数量增加到4倍,还从原始图像中降采样出更多的小和中等目标。因此,伪标签中目标大小的分布更加平衡。

为了缓解这个问题,作者提出了一种称为标记重采样(Labeled Resampling)的方法。具体来说,标记重采样结合半监督学习场景,从标记数据中过采样尾部类别,从而显著提高尾部类别的准确性。检测器从 未标注 数据中挖掘足够的 Head 类别伪标签,以平衡标记数据中 Head 类别的欠采样,从而提高所有类别上的模型性能。该过程如下所述。

首先,计算每个类别包含的标记数据的比例:。然后,计算类别 Level 的重复因子,其中是一个超参数,其值在[0, 1]之间。最后,计算每个图像的图像 Level 的重复因子。

实现方法。如图5所示,MixPL在DetMeanTeacher获得强烈增强的 未标注 图像后应用。由于MixPL需要更多的伪标记图像进行混合,在每个迭代中,当前批次的 未标注 图像与来自伪标签缓存中最近一次迭代中采样的图像混合。例如,在每次训练迭代中,作者有1个标记图像和4个未标注图像。首先,从伪标签缓存中采样4个带有伪标签的新图像,并使用伪Mixup获得4个混合图像。然后,作者使用伪Mosaic随机组合8个图像中的4个,形成1个混合图像。这5个混合图像用于替换原始的4个 未标注 图像并训练学生模型。

5 Analysis

作者从梯度和正则化的角度分析了MixPL,揭示了该方法的有效性。

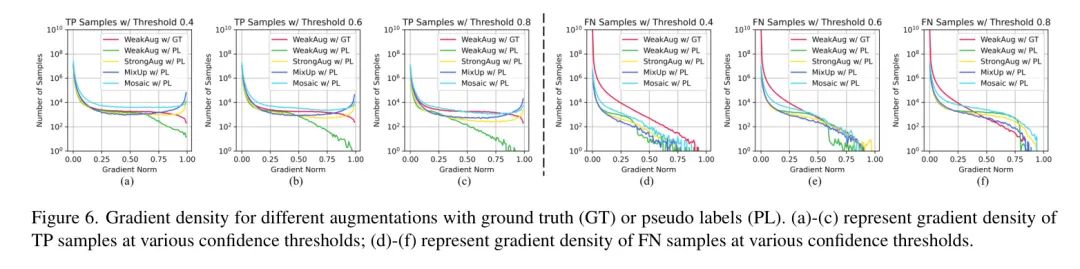

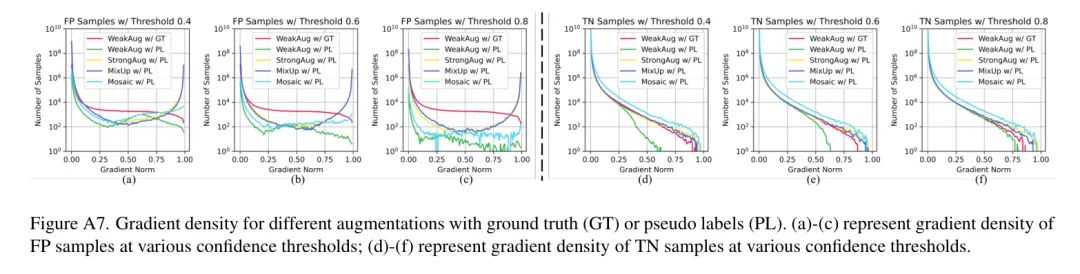

梯度。作者通过分析样本的_梯度密度_来揭示MixPL与弱增强和强增强的比较,具体而言,给定阈值过滤后的伪标记图像,伪标记图像通过弱增强、强增强、Pseudo Mixup或Pseudo Mosaic进行增强。然后,作者将增强后的伪标记图像输入到RetinaNet的学生模型中,并计算样本的_梯度密度_。梯度来自以下4种类型的样本,根据伪标签和真实值的分配结果,即True Positive (TP)、False Positive (FP)、True Negative (TN)和False Negative (FN)。

TP和TN表示基于伪标签和真实值的样本分配是一致的,其梯度是干净且理想的,对于学生模型有益。相反,FP和FN的样本是由于错误的伪标签导致的,它们将贡献导致错误优化的梯度。作者分析TP和FN的_梯度密度_,这暗示了伪标签中正确和错误目标的梯度密度。

作者首先分析Pseudo Mixup的有效性,通过比较图6中这些增强方法的趋势。当阈值增加时,伪标签中的阳性样本数量逐渐减少,导致TP的_梯度密度_逐渐减小。在这种情况下,如果使用弱增强,高范数的_梯度密度_会显著减小,说明弱增强不能像强增强那样用于训练学生模型。

相反,Pseudo Mixup的_梯度密度_高于强增强,尤其是在高范数和高阈值区域。这种趋势验证了Pseudo Mixup在提供更多阳性样本方面的有效性,并在提供硬阳性示例方面优于强增强。首先,由于插值两个图像最终会使混合图像中的目标难以检测,Pseudo Mixup不仅在TP中提供硬阳性示例,还减弱了缺失预测(FN)的影响。随着错漏目标的增加,Pseudo Mixup的FN的_梯度密度_显著低于强增强,这意味着Pseudo Mixup在减少伪标签中缺失目标的副作用方面具有优势。

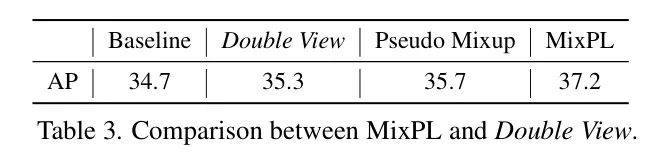

正则化。MixPL将当前迭代的伪标记图像与缓存中的图像混合,这隐式地使学生模型在训练迭代中短暂的时间内看到同一伪标记图像的不同视图。这种行为对学生模型施加了隐式的一致性正则化。作者通过在训练迭代中应用另一个强增强对同一组伪标签进行测试,并将 未标注 数据的批处理大小加倍,即让学生模型看到每个伪标记图像的两个视图,称为_double view_。

如表3所示,_double view_比 Baseline 提高了0.6% AP。在这方面,MixPL也受益于视图一致性,因为Pseudo Mixup和Pseudo Mosaic都利用过去迭代的图像缓存为一致性创建多个视图。需要注意的是,与_double view_相比,MixPL在训练过程中的性能更高且批处理大小更小。作者认为这是由于MixPL提供了更平衡的伪标记分布和更有效的梯度,如前所述。

6 Experiments

Dataset and Experiment Settings

数据集。作者在MS-COCO和PASCAL VOC上评估作者的方法。MS-COCO包含trian2017、unlabeled2017和val2017中的118k、123k和5k图像。PASCAL VOC包括VOC2007和VOC2012,总共有5011个图像在VOC2007的trainval中,4952个图像在VOC2007的测试集中,以及11540个图像在VOC2012的trainval中。作者使用以下3种实验设置来研究和评估作者的方法:

COCO-Standard: 作者从train2017中随机采样1%/2%/5%/10%的图像作为标记数据,其余的作为 未标注 数据。

COCO-Full: 作者使用train2017作为标记数据,unlabel2017作为 未标注 数据。

VOC-Mixture: 作者使用VOC2007的trainval作为标记数据,VOC2012的trainval作为 未标注 数据。

COCO基准测试评估在val2017数据集上训练好的模型,而VOC基准测试评估它们在VOC2007测试集上。

实现细节。对于COCO-Standard的实验,所有检测器都在8个GPU上训练,每个GPU有5张图像(1个标记图像和4个 未标注 图像)。对于COCO-Full和VOC-Mixture的实验,所有检测器都在8个GPU上训练,每个GPU有8张图像(4个标记图像和4个 未标注 图像)。检测器通过180k次迭代(除了DINO,它进行了90k次迭代以避免过拟合)和36k次迭代(在COCO-Standard和VOC-Mixture上的迭代次数)进行训练。

在COCO-Full的实验中,Faster R-CNN和FCOS通过540k次迭代训练,在迭代360k次后,学习率衰减10,而DINO在无学习率衰减的情况下进行了270k次迭代。作者使用SGD优化器对所有检测器,学习率恒定为0.01,动量0.9,权重衰减0.0001,除检测器 Transformer外,其原始优化器和超参数在本研究中遵循。

Benchmark Results

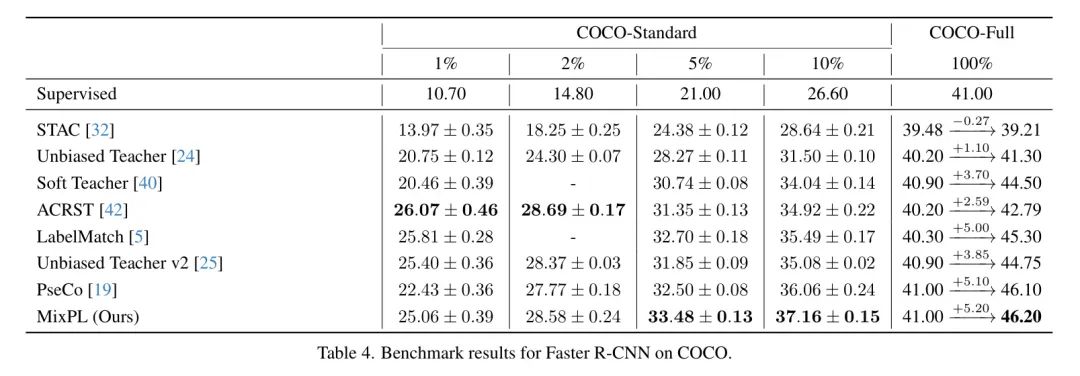

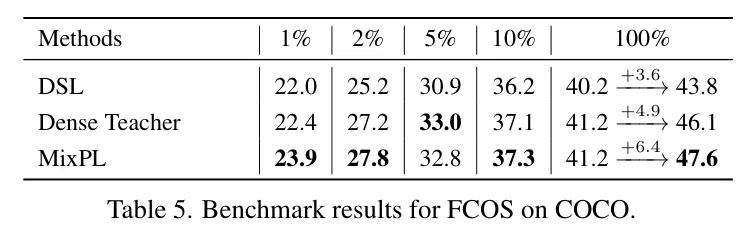

在COCO-Standard上,当标记数据从1%到10%变化时,MixPL始终展现出竞争力的结果。对于Faster R-CNN,MixPL在COCO 2%上获得第二好的结果,并在COCO 5%和COCO 10%上超越了所有以前的方法,如表4所示。对于FCOS和DINO,MixPL在FOCS上在COCO 5%上获得第二好的结果,并在表5和表6中在其他设置下超越了所有以前的方法。

在COCO-Full上,如表4、表5和表6所示,MixPL在无标记数据的情况下,分别提高了Faster R-CNN、FCOS和DINO的监督性能5.2%、6.4%和4.3%,并达到了新的最先进性能。值得注意的是,在一阶段检测器上改进半监督设置更具挑战性,因为一阶段检测器在正负样本之间存在更严重的失衡问题,而MixPL显著超越了DenseTeacher之前的最优结果(FCOS)的1.5%,同时不涉及任何检测器特定的设计。

此外,当应用于具有强大后 Backbone 的先进目标检测器DINO(表7)时,MixPL表现出非常高的可扩展性。没有多余的装饰,MixPL在不需要额外标注的情况下,超越了SSOD中SoftTeacher之前的最优单模型结果(60.2% AP vs. 59.9% AP)。

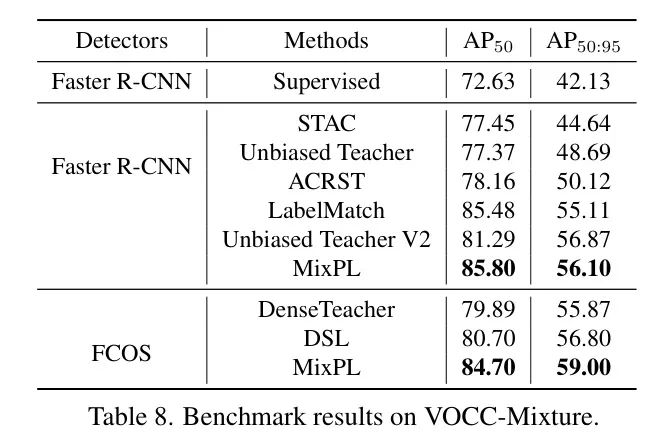

VOC-Mixture: 为了进一步验证MixPL在不同数据集上的泛化能力,作者在表8中比较了不同的SSOD方法。MixPL始终优于以前的方法,无论是与Faster R-CNN和FCOS相比,还是在单阶段检测器FCOS上观察到更显著的优势。这种现象与在COCO-Full上观察到的现象一致,进一步验证了MixPL在半监督学习下缓解单阶段检测器不平衡问题的能力。

对不同检测器的改进。作者在COCO 10%上研究了DetMeanTeacher和MixPL在不同目标检测器上的有效性,通过在11种目标检测器上进行实验,涵盖主流的单阶段、阶段式和端到端检测器。表9的结果揭示了MixPL是一个通用的SSOD框架,通常适用于不同类型的目标检测器。仅过滤具有未预测伪标签的_空图像_,DetMeanTeacher在所有监督 Baseline 上取得了至少6.9%的AP改进。

与表4中的先前方法相比,DetMeanTeacher已经超越了一些专门为不同检测架构设计的现有SSOD方法,例如Soft Teacher(34.7% AP vs. 34.04% AP)。此外,MixPL在不同的目标检测器上始终至少提高DetMeanTeacher的0.7% AP。总体结果也为未来的通用SSOD研究提供了新的数据点。

Ablation Study

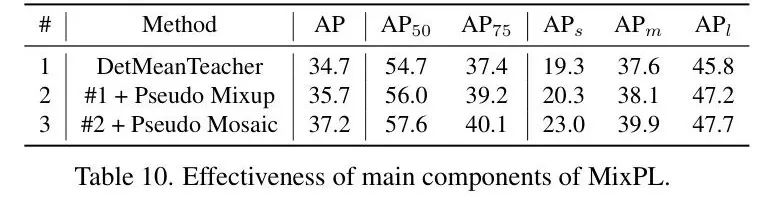

作者在基于Faster R-CNN的DetMeanTeacher上进行了伪Mixup和伪Mosaic的消融实验。两者在表10中都取得了显著的改进。同时,伪Mosaic显著提高了检测器中小型和中型物体的识别能力。

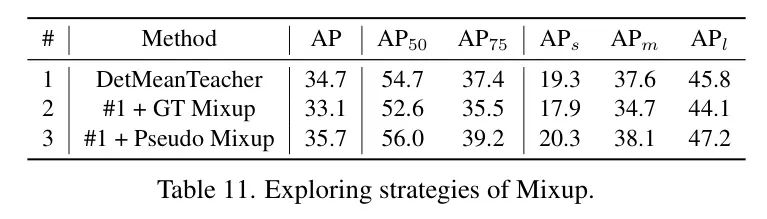

伪Mixup。为了验证Pseudo Mixup的必要性,作者探索将1个伪标记图像与1个标记图像混合,其结果在表11中低于 Baseline 。将2个伪标记图像混合可获得更好的结果,并在AP上超越 Baseline 1%。

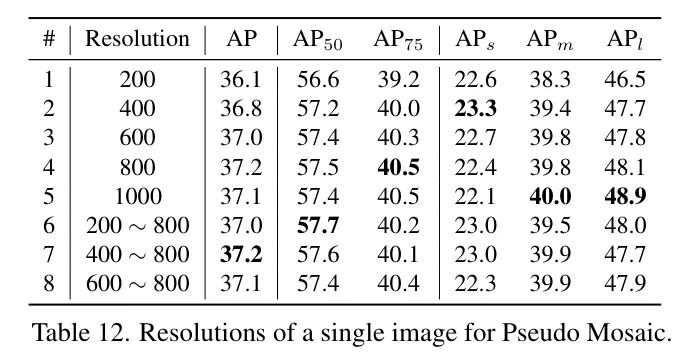

伪Mosaic。作者然后在表12中仔细消融Pseudo Mosaic中图像尺度的有效性。200的分辨率表示每个图像的最长边缘将是200。作者首先研究将图像下采样或上采样到固定大小,并发现800在固定大小中实现了最佳AP,而400在最佳AP中取得了最佳结果。然后作者研究了不同尺寸之间的适当范围,以找到不同尺寸之间的最佳折衷,并减少训练成本。结果表明,400 800比固定尺寸和其他尺寸范围更好地进行折衷。

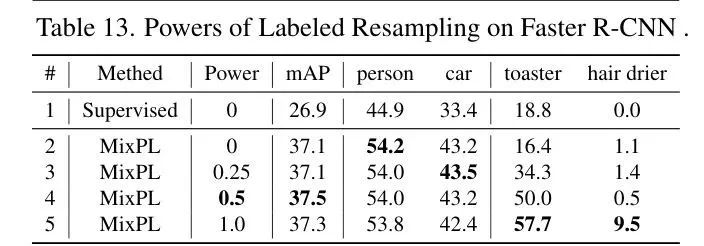

标记重采样。由于有时标记数据有限,导致某些尾部类别没有标记,作者只对Faster R-CNN和FCOS在COCO 10%上的配置进行消融实验。作者的分析重点是头类别(person和car)和尾类别(toaster和hair drier)的最优性能,详细信息见表13和表14。

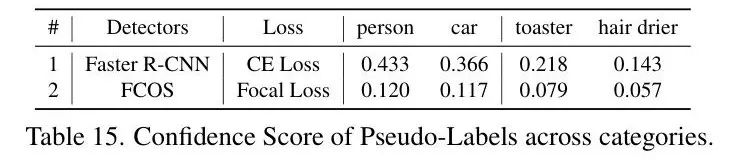

值得注意的是,Faster R-CNN和FCOS在头类别上的半监督增益都超过了尾类别。这种趋势在头类别原始准确率已经很高的情况下持续存在,并且在某些情况下,尾类别性能会低于监督学习 Baseline 。通过过采样尾部类别增强标记数据,显著提高了”toaster”检测,而”person”和”car”检测没有明显下降。然而,”hair dryer”检测改进有限,突显了需要为具有挑战性的尾部类别增加标记数据的必要性。此外,Labeled Resampling相对于Faster R-CNN对FCOS的改进更为显著,主要是因为Focal Loss在类别置信度方面的公平性,见表15。

作者观察到各种检测器之间的伪标签与 GT 值在数量、大小和类别方面存在一致性的差异,并提出了MixPL with Labeled Resampling。MixPL通过Pseudo Mixup减轻了错误的负样本的持续干扰,并通过Pseudo Mosaic和Labeled Resampling全面提升了检测器在不同大小和类别上的性能。

此外,MixPL是第一个对不同目标检测器普遍有效且有效地通过 未标注 图像改进的SSOD框架,并在COCO基准测试上创造了新的SSOD记录。

Appendix B The Perspective of Gradient

Definition of Gradient Norm

作者采用GHM中梯度范数的定义和计算。给定一个预测的边界框,作者将表示为该框的预测概率,表示其对应的特定类别的真实标签。二进制交叉熵损失可以表示为:

作者采用GHM中梯度范数的定义和计算。给定一个预测的边界框,作者将表示为该框的预测概率,表示其对应的特定类别的真实标签。二进制交叉熵损失可以表示为:

其中且。作者定义为模型的直接输出,使得,梯度 为:

梯度范数与之间的关系可以表示为:

梯度范数表示每个样本对整体梯度的影响。虽然梯度范数适用于整个参数空间,但是相对于样本的梯度范数。在本论文中,作者使用式3计算RetinaNet的阳性样本和阴性样本的梯度范数。

Analysis of Gradient Norm for FP and TN

在主文本中,作者分析了不同数据增强下TP和FN的梯度范数分布。在这里,作者将补充FP和TN的梯度范数分析。

如图A7(a-c)所示,强增强会增加FP的样本数量,这对模型学习预测这些虚假正样本产生了负面影响。与强增强相比,Pseudo Mixup具有较少的样本具有高梯度范数,这弱化了FP的负面影响,当过滤伪标签的置信度阈值较低时,即伪标签中存在更多的FP。然而,当置信度阈值较高时,即伪标签中存在较少的FP时,Pseudo Mixup比强数据增强贡献更多低梯度范数的样本。

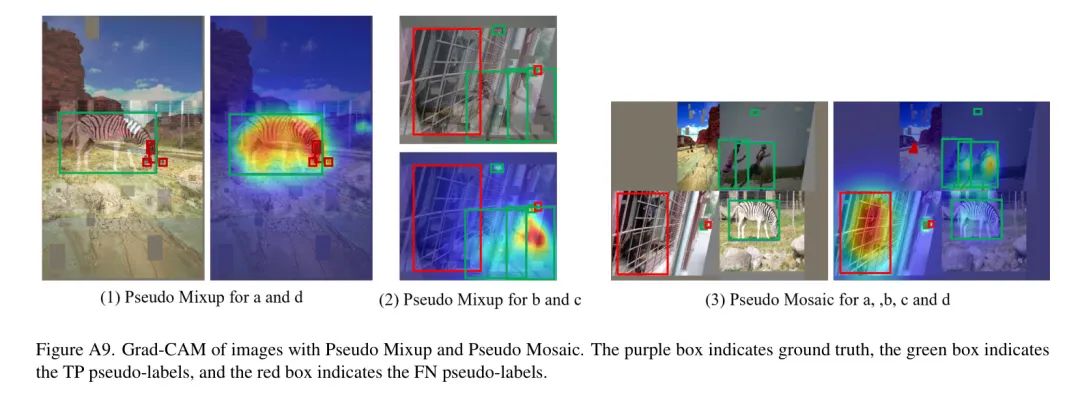

与Pseudo Mixup不同,Pseudo Mosaic对FP的缓解作用与阈值呈正相关,因为它贡献的具有不同梯度范数的样本较少。这是因为,在Pseudo Mosaic中,由于降采样,这些较小物体对学生的模型(如图A9所示)将更加难以识别,从而最终减少了小尺寸FN的影响。

作者进一步分析图A7(d-f)中TN的趋势。因为Pseudo Mosaic将四个图像合成为一个相对较大的图像,因此在训练中总是产生更多不同梯度范数的真实负样本。相反,Pseudo Mixup将两个图像插值到一个新的图像中,混合图像可能对真实图像有不同的贡献,这使得在混合图像中识别目标变得更加困难,因此Pseudo Mixup在TN中比强数据增强贡献较少的高梯度范数样本。作者还观察到,弱增强产生了过多的容易样本,即贡献了最少的梯度范数样本,因为其增强水平较弱。

Appendix C Grad-CAM with Different Augmentation

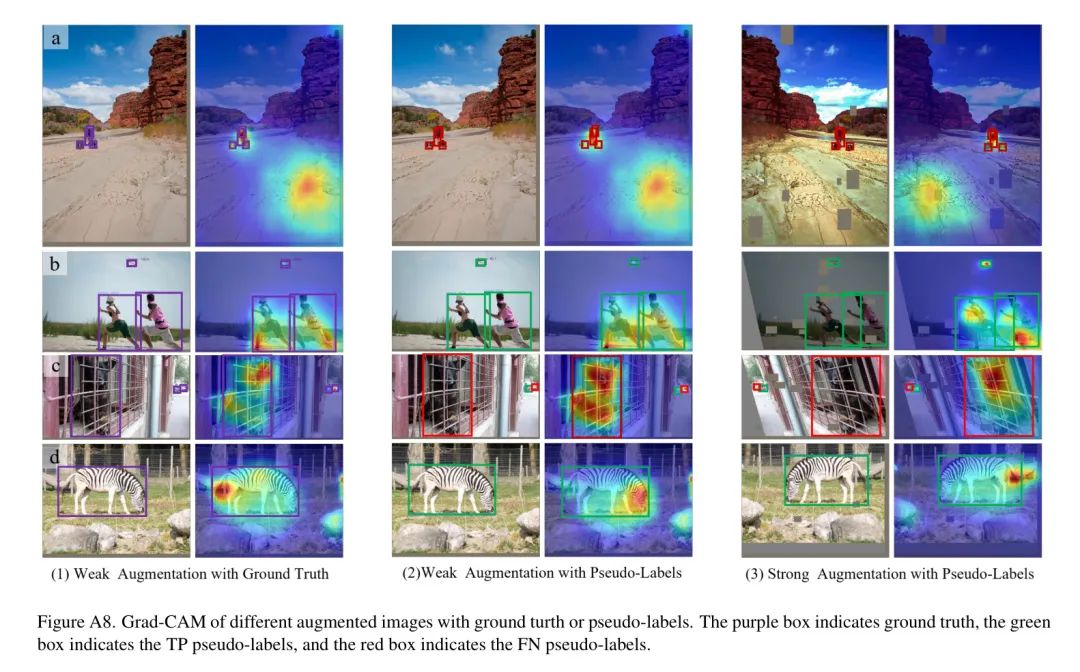

作者进一步应用Grad-CAM在不同的 Level 上对图像进行增强以可视化和理解学生模型中的行为。

如图A8(a,c)所示,当教师模型无法预测某个目标并生成虚假负预测时,学生模型在FN目标的区域内(红色矩形区域)会产生高响应。这种响应是有害的,因为它可能导致模型将该区域视为背景并在此过程中积累偏差。应用强数据增强可以帮助减轻这种影响,如图A8(c)所示,当应用强数据增强时,FN区域的亮度较弱,这意味着强增强可以帮助学生避免过度依赖FN伪标签,因为它创建了一个视图,其中缺失的伪标签更容易被伪装成背景(例如图像c中的狗),从而使来自缺失伪标签的梯度被大大抑制。另一方面,图A8中的图像b和d揭示了,当与弱数据增强相比,在应用强数据增强时,TP目标的梯度响应更为突出,这意味着更困难的真实预测可以通过创建更大的梯度响应来加速训练。

正如主稿中所揭示的,也如图A9所示,Pseudo Mixup与强增强类似,因为Pseudo Mixup在减少FN目标的梯度响应(如图A9中右图所示的红色矩形区域)并增强TP目标的梯度响应(如图A9中左图所示的绿色矩形区域)方面有效。另一方面,Pseudo Mosaic可以增加小和中型TP目标的梯度响应区域,这可能导致特定子图像(如图A9上左子图所示)中FN目标的响应降低,但也可能引入其他子图像(如图A9下左子图所示)中FN目标的响应。

Appendix D Implementation Details

Details of Different Detectors

在半监督训练中,作者使用与这些全监督训练中的检测器相同的优化器和学习率,如表1所示。对于一阶段检测器,两阶段检测器和级联检测器,作者使用SGD优化器,固定学习率为0.01。对于基于 Query 的检测模型,如Sparse R-CNN和检测 Transformer,作者使用AdamW优化器,固定学习率为和。

对于用于过滤伪标签的置信度阈值,使用交叉熵损失作为分类损失函数的检测模型采用0.7的值,而使用Focal Loss的检测模型除了FCOS以外采用0.4的值。因为FCOS的置信度是中心度分数和分类分数的几何平均值,通常较小,所以FCOS的阈值被设置为0.3。

对于训练迭代次数,由于DINO的快速收敛速度,作者在COCO-standard上只训练了DINO 90k次,以避免过拟合,而其他检测模型则训练了180k次。

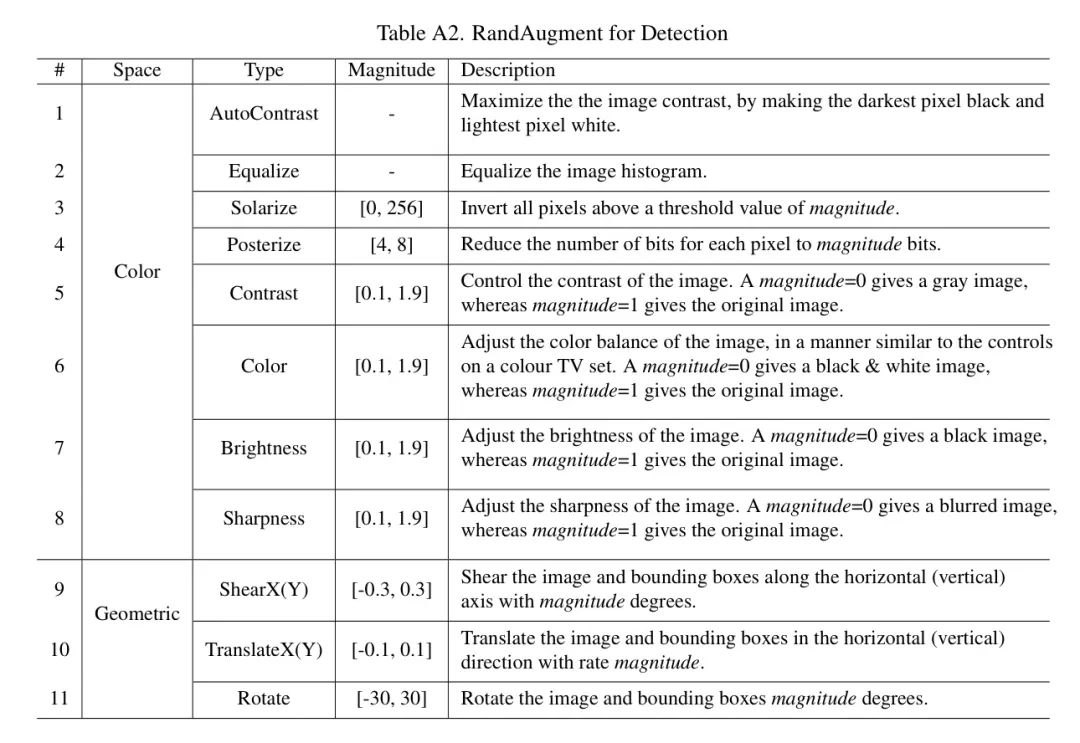

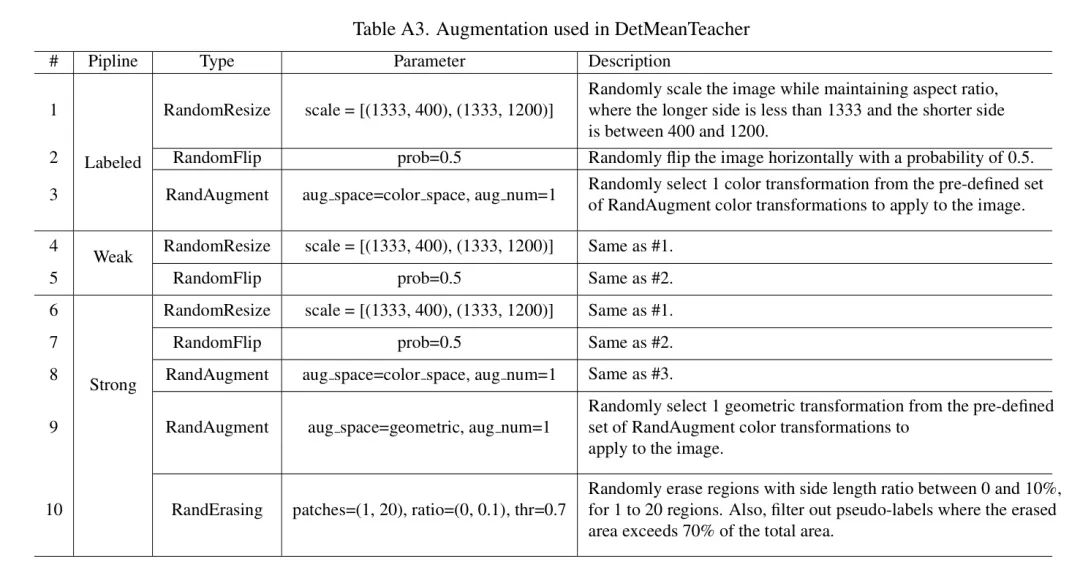

Details of Augmentation

作者在表A2和表A3中列出了弱增强和强增强的实现细节。这些细节一般遵循Soft Teacher的数据增强,除了RandomErasing之外。考虑到RandomErasing可能会完全擦除伪标签实例,作者减少了单个擦除区域的随机大小范围,并过滤掉擦除区域比例大于70%的伪实例。

参考

[1].Mixed Pseudo Labels for Semi-Supervised Object Detection.

扫码加入👉「集智书童」交流群

(备注:方向+学校/公司+昵称)

想要了解更多:

想要了解更多:

前沿AI视觉感知全栈知识👉「分类、检测、分割、关键点、车道线检测、3D视觉(分割、检测)、多模态、目标跟踪、NerF」

行业技术方案👉「AI安防、AI医疗、AI自动驾驶」AI模型部署落地实战👉「CUDA、TensorRT、NCNN、OpenVINO、MNN、ONNXRuntime以及地平线框架」

欢迎扫描上方二维码,加入「集智书童-知识星球」,日常分享论文、学习笔记、问题解决方案、部署方案以及全栈式答疑,期待交流!

免责声明凡本公众号注明“来源:XXX(非集智书童)”的作品,均转载自其它媒体,版权归原作者所有,如有侵权请联系我们删除,谢谢。

点击下方“阅读原文”,了解更多AI学习路上的「武功秘籍」

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง