他们是想趁着还没回家过圣诞,赶紧先发了。然后让大家一边过圣诞,一边给他们打黑工帮他们测模型。

这一下子给我发的,是着实的有点猝不及防。

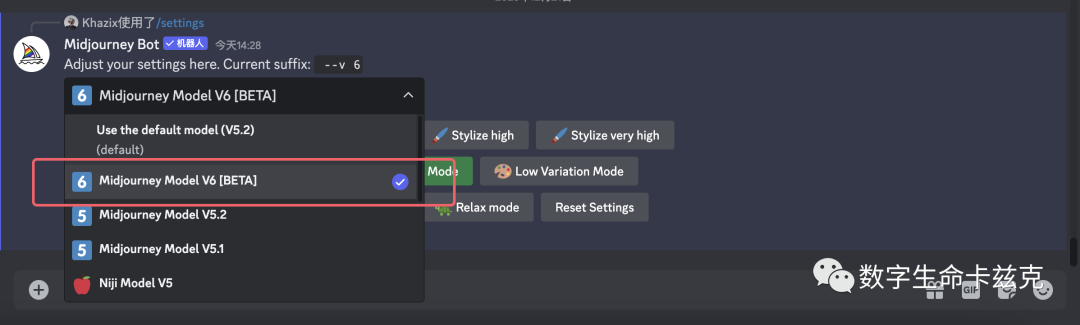

现在,你使用/setting命令,在模型选择框中,就可以看到V6 Beta版。

按照Midjourney的话说:“This is an alpha test. Things will change frequently and without notice”

“这是一个阿尔法测试。事情会经常发生变化,恕不另行通知。”

包括提到了“速度、图像质量、连贯性、提示跟随性和文本准确性将在接下来的几周内得到改善”

我猜测模型完成度在85%左右,剩很多对齐工作没搞完。

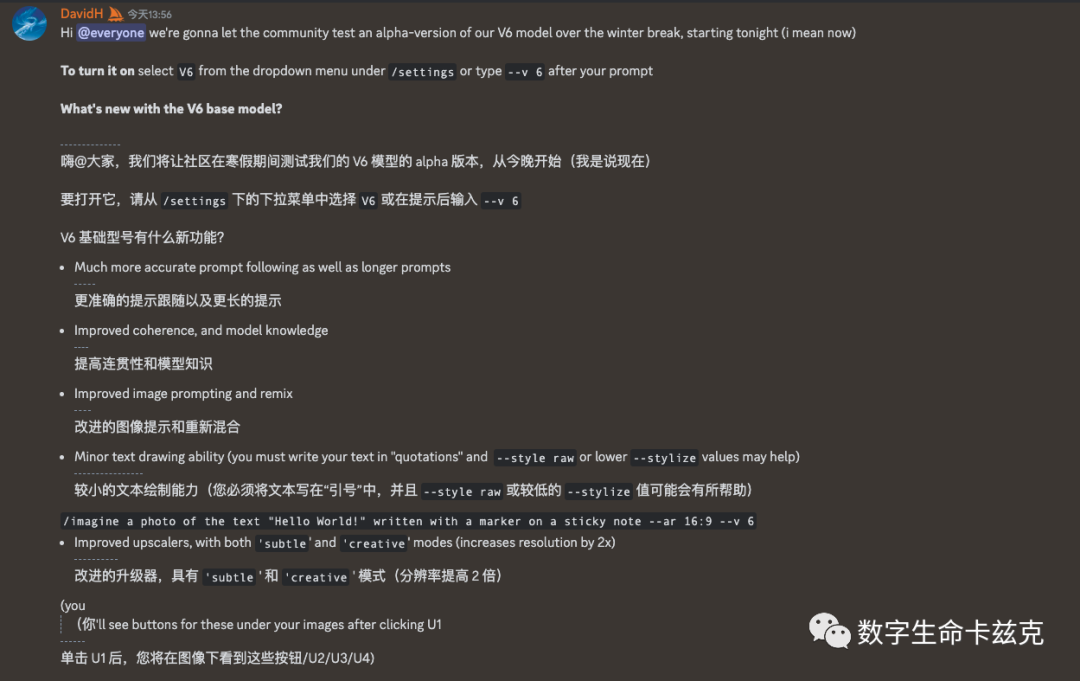

官方说的目前V6 Beta的更新内容:

1. 更准确的提示跟随以及更长的提示。2. 提高连贯性和模型知识。3. 改进的图像提示和重新混合。4. 较小的文本绘制能力(您必须将文本写在“引号”中,并且 –style raw 或较低的 –stylize 值可能会有所帮助)

5. 改进的升级器,具有 ‘subtle ‘ 和 ‘creative ‘ 模式(分辨率提高 2 倍)

有点太废话,我翻译成人话就是:能容纳更多的词语token了、语义理解更强了、图像质量更好了、能嵌入一点英文单词进去了、图像能放大更多了。

我跟上百个群友一起跑了三个多小时,整体感受最大的变化其实还是两部分:

图像质量的提升与语义理解的加强。

我拆开聊。

01

图像质量的提升

图像质量我关注的是以下几个纬度:细节密度、材质质感、色彩表现、光影表现、构图表现、结构真实性。

Midjourney V6 Beta在细节密度、材质质感、光影表现、结构真实性上,都有巨幅提升。构图表现和色彩表现有小幅提升。

直接放对比图,没啥可说的了,部分图片来源于好基友@鲜虾包、@猫宅V酱、@大峰AI绘画。

就不放太多了,反正核心思想就一个:图像质量up up 还是up。

知道在细节密度、材质质感、光影表现、结构真实性上,都有巨幅提升就行了。

下面一趴的语义理解才是最核心的重点。

02

语义理解的加强

我重点来聊聊语义理解这块的变化。

我曾经毫不避讳的骂过 Midjourney,它的语义理解就是一坨屎。让我在做过往的AI作品时,无数次的带上痛苦面具想砸电脑。

但是这一次,Midjourney V6 Beta对于语义理解的加强,终于到了中上游可用的地步,注意我用的词是“可用”。跟Dalle3这种逆天的还没法比。

首先请忘掉所有的SD式的写法,不要写tag,不要写“photorealistic, 4k, 8k”之类的垃圾词,他们对于新版V6 Beta没有任何蛋用。

不要写tag,不要写tag,不要写tag,重要的话我说3遍。

别直接用v5.2的prompt直接拿来复制粘贴,请重新学习新版V6的写法。

整体上,我觉得更强调把细节说清楚的能力。我推荐的结构是:

场景+主体+细节+美学风格。

比如我的这段 Prompt:

三个不同的美女朋友坐在沙滩上面向镜头微笑。中间的是一个开朗的金发白人女性,穿着短裤和红色色背心。左边的朋友是一个黑发美国女孩,穿着比基尼和透明的裙子。右边的朋友是一个红发英国女孩,穿着比基尼。背景可以看到海,海上有船和飞翔的海鸥。Agfa Vista 200拍摄的中景镜头。

非常复杂,但是我几乎都是以长句子去写的,清晰的描述场景和主体以及部分衣服细节。

再看看v5.2,可以就语义理解上,做一个清晰的对比。

在新版prompt的写法上,我说一些我认为有趣的技巧:

1. 你可以指定任何细节。

不要吝啬你的想象力,更不要吝啬你的笔墨,用一切有逻辑、有结构的语言,把你想要的细节指定出来。她穿了什么衣服、衣服是什么材质、什么颜色。写明白,写明白比一切都重要。

比如:

漫威黑寡妇的半身特写镜头。黑寡妇穿着蜘蛛侠的黑色紧身衣,她的左手拿着美国队长的盾牌,右手拿着雷神之锤,她很悲伤。–ar 16:9

2. 你可以使用语言控制构图。

在V6中,现在很容易用语义去定位事物之间以及与相机的关系。这个在V5中几乎是难以想象的。

现在我们可以用短语描述一个通用的图像,以这个通用图像为焦点。围绕它填充细节。

比如:

客厅的桌子上有三个装满水果的篮子。中间的篮子里装有草莓。左边的篮子装满了橘子。右边的篮子装满了芒果。背景是一个带有圆形窗户的空白蓝绿色墙壁。

3. 你可以向你的图像中添加文本。

Dalle3的老传统了。可以给你图像添加文本,将需要嵌入图片的文字放在 “引号”内,并且保证你描述的画面上适合嵌入文本。Founder Park 试着生成了一张带字的场景,效果看起来,居然还可以。

比如:

公告牌上写着“Founder Park”的一次科技行业活动

03

写在最后

Midjourney V6 Beta带来的有趣是一定的,对真实感和图像质量的加强,基本到了现在所有AI绘图的颠峰,再配上独一档的审美,以及史诗级的语义增强。

可以看到,Midjourney未来正式版V6的推出,一定又会开始“遥遥领先。”

诚然,问题还很多,比如对于其他的风格加强好像并不明显。

比如很多功能都还不支持。

但是瑕不掩瑜。

Midjourney V6 不是AI绘图的最后一步。

而是又一次AI历史长河中的丰碑。

如果你关注大模型领域,欢迎扫码加入我们的大模型交流群,来一起探讨大模型时代的共识和认知,跟上大模型时代的这股浪潮。

更多阅读王小川创业 8 个月:大模型还没到谈 PMF 的时候

AI Pin、Meta AI、Snap 眼镜,AI 可穿戴设备的风又要吹起来了?

估值超5亿美元,体验碾压Bard、Bing,AI搜索引擎Perplexity的想象力在哪里?

Meta、Midjourney、Adobe、DALL·E:四大巨头的 AI 绘图模型综合评测

时代周刊:为什么 Sam Altman 是 2023 年度 CEO?

转载原创文章请添加微信:geekparker

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง