点击下方卡片,关注「AI视界引擎」公众号

视频预测旨在根据视频的先前内容预测未来的帧。现有方法主要处理视频数据,其中时间维度与空间和通道维度从三个不同的角度混合:作为单个帧的序列,作为时空坐标的3D体积,或者作为堆叠的图像,其中帧被处理为独立的通道。

大多数方法通常专注于其中一种视角,可能无法充分利用不同维度的关系。为解决这一问题,本文提出了一种卷积混合器(Convolutional Mixer)用于视频预测,称为ViP-Mixer,用于在自编码器潜在空间的时空演变中建模。ViP-Mixers是依次堆叠的,并在三个层次上进行特征混合:帧、通道和位置。

大量实验表明,本文提出的算法在涵盖合成和实际场景的三个基准视频数据集上实现了最先进的预测性能。

1 Introduction

通过从历史上下文中学习预测未来图像的能力为人类和人工智能系统在各种情况下做出明智决策提供视觉线索,例如天气预报,机器人控制和自动驾驶。由于其广泛的应用范围,视频预测近年来吸引了越来越多的研究兴趣。然而,要开发能够学习复杂动力学(例如运动和变形),同时保持高分辨率合成的像素级细节的视频预测模型仍然具有挑战性。通常,时间维度的出现是视频处理方法与图像方法之间的一个关键差异。因此,根据如何处理这个维度,作者可以将最近的工作分为三类。

-

第一类被称为多帧建模,其中时间被视为与图像级别的空间和通道维度正交。由于视频本质上是帧序列,因此自然地首先提取单帧特征,然后使用循环神经网络(RNNs)在所有时间步上混合它们。PredRNN提出了ST-LSTM单元和时空记忆流来在不同层次上保持状态转换的一致性。遵循这项工作,PhyDNet引入了PhyCell来施加物理约束,而MotionRNN利用MotionGRU来学习瞬态变化和趋势动力学,以显式地表示运动。

-

相比之下,第二类方法将视频视为张量。他们通过3D卷积和Patch嵌入等操作平等地处理空间和时间:FutureGAN构建了一个3D卷积网络来同时感知空间和时间内容。受到视频视觉Transformer(ViViT)的启发,其中视频剪辑被分成多个卷(Patch),EarthFormer提出了一种基于Cuboid Attention的分层Transformer,其中输入张量被分解为具有特定跨度的立方体(高度、宽度和时间维度)。作者可以称这一类别为张量建模。

-

最后一个类别“图像”建模似乎是最直观的,它将时间视为另一种形式的通道,并简单地将它们堆叠在一起,以便可以应用图像技术。例如,SimVP提出了一个纯粹的2D卷积Baseline,并显示出比更复杂模型更具竞争力的性能。进一步改进,使用时间注意力单元(TAU)来关注内部帧间相关性和跨帧相关性,从而在多个基准测试上获得最先进的结果。

尽管作者赞赏这些开创性工作的显著进步,但作者注意到在以前的文献中,时间维度仅作为空间、通道或时间本身单独存在,很少有尝试以统一的方式整合这三个视角。

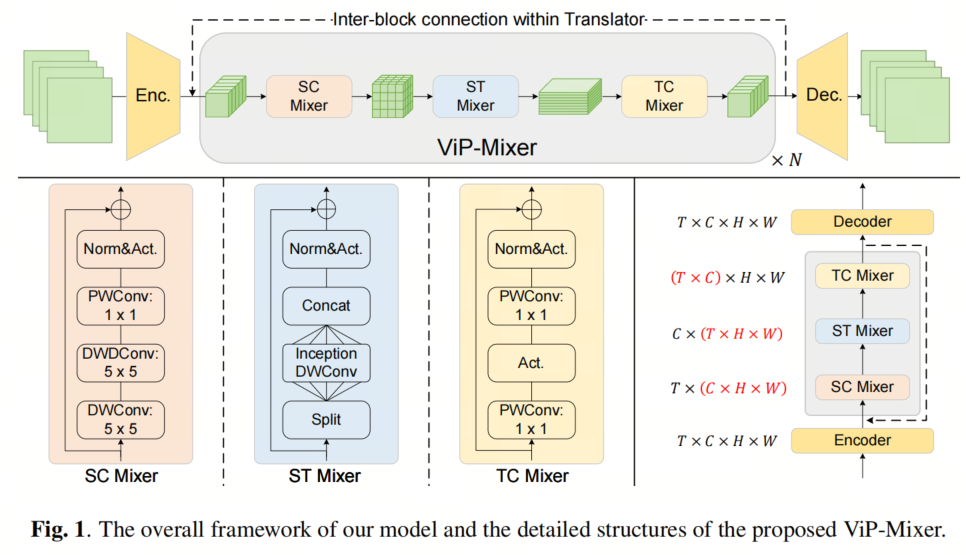

受到MLP-Mixer中的特征混合的启发,作者提出了视频预测Mixer (ViP-Mixer),它由空间-通道(SC)Mixer、空间-时间(ST)Mixer和时间-通道(TC)Mixer组成,以识别不同维度组合中的线索。作者将ViP-Mixers依次堆叠以构建作者的模型,并展示了其在尽管简单的情况下仍然有效。

本论文的主要贡献如下:

- 提出了ViP-Mixer,这是一个新颖的模块,可以从三个角度获取时空关系

- 使用ViP-Mixers构建了一个卷积网络进行视频预测,没有使用任何复杂的结构或额外的技巧

- 在合成和真实世界的数据集上进行了实验,并在定性和定量评估方面都超过了现有工作

2 Methodology

在本节中,作者介绍ViP-Mixer,该模型用于在潜在空间中模拟时空演变。所提出的模型包括编码器、解码器以及多个ViP-Mixers,用于在通道、空间和时间维度之间进行信息流动。

Network Architecture

作者方法概述如图1所示。受到SimVP和潜在扩散模型(LDMs)的启发,作者试图在潜在空间中学习从过去帧到未来帧的映射,这使得模型可以专注于语义动态,同时减少了计算需求。

具体来说,给定一个输入图像序列,作者将其表示为,其中是第个图像的通道、高度和宽度。

编码器将每个图像编码为其潜在表示,并因此输出。

这个嵌入的视频张量然后被输入到翻译器中并转换为,它表示了个后续帧的嵌入。

最后,解码器从帧逐帧重构预测的图像。

值得注意的是,编码器和解码器都由2D卷积层组成,仅考虑空间外观,而翻译器利用ViP-Mixers学习4D张量背后的时空动态。

ViP-Mixer

ViP-Mixer,源自MLP-Mixer,包含通道混合和标记混合操作,是翻译器的基本构建单元。同样,如图1所示,它可以分为三个组件:

- per-timestep mixer(SC Mixer)

- per-channel mixer(ST Mixer)

- per-location mixer(TC Mixer)

Space-Channel Mixer: SC Mixer负责通过在空间和通道维度上混合每个帧中的空间特征,学习每个帧中的空间特征,因此它可以使用原来专为图像设计的任何运算符。由于最近的一些工作中深度卷积(depthwise convolutions)给出了有前途的结果,作者使用深度卷积()、深度膨胀卷积()和点卷积()来保持大的感受野,同时减少计算成本。

具体来说,SC Mixer将输入张量分成个独立的帧,并执行以下帧相关的操作:

其中,表示第个帧;表示核大小为的卷积;是非线性激活函数,本文中为ReLU。在并行处理后,所有帧都被拼接在一起形成输出张量。

Space-Time Mixer:受到Inception-NeXt的启发,作者使用具有Inception风格的3D卷积()来构建ST Mixer,该混合器旨在学习每个通道内的时空关联。输入张量首先在通道维度上被分成五组,然后层对它们施加不同核的卷积(除了零核映射),最后所有这些组被拼接在一起。这个过程可以表述如下:

Time-Channel Mixer: TC Mixer旨在在时间和通道维度上混合特征。

其中,和是可学习的参数,其中是扩展比。请注意,这里提到的操作是在整个堆叠的“图像”上进行的,这与在SC Mixer中针对单个帧执行的操作不同。

3 Experiments

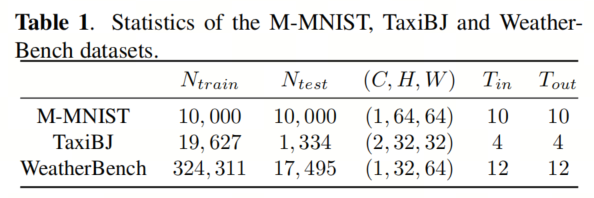

作者在三个数据集(包括合成和实际场景)上评估作者的方法:

移动MNIST(M-MNIST)包含两个随机初始化位置的数字,以随机速度移动,并在特定角度下碰到边界。所有像素值都归一化为。

TaxiBJ记录了北京的交通流量轨迹,显示每个像素对应区域的流入和流出,具有两个通道。所有像素值都归一化为。

WeatherBench包含温度、湿度和风等物理量。作者用的空间分辨率对原始数据进行重采样,并将温度场作为预测目标。

由于任意长度的视频都可以以自回归方式进行预测,选择与前人相同的输入和输出长度进行公平比较。这些数据集的统计信息汇总在表1中。

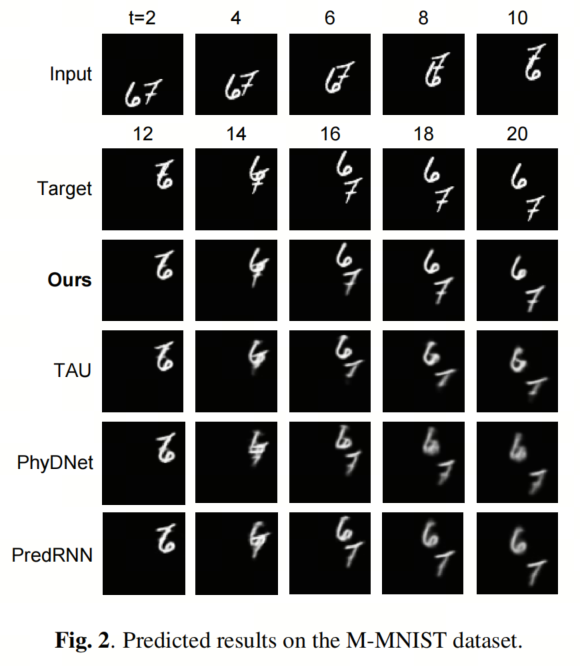

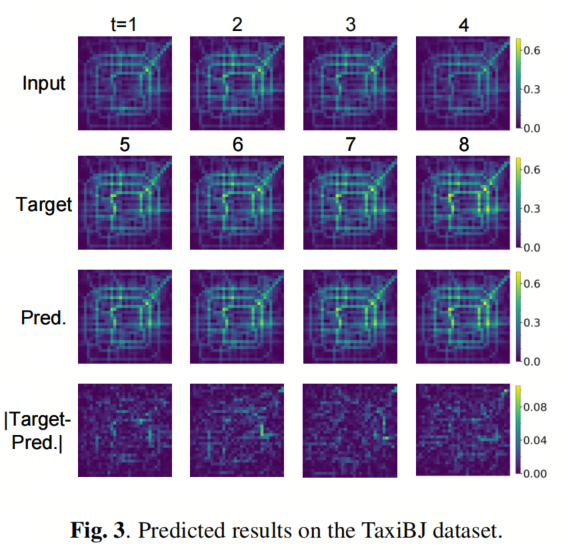

Qualitative Evaluation

作者首先在M-MNIST上比较ViP-Mixer与其他方法的质量。如图2所示,两个数字在时相遇,并在到之间相互交织,这给长期预测带来了挑战。相比之下,作者的模型产生的图像更清晰,能够准确预测移动数字的轨迹,同时保持它们的形状,这意味着它捕捉到了时间和静态空间内容。

如图3所示,作者方法预测TaxiBJ上交通流量的示例。在此情况下,交通流量在时增加,这可能对应着早上交通拥堵的情况。尽管发生了这种交通流量的突然变化,ViP-Mixer仍然可以感知整体趋势并预测未来具有高保真度,这表明它在实际应用中具有实用价值。

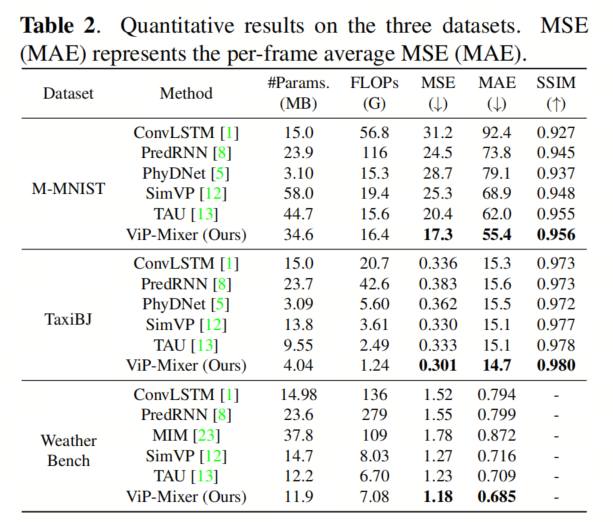

Quantitative Evaluation

在表2中,作者使用帧均方误差(MSE)、平均绝对误差(MAE)和结构相似性指数(SSIM)定量评估了与几个强大的Baseline相比,作者提出的方法。参数和FLOPs也作为模型复杂性的估计进行了计算。

作者看到,ViP-Mixer在所有基准数据集上都始终优于最近的最先进状态的方法,提供更可靠的预测,且与真实值的偏差较小。例如,ViP-Mixer将目前最佳TAU [13]在M-MNIST上的MSE从降低到,同时还将MAE指标提高了。

与此同时,由于其全卷积结构,ViP-Mixer比基于CNN的SimVP更参数有效,并且消耗的计算资源比基于RNN的方法(如PredRNN)更少。这些观察结果进一步表明了作者的模型的有效性。

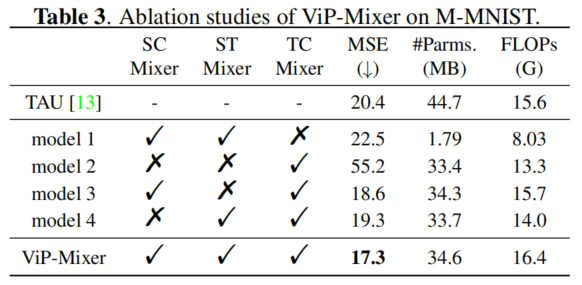

Ablation Study

作者在M-MNIST上进行ViP-Mixer的有效性验证的消融研究。各种设置下的实验结果对比请参见表3。

总体而言,三种混合器都为预测质量做出了贡献,缺少其中任何一个都会降低预测质量。SC Mixer和ST Mixer的融合(模型1)已经提供了一个有效的Baseline,与TAU相比具有竞争力的性能。

ViP-Mixer是结合了这种Baseline与TC Mixer得到的,代价是增加了复杂度。另一方面,只使用TC Mixer在时间和通道维度上混合每个位置的特征(模型2)远远不够,因为缺乏空间上下文。

因此,要么是SC Mixer,要么是ST Mixer,它们都能显著提高生成的帧的质量(模型3和模型4)。使用所有组件显示了最佳结果,表明三个模块的集成,即ViP-Mixer,具有有效捕捉视频数据下复杂动力学的潜力。

4 Conclusion

在本文中,作者介绍了一种创新的卷积网络用于视频预测。作者模型的基础元素是ViP-Mixer模块,该模块在帧级、通道级和位置级上混合特征。

通过将这些模块作为编码器与解码器之间的翻译器堆叠起来,作者可以有效地捕捉跨越不同维度的时空关系。综合实验证明了ViP-Mixer相对于现有方法在性能和效率上的优越性。

5 参考

[1].VIP-MIXER: A CONVOLUTIONAL MIXER FOR VIDEO PREDICTION.

点击上方卡片,关注「AI视界引擎」公众号

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง