点击蓝字

关注我们

海外智库观察

人工智能的快速发展既给全球带来了广泛的发展机遇,也因其不确定性而产生了一系列风险与挑战。当前,已有多数国家和地区提出了各自的人工智能政策与法规,并组织召开了相关全球会议,以推动人工智能安全、负责任地发展。本期《人工智能国际治理观察》将关注海外智库对中国、美国、欧盟和英国等国家与地区的人工智能治理政策及方法的评析。

评估34国人工智能发展与治理情况:美国人工智能战略的执行效果仍有待观察,中国的投资和研发能力与美国几乎不相上下

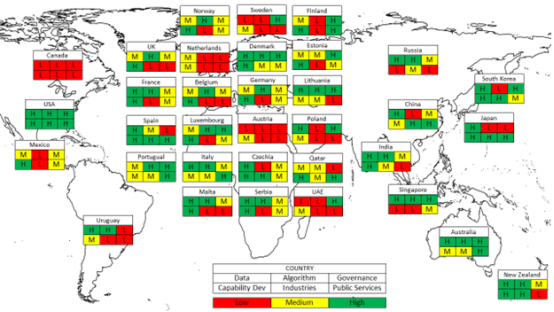

2023年12月13日,布鲁金斯学会发布其客座高级研究员Kevin C. Desouza、加拿大皇家军事学院管理系教授James S. Denford和美国亚利桑那州立大学助理教授Gregory S. Dawson共同撰写的《国家人工智能战略聚类分析(A cluster analysis of national AI strategies)》。文章以已制定并发布了国家人工智能战略的34个国家为研究对象,依据数据管理、算法管理、人工智能治理、能力发展、行业部署情况和公共服务这六个要素来评估一个国家如何进行人工智能治理和管理(数据管理、算法管理和人工智能治理)、打算如何发展人工智能技能(能力发展)以及如何部署或集中人工智能工作(产业、公共服务),并据此创建了各国人工智能战略在所选属性中处于净高、中或低水平的国家集群。

从整体上看,集群范围包括了“净高(美国)”到“净低(加拿大)”,其中,有三组国家具有相同的评估情况,分别为比利时和英国、法国和塞尔维亚,以及瑞典和阿联酋。总体评估情况如下图所示:

人工治理的是人工智能的包容性、透明度和公众信任,以及适当监督的必要性。高集群国家(德国、英国、美国、中国和俄罗斯等)拥有人工智能技术并了解强有力的人工智能治理的价值;中等集群国家(澳大利亚、波兰和瑞典)在安全性、法规、社会公平和风险控制上评估等级较高,但在知识产权保护上的评估等级较低;而包括奥地利、加拿大和日本在内的低集群国家只对基本治理感兴趣。

能力发展指的是每个国家将用于发展其人工智能的资源。高集群国家(印度、墨西哥和美国)计划利用除了商业模式之外的所有能力发展因素;中等集群国家(澳大利亚、中国和波兰)侧重于发展教育的能力而非研究和开发方面;低集群国家(加拿大、俄罗斯和新加坡)专注于研发,并只对人工智能在促进基础教育方面感兴趣。

行业反映了作为国家人工智能工作目标的私营部门行业。高行业集群国家(包括中国、西班牙和美国)计划在除了国防和旅游业以外的所有行业部署人工智能;中等集群国家(包括澳大利亚、印度和俄罗斯)关注人工智能在技术、能源和自然资源、农业和医疗保健领域的应用,而低集群国家(加拿大、墨西哥和瑞典)暂无专注于任何行业的打算。

American Enterprise Institute for Public Policy Research,AEI

文章指出,欧盟《人工智能法案》最显著的特征在于其使用了“基于风险的方法”,根据人工智能对社会造成危害的能力来进行监管。一方面,针对诸如医疗保健、教育、边境监控和公共服务等对基本权利构成重大风险的应用领域的监管重点是减轻潜在危害。另一方面,《法案》禁止了一些具有“不可接受风险”的特定用途,包括使用敏感特征的生物特征分类系统(例如政治信仰、宗教信仰、哲学信仰、性取向、种族)、从互联网或闭路电视摄像头的图像中进行非定向采集以创建面部识别数据库等。根据《法案》,通用人工智能系统的提供者必须符合透明度要求,包括提供有关用于训练人工智能基础模型的数据的详细信息。而被认定为高风险的人工智能系统开发者将需要对其模型进行评估和减轻系统风险,进行对抗性测试,向欧洲委员会报告重大事件,确保网络安全,并报告其能源效率。

Center for Strategic and International Studies, CSIS

英国人工智能安全峰会关注的安全性问题范围狭窄,不能满足民众期待

就“流氓人工智能”问题而言,高度先进的人工智能系统可能超出人类的预期或有意的监督,并做出开发人员预见不到的决策或行动,对此,参会代表们决定定义一组“不应交给人工智能系统的决策”。

[1] https://www.brookings.edu/articles/a-cluster-analysis-of-national-ai-strategies/

[3] https://www.csis.org/analysis/uk-ai-summit-debrief-part-1-framing-ai-risk

文章检索:周韫斐

编译:朱奕霏、杨雨虹

审核:何嘉钰

排版:赵杨博

终审:梁正、鲁俊群

清华大学人工智能国际治理研究院编上述信息均根据原文内容整理,谨供读者参考,不代表本机构立场和观点

关于我们

清华大学人工智能国际治理研究院(Institute for AI International Governance, Tsinghua University,THU I-AIIG)是2020年4月由清华大学成立的校级科研机构。依托清华大学在人工智能与国际治理方面的已有积累和跨学科优势,研究院面向人工智能国际治理重大理论问题及政策需求开展研究,致力于提升清华在该领域的全球学术影响力和政策引领作用,为中国积极参与人工智能国际治理提供智力支撑。

新浪微博:@清华大学人工智能国际治理研究院

微信视频号:THU-AIIG

Bilibili:清华大学AIIG

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง