文章转载自「机器之心」

今天,谷歌宣布推出 Gemini 1.5。

Gemini 1.5 建立在谷歌基础模型开发和基础设施的研究与工程创新的基础上,包括通过新的专家混合 (MoE) 架构使 Gemini 1.5 的训练和服务更加高效。

谷歌现在推出的是用于早期测试的 Gemini 1.5 的第一个版本 ——Gemini 1.5 Pro。它是一种中型多模态模型,针对多种任务的扩展进行了优化,其性能水平与谷歌迄今为止最大的模型 1.0 Ultra 类似,并引入了长上下文理解方面的突破性实验特征。

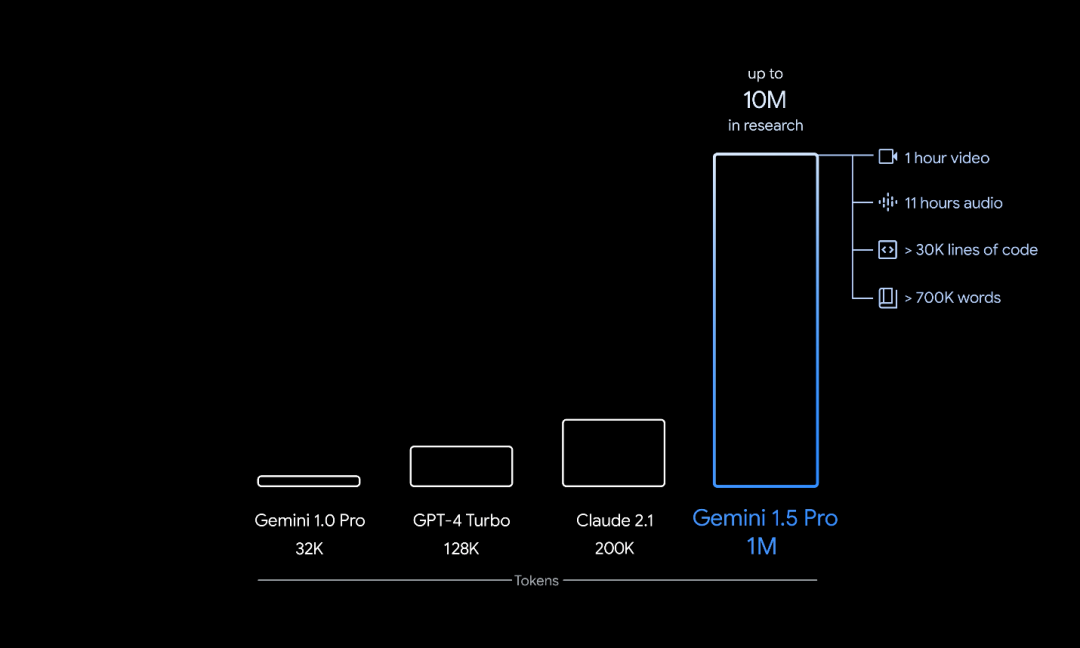

Gemini 1.5 Pro 配备了 128000 个 token 上下文窗口。但从今天开始,少数开发人员和企业客户可以通过 AI Studio 和 Vertex AI 的私人预览版在最多 100 万个 token 的上下文窗口中进行尝试。谷歌还进行了一些优化,以改善延迟、减少计算要求并增强用户体验。

谷歌 CEO Sundar Pichai 和谷歌 DeepMind CEO Demis Hassabis 对新模型进行了专门介绍。

01

高效架构

Gemini 1.5 建立在谷歌对 Transformer 和 MoE 架构的领先研究之上。传统 Transformer 充当一个大型神经网络,而 MoE 模型则分为更小的 “专家” 神经网络。根据给定输入的类型,MoE 模型学会选择性地仅激活其神经网络中最相关的专家路径。这种专业化极大地提高了模型的效率。通过稀疏门控 MoE、GShard-Transformer、Switch-Transformer、M4 等研究,Google 一直是深度学习 MoE 技术的早期采用者和先驱。谷歌在模型架构方面的最新创新使 Gemini 1.5 能够更快地学习复杂任务并保持质量,同时更高效地训练和服务。这些效率正在帮助谷歌团队比以往更快地迭代、培训和交付更高级的 Gemini 版本,并且正在努力进一步优化。

02

更长的上下文,更有用的功能

人工智能模型的 “上下文窗口” 由 token 组成,token 是用于处理信息的构建块。token 可以是文字、图像、视频、音频或代码的整个部分或子部分。模型的上下文窗口越大,它在给定提示中可以接收和处理的信息就越多,从而使其输出更加一致、相关和有用。通过一系列机器学习创新,谷歌增加了 1.5 Pro 的上下文窗口容量,远远超出了 Gemini 1.0 最初的 32,000 个 token。该大模型现在可以在生产环境中运行多达 100 万个 token。这意味着 1.5 Pro 可以一次性处理大量信息,包括 1 小时的视频、11 小时的音频、超过 30,000 行代码或超过 700,000 个单词的代码库。在谷歌的研究中,还成功测试了多达 1000 万个 token。

03

对大量信息进行复杂推理

1.5 Pro 可以在给定提示内无缝分析、分类和总结大量内容。例如,当给出阿波罗 11 号登月任务的 402 页记录时,它可以推理整个文档中的对话、事件和细节。

Gemini 1.5 Pro 可以理解、推理和识别阿波罗 11 号登月任务的 402 页记录中的好奇细节。

04

更好地理解和推理跨模态

1.5 Pro 可以针对包括视频在内的不同模式执行高度复杂的理解和推理任务。例如,当给定一部 44 分钟的巴斯特・基顿无声电影时,该模型可以准确分析各种情节点和事件,甚至推理出电影中容易被忽略的小细节。当给出简单的线条图作为现实生活中物体的参考材料时,Gemini 1.5 Pro 可以识别 44 分钟的巴斯特基顿无声电影中的场景。

05

使用较长的代码块解决相关问题

1.5 Pro 可以跨较长的代码块执行更相关的问题解决任务。当给出超过 100,000 行代码的提示时,它可以更好地推理示例、建议有用的修改并解释代码不同部分的工作原理。Gemini 1.5 Pro 可以推理 100,000 行代码,提供有用的解决方案、修改和注释

06

增强性能

在文本、代码、图像、音频、视频评估综合面板上进行测试时,1.5 Pro 在用于开发大型语言模型 (LLM) 的基准测试中,87% 的性能优于 1.0 Pro。在相同的基准测试中与 1.0 Ultra 相比,它的表现大致相似。即使上下文窗口增加,Gemini 1.5 Pro 仍能保持高水平的性能。在 NIAH 评估中,故意将包含特定事实或陈述的一小段文本放置在很长的文本块中,1.5 Pro 99% 的时间都能找到嵌入的文本,在数据块中如下只要 100 万个 token。Gemini 1.5 Pro 还展示了令人印象深刻的 “上下文学习(in-context learning)” 技能,这意味着它可以从长提示中给出的信息中学习新技能,而不需要额外的微调。谷歌在 MTOB (Translation from One Book )基准测试中测试了这项技能,该基准显示了该模型从以前从未见过的信息中学习的能力。当给定卡拉芒语(一种全球使用人数不足 200 人的语言)的语法手册时,该模型可以学习将英语翻译成卡拉芒语,其水平与学习相同内容的人相似。由于 1.5 Pro 的长上下文窗口是大型模型中的首创,因此谷歌正在不断开发新的评估和基准来测试其新颖的功能。有关更多详细信息,请参阅 Gemini 1.5 Pro 技术报告。技术报告地址:https://storage.googleapis.com/deepmind-media/gemini/gemini_v1_5_report.pdf使用 Gemini 模型进行构建和实验谷歌致力于负责任地将每个新一代 Gemini 模型带给全球数十亿人、开发者和企业用户使用。从今天开始,谷歌将通过 AI Studio 和 Vertex AI 向开发者和企业客户提供 1.5 Pro 预览版。未来,当模型进行更广泛的发布时,届时,谷歌将推出具有标准 128,000 个 token 上下文窗口的 1.5 Pro。很快,随着谷歌对模型的改进,谷歌计划引入从标准 128,000 个上下文窗口开始并扩展到 100 万个 token 的定价等级。早期测试人员可以在测试期间免费尝试 100 万个 token 上下文窗口,速度的显着提高也即将到来。有兴趣测试 1.5 Pro 的开发人员现在可以在 AI Studio 中注册,而企业客户可以联系他们的 Vertex AI 客户团队。参考链接:https://blog.google/technology/ai/google-gemini-next-generation-model-february-2024/#sundar-note

如果你关注大模型领域,欢迎扫码加入我们的大模型交流群,来一起探讨大模型时代的共识和认知,跟上大模型时代的这股浪潮。

更多阅读

Product Hunt 2023 年度产品榜:GPT-4 夺冠、获奖 AI 产品全介绍

Perplexity CEO 专访:拥有十万用户的套壳产品比拥有自有模型却没有用户更有意义

火遍硅谷的Arc浏览器,刚刚发布App和AI功能,体验碾压Chrome!

Kyligence 韩卿:创业 7 年复盘,中美企业服务市场差异浅析

Cubox创始人的产品思考:不要把「总结全文」当做AI阅读产品的唯一亮点

转载原创文章请添加微信:geekparker

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง