编者按:OpenAI最近发布的Sora视频生成模型由于其惊人的生成效果又一次出圈。虽然OpenAI 也发表了技术报告,但人们还是难以了解其是怎么实现的。NVIDIA资深AI算法工程师何宜晖在《How Sora works – detailed explanation 》“Sora如何运作-详细解释”一文中试图从 GenAI从业者的角度来解析Sora的技术实现,值得推荐。如需转载,请联系我们(ID:15937102830)。

OpenAI的Sora代表了人工智能驱动视频生成领域的一个重大飞跃,它结合了几种先进技术,从文本描述中创建高保真视频。本文将深入探讨Sora的关键组件和功能,强调其对扩散transformer、视频压缩网络的创新使用及其新兴功能。

文本描述是合成的

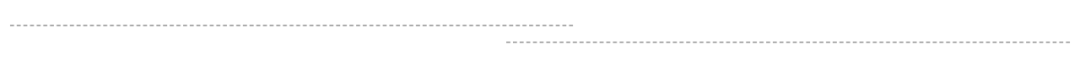

在DALL-E 3之后,他们使用字幕模型为视频生成字幕,captioner模型是与CLIP和语言建模目标联合预训练的,他们甚至可能微调GPT-4来进行字幕!

用于视频压缩的VAE

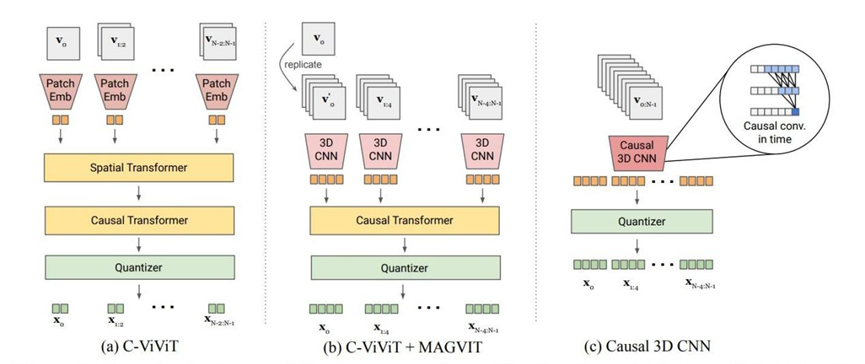

Sora采用基于3D卷积神经网络(3D CNN)的矢量量化变分自编码器(VQ-VAE)进行视频压缩。该网络架构由一个将视觉数据降维到潜空间的编码器和一个从这种压缩表示中重建视频的解码器组成。使用3D cnn可以捕捉视频的时间动态,这对于在生成的剪辑中生成连贯和流畅的运动至关重要。编码器和解码器的对称设计,保证了模型能够有效地压缩和重建视频,保持对原始内容的高保真度。

在较高层次上,通过首先将视频压缩到低维潜空,19,然后将表示分解为时空块,将视频转换为块。

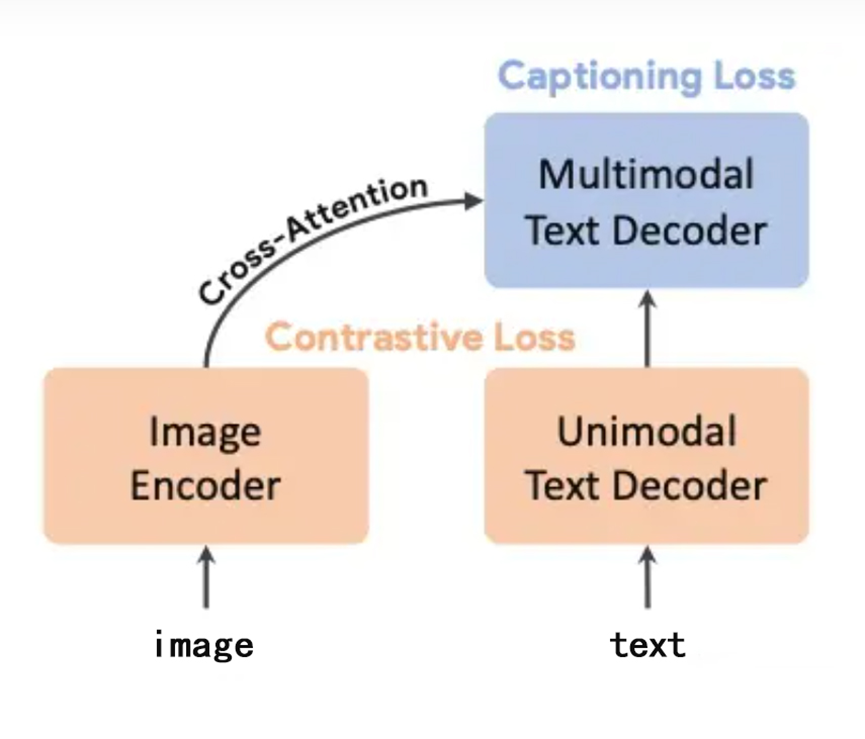

视频压缩网络

我们训练一个网络来降低视觉数据的维度该网络将原始视频作为输入,并输出在时间和空间上都经过压缩的潜在表示。Sora在这个压缩的潜空间中进行训练并随后生成视频。还训练了一个相应的解码器模型,将生成的潜函数映射回像素空间。用于视频压缩的VAE

Sora采用基于3D卷积神经网络(3D CNN)的矢量量化变分自编码器(VQ-VAE)进行视频压缩。该网络架构由一个将视觉数据降维到潜空间的编码器和一个从这种压缩表示中重建视频的解码器组成。使用3D cnn可以捕捉视频的时间动态,这对于在生成的剪辑中生成连贯和流畅的运动至关重要。编码器和解码器的对称设计,保证了模型能够有效地压缩和重建视频,保持对原始内容的高保真度。他们甚至可能微调GPT-4来进行字幕!

时空潜在补丁

给定一个压缩的输入视频,提取一个扮演astransformer token的时空补丁序列。“这个方案也适用于图像,因为图像只是只有一帧的视频。基于块的表示使Sora能够对不同分辨率、持续时间和长宽比的视频和图像进行训练。在推理时,我们可以通过在spr中安排随机初始化的补丁来控制生成视频的大小,rigtelysized网格。

图2:因果分词器架构比较。采用仿形图的解码器采用与编码器对称的结构。

Diffusion transformer

Sora的核心是DiT (Diffusion transformer),一个利用transformer的扩展能力以及扩散模型的迭代细化过程的模型。transformer因其在处理序列数据方面的有效性而闻名,为建模视频的时间动态提供了一个强大的架构。另一方面,扩散过程迭代地细化输出,从有噪声的初始状态开始到期望的视频输出,增强生成视频的质量和连贯性。

用于视频生成的缩放transformer

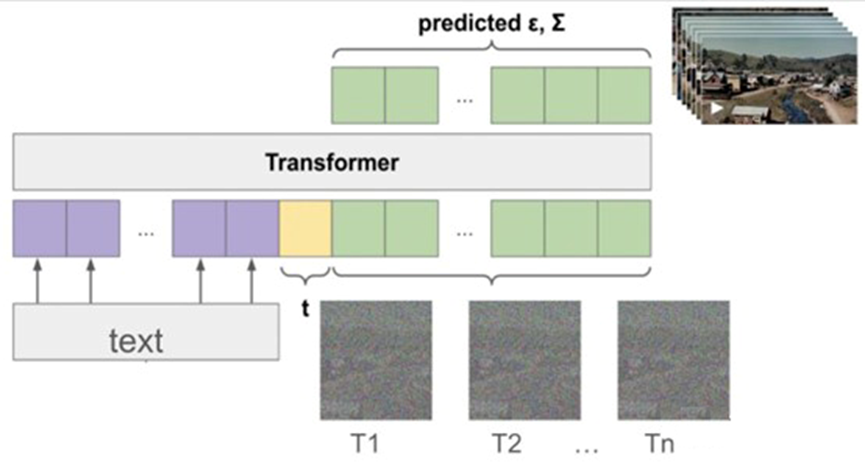

Sora是一种扩散模式21,22,23,24,25;给定输入的噪声补丁(和文本提示等条件信息),它被训练以预测原始的“干净”补丁。重要的是,Sora是一个扩散转换器transformer26,已经在包括语言建模在内的多个领域展示了显著的扩展特性13,14,计算机视觉,15,16,1718和图像生成27 28,29。

本文发现扩散transformer也可以有效地扩展为视频模型。下面,我们在训练过程中展示了固定种子和输入的视频样本的比较。随着训练计算量的增加,样本质量显著提高。

借用数字Point-E,在训练期间,在视频标记中添加随机噪声。transformer由文本条件、扩散时间步长和噪声视频标记提供。

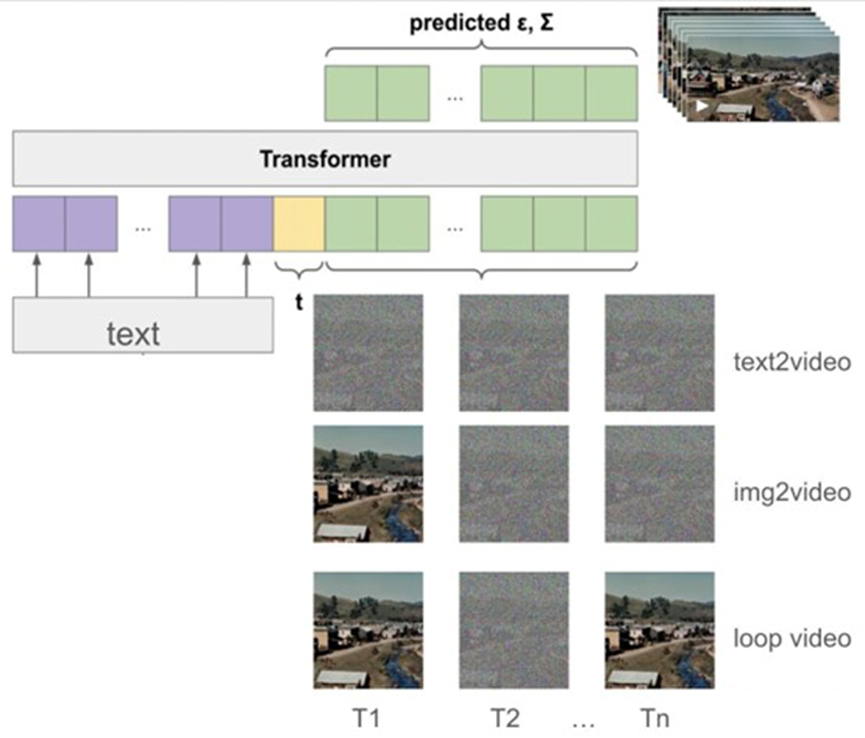

Sora的多功能性扩展到各种应用程序,包括静态图像动画和创建完美的循环视频。

-

动态静态图像:通过将静态图像编码为第一个标记,并将噪声用于其他标记,Sora可以将静态图像赋予生命。

-

完美的循环视频:对于循环视频,确保第一个和最后一个标记在每个扩散步骤都是相同的,创建无缝循环,增强生成内容的美学吸引力。

新兴的能力

Sora最显著的方面之一是它能够在不需要显式编程的情况下表现出3D一致性和物体持久性等新兴能力。传统上,在生成的视频中实现3D一致性需要特定的一致性损失函数。然而,Sora证明,在大规模情况下,这些能力可以自然出现,允许准确模拟真实世界的动态和交互的视频生成

新兴的仿真能力

视频模型在大规模携带时表现出许多有趣的新兴能力。这些功能使Sora能够从物理世界中模拟人、动物和环境的某些方面。这些属性的出现没有对3D、物体等的任何明确的归纳偏差——它们纯粹是尺度现象。

3D一致性,Sora可以生成具有动态摄像机运动的视频。随着镜头的变换和旋转,人物和场景元素在三维空间中始终如一地移动

长程一致性和物体持久性,视频生成系统的一个重大挑战是在采样长视频时保持时间一致性。我们发现,Sora通常(尽管不总是)能够有效地对短期和长程依赖性进行建模。例如,我们的模型可以持久化人,动物和物体,即使他们被遮挡或离开框架。同样,它可以在单个样本中生成相同角色的多个镜头,在整个视频中保持它们的外观。

关于作者:

何宜晖Ethan目前是 NVidia 的资深深度学习算法工程师。他积极参与开源LLM和GenAI的工作。作为一名人工智能研究工程师,他积累了6000次学术论文的引用和2000个GitHub关注者。他曾在NVIDIA开发开源大模型训练框架(NeMo Megatron), 以及在Facebook AI Research (FAIR)做科研。他毕业于西安交大,并在CMU获得计算机硕士学位。

想要了解更多,欢迎入群交流!

权益福利:

1、AI 行业、生态和政策等前沿资讯解析;

2、最新 AI 技术包括大模型的技术前沿、工程实践和应用落地交流(社群邀请人数已达上限,可先加小编微信:15937102830)

关于MoPaaS魔泊云

源于硅谷、扎根中国,上海殷泊信息科技有限公司 (MoPaaS) 是中国领先的人工智能(AI)平台和服务提供商,为用户的数字转型、智能升级和融合创新直接赋能。针对中国AI应用和工程市场的需求,基于自主的智能云平台专利技术,MoPaaS 在业界率先推出新一代开放的AI平台为加速客户AI技术创新和应用落地提供高效的算力优化和规模化AI模型开发、部署和运维 (ModelOps) 能力和服务;特别是针对企业应用场景,提供包括大模型迁移适配、提示工程以及部署推理的端到端 LLMOps方案。MoPaaS AI平台已经服务在工业制造、能源交通、互联网、医疗卫生、金融技术、教学科研、政府等行业超过300家国内外满意的客户的AI技术研发、人才培养和应用落地工程需求。MoPaaS致力打造全方位开放的AI技术和应用生态。MoPaaS 被Forrester评为中国企业级云平台市场的卓越表现者 (Strong Performer)。

END

▼ 往期精选 ▼

2、解码语言模型中的自注意力

3、剖析特定领域大模型

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง