WWW 2024

国际万维网大会(The Web Conference ,WWW),前名为 International World Wide Web Conference,首次设立于1989年,是计算机学会(CCF)推荐A类交叉/综合/新型方向会议。2024年度会议将于5月在新加坡举行,这次会议是介绍和讨论Web相关主题的研究、开发、标准和应用进展的首要场所。

AAAI 2024

AAAI 是由国际人工智能促进协会主办的年会,是人工智能领域中历史最悠久、涵盖内容最广泛的国际顶级学术会议之一,也是中国计算机学会(CCF)推荐的 A 类国际学术会议,在人工智能领域享有较高的学术声誉。2024年,AAAI主办地为加拿大温哥华,录用文章2342篇,录用率为23.75%。

COLING 2024

国际计算语言学大会 (International Conference on Computational Linguistics,COLING),是自然语言处理和计算语言学领域的重要国际学术会议,每两年召开一次,1965年第一届召开以来,COLING已成功地举办了29届。会议将于2024年5月20日至25日在意大利都灵举行。

在WWW 2024、AAAI 2024和COLING 2024中,复旦大学数据智能与社会计算实验室(Fudan DISC)共有五篇论文被录用,其中WWW和AAAI各录用一篇论文;三篇论文被COLING录用。

以下是五篇论文的简介:

1

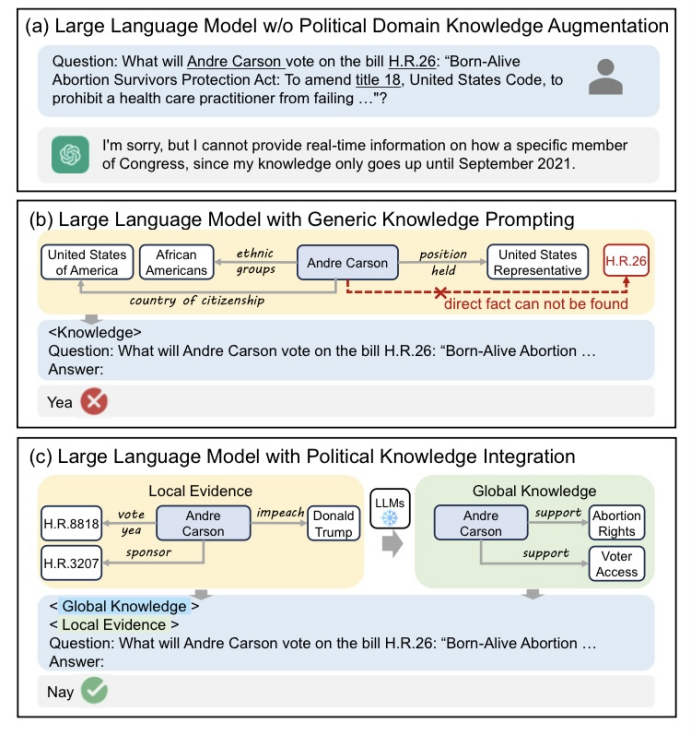

Unifying Local and Global Knowledge: Empowering Large Language Models as Political Experts with Knowledge Graphs

作者:牟馨忆,李泽君,闾涵加,罗杰波,魏忠钰

类别:Long Paper合作单位:美国罗切斯特大学摘要:大语言模型 (LLM) 彻底改变了通用NLP 任务的解决方案。然而,在特定领域部署这些模型仍然面临着诸如幻觉之类的挑战。虽然现有的基于知识图谱检索的方法提供了部分解决方案,但它们不能很好地适应政治领域。一方面,现有的通用知识图谱缺乏重要的政治背景,阻碍了实际任务的推测;另一方面,政治建模的任务通常难以在图谱中获得直接事实,需要对检索到的证据进行更深入的汇总和理解。为了应对这些挑战,我们提出了一个通过知识图谱增强语言模型成为政治专家的框架(PEG)。PEG创建和利用多视图政治知识图谱(MVPKG),该图谱集成了美国立法、选举和外交数据以及来自Wikidata的概念知识。以 MVPKG 为基础,PEG 通过知识获取、聚合和注入来增强现有方法。这个过程首先通过语义过滤检索证据,然后通过隐式或显式方法将其聚合为全局知识,接着通过提示将基本证据和全局知识注入给语言模型。我们在三个真实数据集和多个语言模型上进行的实验证实了 PEG 在处理政治建模任务方面的优越性。

2

Value at Adversarial Risk: A Graph Defense Strategy against Cost-Aware Attacks

作者:廖焌龙*, 付闻达*, 王聪 , 魏忠钰 , 许嘉蓉

类别:Main track合作单位:北京大学摘要:基于图数据的深度学习方法在社交网络分析和交易风险检测等领域得到了广泛应用。然而,最近的研究揭示了一个令人担忧的事实:即使是最具表现力的图神经网络(GNN)也容易受到图对抗性攻击的影响。虽然目前已经提出了几种方法来增强GNN模型的鲁棒性,但很少有人关注一种简单而实用的方法:在节点级别评估对抗性风险并进行保护。该方法为易受攻击的节点分配更高的安全等级,同时为健壮的节点分配更低的安全等级。基于这个新的视角,我们提出了一种新的图防御策略RisKeeper。为了评估对抗性风险,我们引入了一种基于成本感知的图对抗性攻击,该攻击不仅考虑了成本因素,还解决了离散图数据带来的挑战。随后,我们通过求解一个双层优化问题来确定每个节点的理想安全等级。通过在四个真实数据集上进行广泛的实验,我们证明了我们的方法取得了最先进的性能。另外,我们的案例研究为网络的鲁棒性提供了进一步的见解,这激励从业者应加强对相应结构的保护力度。

3

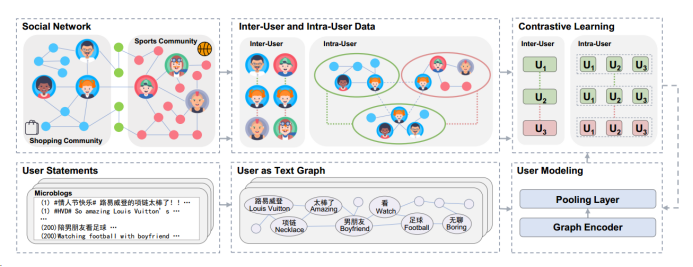

PASUM: A Pre-training Architecture for Social Media User Modeling based on Text Graph

作者:吴焜*,牟馨忆*,薛兰青,应缜哲,王维强,张奇,黄萱菁,魏忠钰

类别:Long Paper合作单位:蚂蚁金服摘要:社交媒体用户建模旨在学习用户表示并将其应用于各种下游任务,现有的工作融合了不同的用户生成内容以更好地学习用户表示,包括由预训练语言模型编码的文本信息和由图模型编码的社交网络信息。然而,受限于文本信息过多和难以收集的社交网络信息,这些方法无法利用全局文本信息,且无法泛化到缺乏网络关系的场景。在本文中,我们提出了一种基于文本图的社交媒体用户建模预训练框架(PASUM)。我们基于文本图模型聚合所有微博来表示用户,学习从微博到用户表示的映射。我们进一步设计了用户间和用户内对比学习任务,让文本编码器学习到网络的通用结构信息。在不同的下游任务场景中,即使缺乏网络关系,PASUM也可通过文本表示用户,实验结果验证了我们框架的有效性和优越性。

4

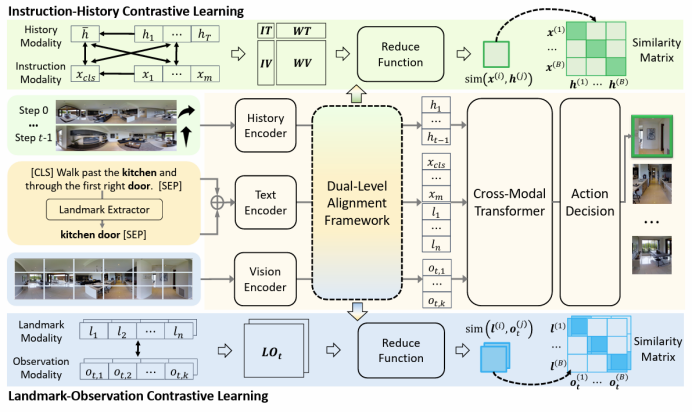

DELAN: Dual-Level Alignment for Vision-and-Language Navigation by Cross-Modal Contrastive Learning

作者:杜梦飞*,吴斌浩*,张霁雯,范智昊,李泽君,罗瑞璞,黄萱菁,魏忠钰类别:Long Paper摘要:视觉语言导航(VLN)要求智能体遵循自然语言指令在未见过的环境中导航。为了完成任务,智能体需要对齐和融合各种导航模态,包括指令、观察和导航历史。现有的工作主要关注融合阶段的跨模态注意力以实现这一目标。然而,由独立的单模态编码器生成的模态特征留存于它们各自的空间中,导致跨模态融合和决策的质量下降。为了解决这个问题,我们提出了一种利用跨模态对比学习的两级别对齐的框架。该框架旨在模态融合前对齐各种导航相关模态,从而增强跨模态交互和动作决策。具体来说,我们根据语义相关性将预融合对齐分为两个级别:指令-历史级别和地标-观察级别。我们还重构了一种两级别指令以适应两级别的对齐。由于用于融合前对齐的训练信号十分有限,我们采用自监督对比学习策略来加强不同模态之间的匹配。我们的方法可以无缝衔接到大多数现存的模型,从而提升在不同VLN基准上的导航性能,包括R2R,R4R,RxR和CVDN。

5

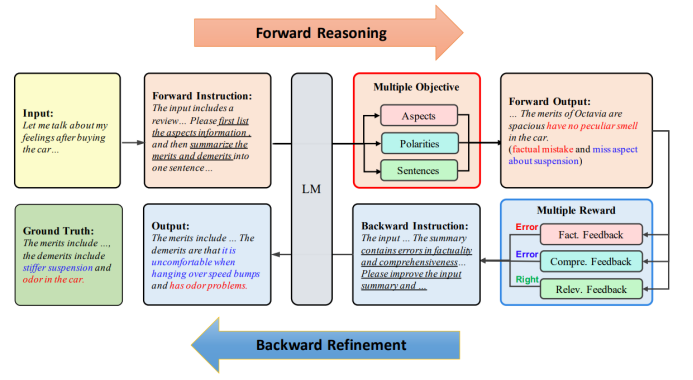

Multi-Objective Forward Reasoning and Multi-Reward Backward Refinement for Product Review Summarization

作者:孙立博*,王思远*,韩萌,赖若飞,张鑫宇,黄萱菁,魏忠钰

类别:Long Paper合作单位:华为技术有限公司摘要:商品评论总结任务旨在根据商品评论生成简洁的摘要,以方便购买决策。这项复杂的任务在现有工作中面临三个挑战:事实准确性、方面全面性和内容相关性。在本文中,我们提出了FB-Thinker框架,通过多目标前向推理和多奖励反向提升来提高LLM的总结能力。为了使LLM具备这两种能力,我们提出了两个中文商品评论总结数据集,Product-CSum和Product-CSum-Cross,用于指令微调和跨领域评估。具体来说,这些数据集是对从在线论坛和公共数据集中收集的商品评论进行ChatGPT辅助的人工标注构造得到的。我们进一步设计了一个评估机制Product-Eval,整合了商品摘要的自动评估、人工评估以及跨领域评估。实验结果显示了我们提出的框架在商品评论总结任务中的竞争力和泛化能力。

END

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง