导语

人类大脑是一个由数以百亿计的神经元相互连接所构成的复杂系统,被认为是「已知宇宙中最复杂的物体」。

集智俱乐部联合国内外多所知名高校的专家学者发起神经、认知、智能系列读书会第三季——「计算神经科学」读书会。从2024年2月22日开始,每周四19:00-21:00进行,持续时间预计10-15周,欢迎感兴趣的朋友报名参与,深入梳理相关文献、激发跨学科的学术火花!读书会从2024年2月22日开始,每周四19:00-21:00进行,持续时间预计10-15周,欢迎感兴趣的朋友报名参与。

分享内容简介

生物神经网络对机器学习中人工神经网络 (ANNs) 的启发已经得到了广泛的认识。然而,大脑中的生物神经网络在网络结构和活动模式上要复杂得多,可以将其视为通过演化和学习来训练以支持人类的自然智能的网络。另一方面,人工神经网络和机器学习作为强大的数据分析工具被越来越多地应用于神经科学的诸多研究中。更有趣的是,人工神经网络提供了一种新的方法来研究复杂行为背后的计算原理。

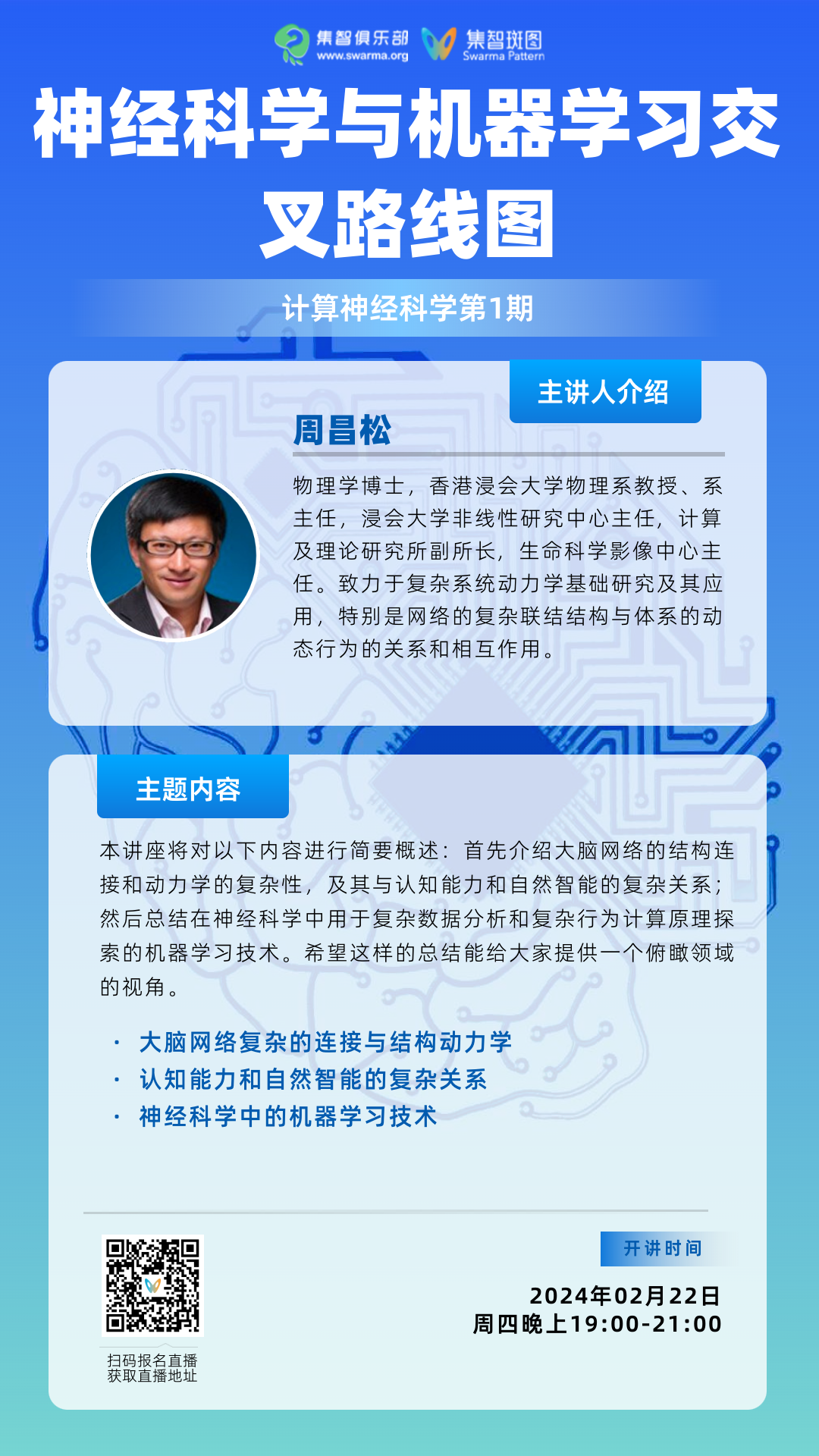

本讲座将对上述内容进行简要概述:首先介绍大脑网络的结构连接和动力学的复杂性,及其与认知能力和自然智能的复杂关系;然后总结在神经科学中用于复杂数据分析和复杂行为计算原理探索的机器学习技术。希望这样的总结能给大家提供一个俯瞰领域的视角,激发大家对开发大脑启发的,特别是利用了大脑的网络连接结构和动力复杂性的机器学习和人工智能系统的兴趣。

分享内容大纲

一、大脑网络复杂的结构连接与动力学

二、认知能力与自然智能的复杂关系

三、神经科学中的机器学习技术

主持人介绍

周昌松,物理学博士,香港浸会大学物理系教授、系主任,浸会大学非线性研究中心主任,计算及理论研究所副所长,生命科学影像中心主任。研究方向:对生物神经网络复杂结构、动力学及其低成本高效益如何启发类脑智能具有浓厚的兴趣。致力于复杂系统动力学基础研究及其应用,特别是网络的复杂联结结构与体系的动态行为的关系和相互作用。近几年与国际国内系统和认知神经科学家合作,把这些理论进展应用到大脑的复杂联结结构和活动以及认知功能及障碍的分析和建模等方面研究中。

周昌松,物理学博士,香港浸会大学物理系教授、系主任,浸会大学非线性研究中心主任,计算及理论研究所副所长,生命科学影像中心主任。研究方向:对生物神经网络复杂结构、动力学及其低成本高效益如何启发类脑智能具有浓厚的兴趣。致力于复杂系统动力学基础研究及其应用,特别是网络的复杂联结结构与体系的动态行为的关系和相互作用。近几年与国际国内系统和认知神经科学家合作,把这些理论进展应用到大脑的复杂联结结构和活动以及认知功能及障碍的分析和建模等方面研究中。

直播信息

时间:2024年2月22日(本周四)晚上19:00-21:00。

参与方式:

扫码参与计算神经科学读书会,加入群聊,获取系列读书会回看权限,成为计算神经科学社区的种子用户,与社区的一线科研工作者与企业实践者沟通交流,共同推动计算神经科学社区的发展。

必读资料

综述文章,重点梳理了有监督机器学习在系统神经科学中的概念应用,认为有监督机器学习可以在以下四个方面发挥重要作用:(1)工程问题;(2)预测变量识别;(3)简单模型基础测试;(4)作为一种大脑模型。Glaser, J. I., Benjamin, A. S., Farhoodi, R., & Kording, K. P. (2019). The roles of supervised machine learning in systems neuroscience. Progress in Neurobiology, 175, 126–137.

文章创新性的提出基于神经影像的“大脑年龄”作为个人大脑健康的生物标志物。HJ Cole, K Franke, Predicting Aging Using Neuroimaging: Innovative Brain Ageing Biomarkers, Trends in Neuroscience 2017.

文章将视觉的深度神经网络模型与语义的吸引子网络模型相结合来研究视觉语义处理。Devereux, B. J., Clarke, A., & Tyler, L. K. (2018). Integrated deep visual and semantic attractor neural networks predict fMRI pattern-information along the ventral object processing pathway. Scientific reports, 8(1), 10636.

文章通过训练单个网络模型来执行 20 项依赖于工作记忆、决策、分类和抑制控制的认知任务,提供了一个研究许多认知任务的神经表征的计算平台。Guangyu Robert Yang, Madhura R. Joglekar, H. Francis Song, William T. Newsome and Xiao-Jing Wang, Task representations in neural networks trained to perform many cognitive tasks.Nature neuroscience, 2019.

文章提出了一个基于梯度下降的兴奋-抑制 RNN 训练框架,融合了大脑的生物学特征,能够简单、灵活的进行RNN的探索性训练。Song HF, Yang GR, Wang XJ (2016) Training Excitatory-Inhibitory Recurrent Neural Networks for Cognitive Tasks: A Simple and Flexible Framework. PLOS Computational Biology 12(2): e1004792

人工神经网络(ANN)是机器学习的重要工具,在神经科学领域能够于构建复杂行为、异构神经活动和电路连接的模型,并以传统模型无法设计的方式探索神经系统的优化。这是一篇给神经科学家的人工神经网络使用教程:首先讨论人工神经网络的基本概念和方法。然后,重点关注如何使这个数学框架更接近神经生物学,详细介绍了如何定制人工神经网络的分析、结构和学习,以更好地解决大脑研究中的各种挑战。Guangyu Robert Yang, Xiao-Jing Wang.Artificial neural networks for neuroscientists: A primer. Neuron. 2020.

感知、维持和使用工作记忆中的时间间隔对于动物在不断变化的世界中在正确的时间预测或采取正确的行动至关重要。文章结合空间信息处理和决策过程训练循环神经网络来研究其中的神经机制。发现神经网络通过旧有轨迹的状态演化来感知时间,并通过缩放演化速度来产生时间间隔。Zedong Bi and Changsong Zhou, Understanding the computation of time using neural network models, Proc Natl Acad Sci USA, 117, 10530 (2020).

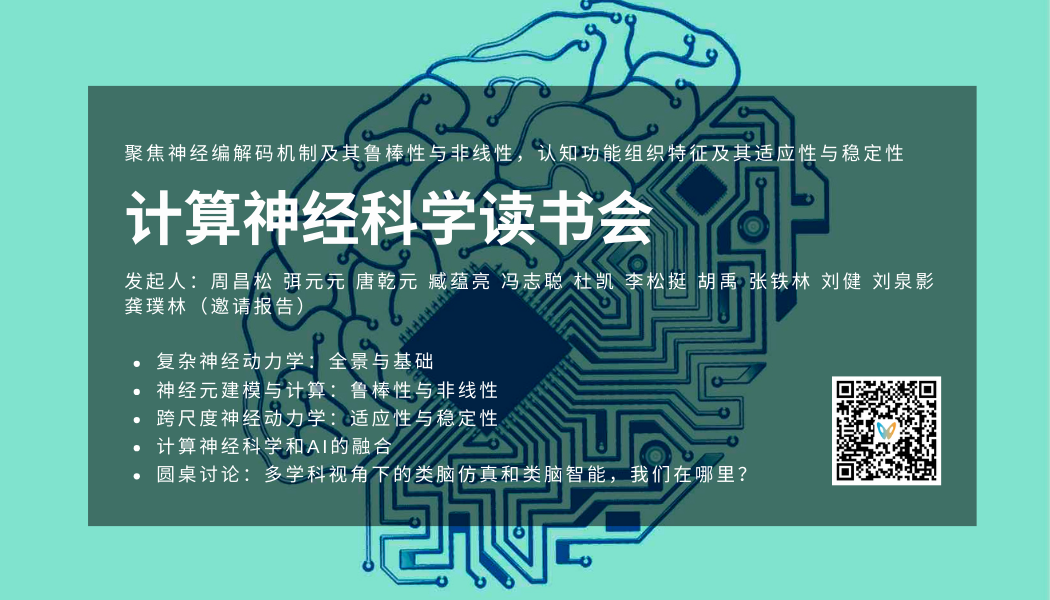

计算神经科学读书会

人类大脑是一个由数以百亿计的神经元相互连接所构成的复杂系统,被认为是「已知宇宙中最复杂的物体」。本着促进来自神经科学、系统科学、信息科学、物理学、数学以及计算机科学等不同领域,对脑科学、类脑智能与计算、人工智能感兴趣的学术工作者的交流与合作,集智俱乐部联合国内外多所知名高校的专家学者发起神经、认知、智能系列读书会第三季——「计算神经科学」读书会,涵盖复杂神经动力学、神经元建模与计算、跨尺度神经动力学、计算神经科学与AI的融合四大模块,并希望探讨计算神经科学对类脑智能和人工智能的启发。读书会从2024年2月22日开始,每周四19:00-21:00进行,持续时间预计10-15周,欢迎感兴趣的朋友报名参与,深入梳理相关文献、激发跨学科的学术火花!

详情请见:计算神经科学读书会启动:从复杂神经动力学到类脑人工智能

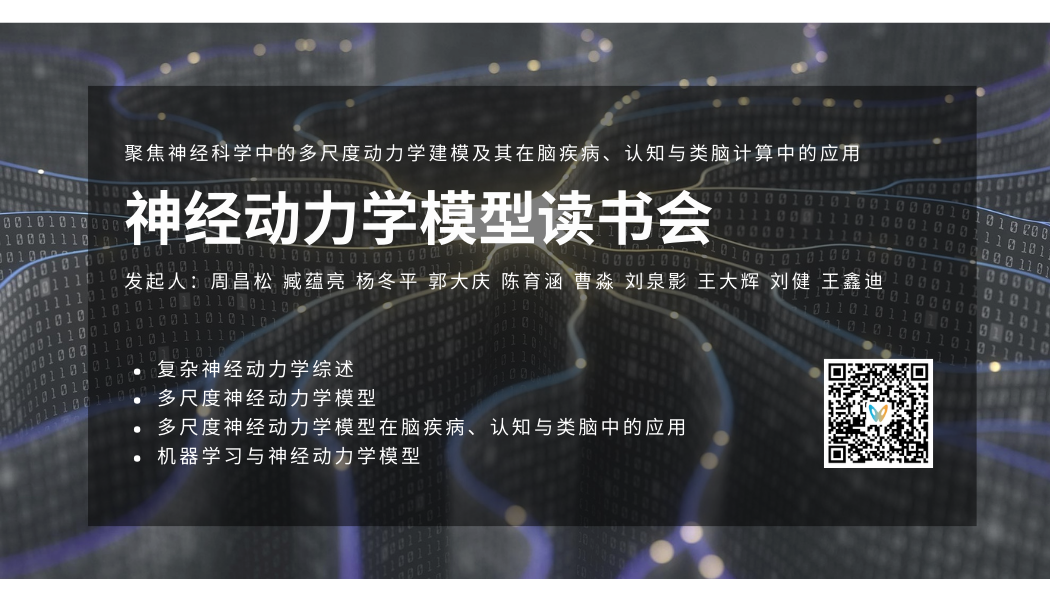

神经动力学模型读书会

为了促进神经科学、系统科学以及计算机科学等多领域学术工作者的交流合作,吸引更多朋友共同探索脑科学与类脑研究,周昌松、臧蕴亮、杨冬平、郭大庆、陈育涵、曹淼、刘泉影、王大辉、刘健、王鑫迪等来自国内外多所知名高校的专家学者在集智俱乐部共同发起「神经动力学模型」读书会,历时四个月研讨,近日圆满结束。

本季读书会形成了聚集500+成员的神经动力学社区,积累了40+小时综述、解读、研讨的视频记录,以及多篇社区成员总结的词条、笔记、翻译、科普资料等。现在报名加入读书会,即可加入社区交流讨论(微信),并解锁相关视频、文本资料。我们对脑的探索才刚刚起航,欢迎你一道参与,共同点亮更多脑科学研究的岛屿!

详情请见:

500+神经动力学社区成员,邀你共同点亮更多脑科学研究的岛屿

点击“阅读原文”,报名读书会

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง