导语

增强AI系统的透明度能够更好的促进人类对大模型的的理解和控制。如何提供简单但有效的解决方案在大模型诚实性、无害性、追求权力等安全问题上发挥作用?

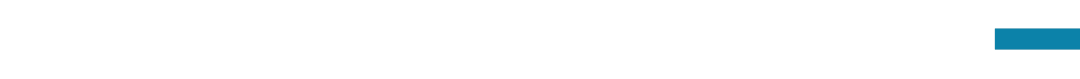

“大模型安全与对齐”读书会的第六期,我们邀请到了卡内基·梅隆大学的Andy Zou,他这次将讨论一种新颖的,以认知神经科学为启发的,用于理解和控制神经网络的内部工作机制的方法,旨在提高AI系统的透明度和安全性。

分享内容大纲

表征工程(Representation Engineering)

-

研究动机(与机制解释Mechanistic Interpretability进行对比)

-

RepE 包括对于神经活动的阅读与控制 – AI“读心术”与“精神控制”的方法介绍

- RepE 的最新进展与应用(在广泛的安全相关问题上的应用,包括情感,诚实度、对抗鲁棒性、追求权力等)

涉及到的参考文献

表征工程(Representation Engineering)

主讲人介绍

Andy Zou,卡内基·梅隆大学在读博士,师从Zico Kolter和Matt Fredrikson。Center for AI Safety联合创始人。个人网站:https://andyzoujm.github.io/研究方向:AI安全等。

Andy Zou,卡内基·梅隆大学在读博士,师从Zico Kolter和Matt Fredrikson。Center for AI Safety联合创始人。个人网站:https://andyzoujm.github.io/研究方向:AI安全等。

涉及到的参考文献

-

Zou A, Phan L, Chen S, et al. Representation engineering: A top-down approach to ai transparency[J]. arXiv preprint arXiv:2310.01405, 2023.

-

Pan A, Chan J S, Zou A, et al. Do the rewards justify the means? measuring trade-offs between rewards and ethical behavior in the Machiavelli benchmark[C]//International Conference on Machine Learning. PMLR, 2023: 26837-26867.

- Zou A, Wang Z, Kolter J Z, et al. Universal and transferable adversarial attacks on aligned language models[J]. arXiv preprint arXiv:2307.15043, 2023.

直播信息

时间:2024年3月16日(周六)早上10:00-12:00。参与方式: 扫码参与大模型安全与对齐读书会,加入群聊,获取系列读书会回看权限,成为大模型安全与对齐读书会社区的种子用户,与社区的一线科研工作者与企业实践者沟通交流,共同推动大模型安全与对齐读书会社区的发展。

扫码参与大模型安全与对齐读书会,加入群聊,获取系列读书会回看权限,成为大模型安全与对齐读书会社区的种子用户,与社区的一线科研工作者与企业实践者沟通交流,共同推动大模型安全与对齐读书会社区的发展。

报名成为主讲人

读书会成员均可以在读书会期间申请成为主讲人。主讲人作为读书会成员,均遵循内容共创共享机制,可以获得报名费退款,并共享本读书会产生的所有内容资源。具体见系列读书会详情:2024开年读书会:AI安全与对齐——应对前沿AI失控与滥用的技术路线。

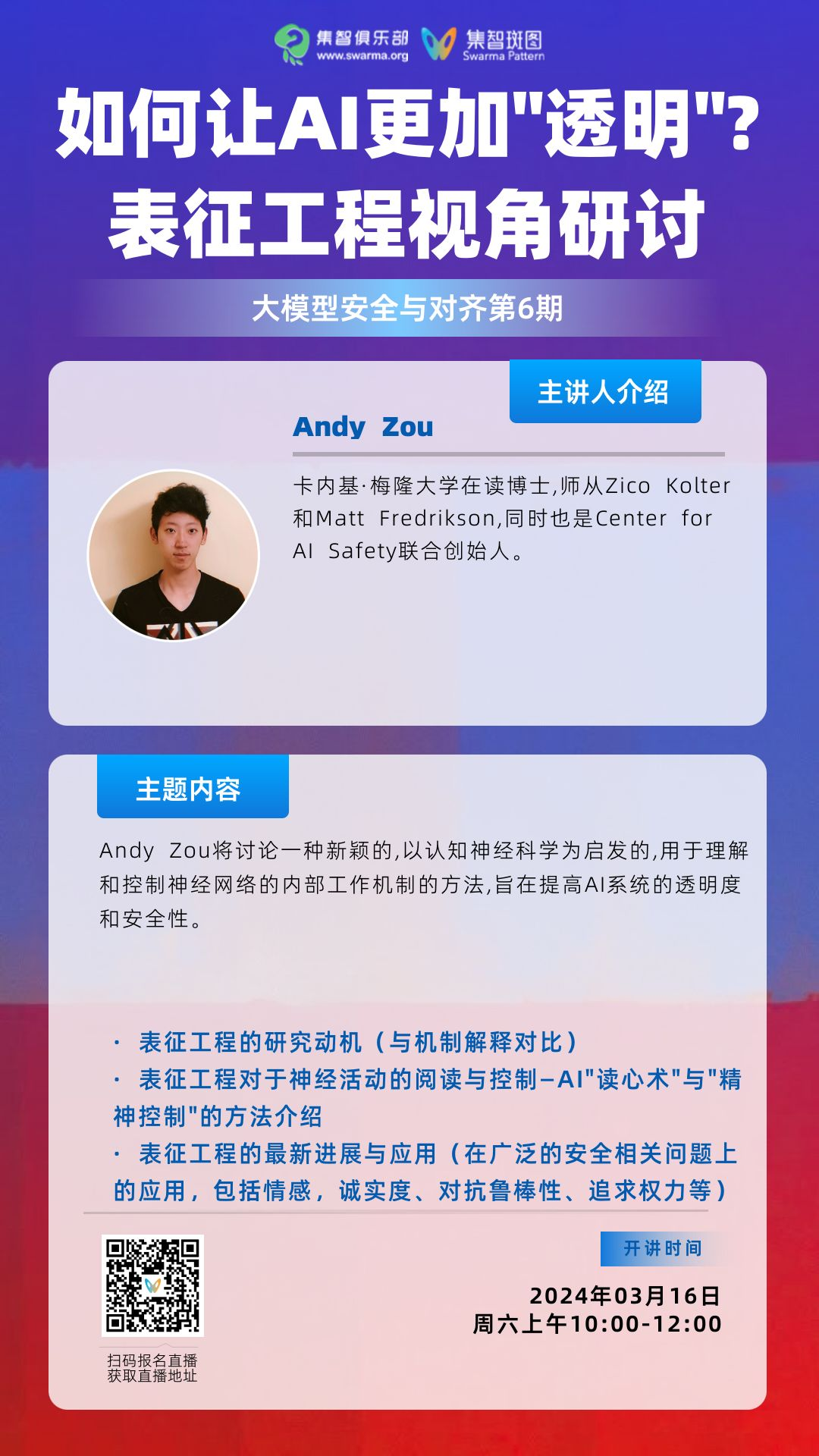

大模型安全与对齐读书会

大模型的狂飙突进唤醒了人们对AI技术的热情和憧憬,也引发了对AI技术本身存在的社会伦理风险及其对人类生存构成的潜在威胁的普遍担忧。在此背景下,AI安全与对齐得到广泛关注,这是一个致力于让AI造福人类,避免AI模型失控或被滥用而导致灾难性后果的研究方向。集智俱乐部和安远AI联合举办「大模型安全与对齐」读书会,由多位海内外一线研究者联合发起,旨在深入探讨大模型安全与对齐所涉及的核心技术、理论架构、解决路径以及安全治理等交叉课题。

详情请见:2024开年读书会:AI安全与对齐——应对前沿AI失控与滥用的技术路线

特别鸣谢安远AI对本次读书会的内容贡献。

安远AI是一家位于北京、专注于AI安全与治理的社会企业。我们的使命是引领人机关系走向安全、可信、可靠的未来。我们面向大模型和通用人工智能安全和对齐问题,进行风险研判、建立技术社区、开展治理研究、提供战略咨询以及推动国际交流。

点击“阅读原文”,报名读书会

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง