导语

受大脑中混沌动力学的启发,国科大杭州高等研究院的陈洛南团队提出了混沌脉冲反向传播(CSBP)算法,不仅为脉冲神经网络(SNN)的高效训练提供了一个强大的工具,而且为深入理解大脑的学习机制提供了新的见解。该研究成果近日以“Brain-inspired Chaotic Spiking Backpropagation”为题在线发表于《国家科学评论》(National Science Review)。

研究领域:脉冲神经网络,脑启发机器学习,混沌动力学,反向传播 王梓鉴,陶鹏,陈洛南 | 作者

王梓鉴,陶鹏,陈洛南 | 作者

论文题目:Brain-inspired chaotic spiking backpropagation

论文链接:https://doi.org/10.1093/nsr/nwae037

Github链接:https://github.com/Wangzj000/CSBP

论文作者:王梓鉴,陶鹏,陈洛南

深度神经网络(DNN)已经成为工程和科研领域的基本工具之一,它在图像识别、机器翻译和蛋白质结构预测等方向都有着广泛应用。然而,DNN与真实神经网络的差异非常大,特别是在能耗方面,DNN的能耗远超人类大脑。据估计ChatGPT每月需要消耗超过50万千瓦时的电能,而人脑的的参数比ChatGPT大约高三个数量级,功耗却只有20瓦左右,足以见得人脑之高效。

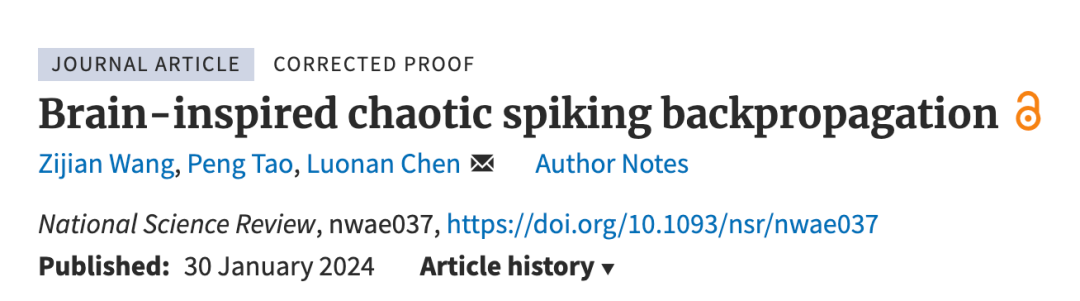

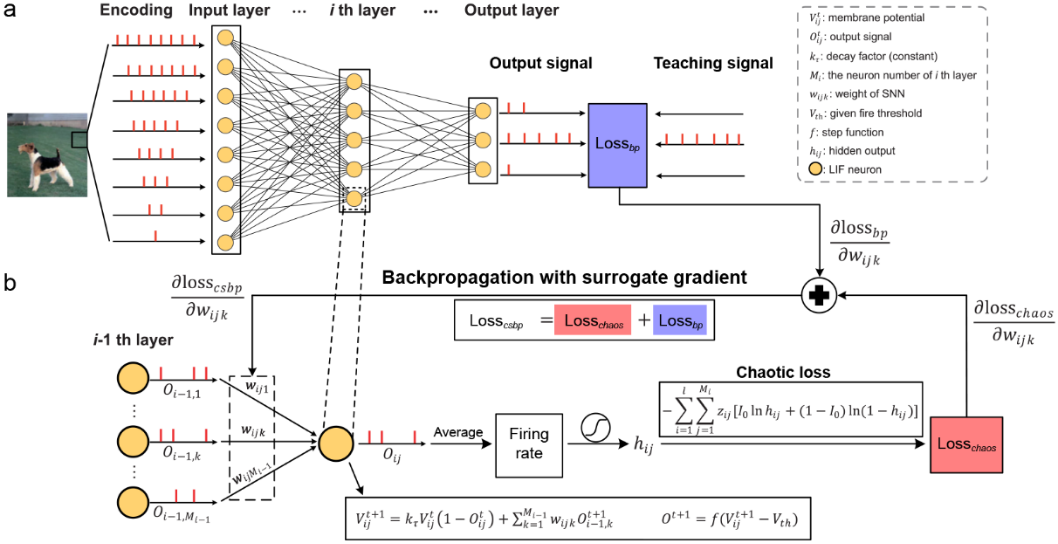

图1:脉冲神经网络的示意图

脉冲神经网络(Spiking Neural Network,SNN,图1)作为脑科学和人工智能相互交叉而发展的第三代人工神经网络,可以基于事件驱动的二进制脉冲信号来表征和处理信息。由于输入的脉冲信号需要累计到一定程度才会激发输出脉冲,这种稀疏化的特征可以让SNN实现与人脑相当的功耗。除此之外,SNN可以有效解决传统DNN时空信息表征效率低、自组织学习能力弱和硬件实现难度大等核心难题,因此吸引了国内外学者广泛的研究兴趣。

然而,由于SNN的激活函数是不可微的,因此无法直接用DNN中经典的反向传播(BP)算法来训练SNN。除了脉冲时序依赖可塑性(STDP)和突触自组织传播(SBP)等性能较弱的无监督自学习算法,SNN的主流学习算法可以分为两类:其中一类是将通过BP训练好的DNN转化为SNN,如从最早的Spiking CNN到最近的QCFS等;另一类是使用代理梯度解决激活函数不可微的问题,然后通过BP的方式来近似学习,如从早期的tempotron和ReSuMe到近期的STBP、ASF、SEW和TET等。前一类方法通常有更好的性能,但本质上还是要先训练DNN,因此无法从根本上解决能耗高的问题。后者虽然借助代理梯度实现了基于BP算法的学习,但它在通用学习任务上的性能和同等复杂度的DNN相比还有较大的差距,这极大地限制了SNN的应用。综上,现在急需一种新型的SNN学习算法使得SNN的性能可以比肩的传统DNN。

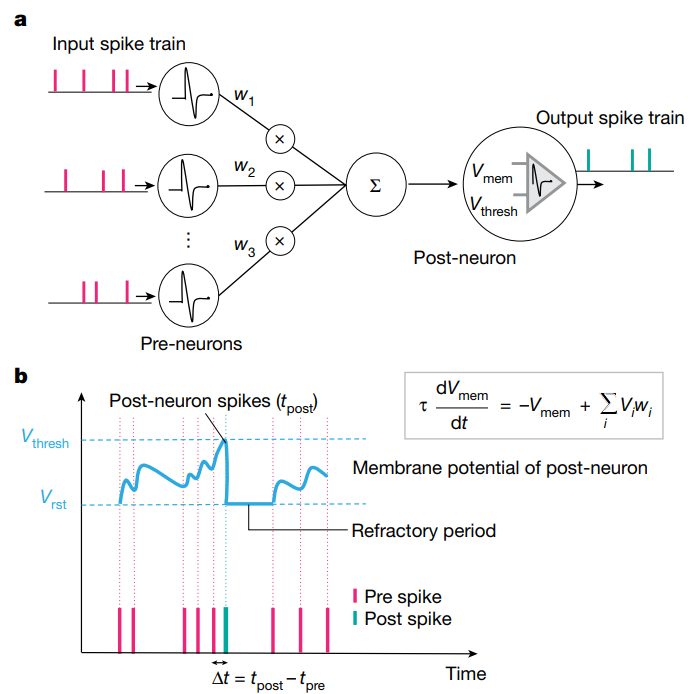

图2:乌贼神经元的电信号

混沌与相对论和量子力学齐名,被誉为是20世纪自然科学领域中三个最重要的理论发现之一,是由确定性系统产生不可预测性的全局动力学现象。具体来说,混沌与不确定性的随机现象相似但本质不同,它是一种对初值十分敏感的非周期非线性的确定性动力学行为并具有全局动态性和伪随机性,其状态在分形空间具有遍历性。在生命体中,这种动力学行为不仅在心脏、神经元乃至大脑中都有发现,而且它对许多生命过程都非常重要,例如基因的表达和调控、信号处理、睡眠和嗅觉识别。

其中,Skarda和Freeman的实验表明,大脑神经元的混沌动力学是兔子获取新的嗅觉模式不可缺的因素,进一步Matsumoto和Aihara等的实验发现乌贼的神经元利用混沌动力学来感知外部信息,这些研究暗示经过亿万年的进化或筛选,动物大脑不是只采用现行深度学习的梯度动力学或随机动力学而是利用了混沌动力学认知或学习。此外,最近也有实验表明,动物大脑的神经网络是处在有序和混沌之间的临界或准临界状态。值得一提的是,由于伪随机性和遍历性(全局性)等丰富的动力学特性,混沌已经被广泛用于解决全局优化问题。

那么是否可以借鉴动物大脑学习过程中的混沌动力学来建立新型的SNN通用学习算法?

图3:CSBP算法原理示意图

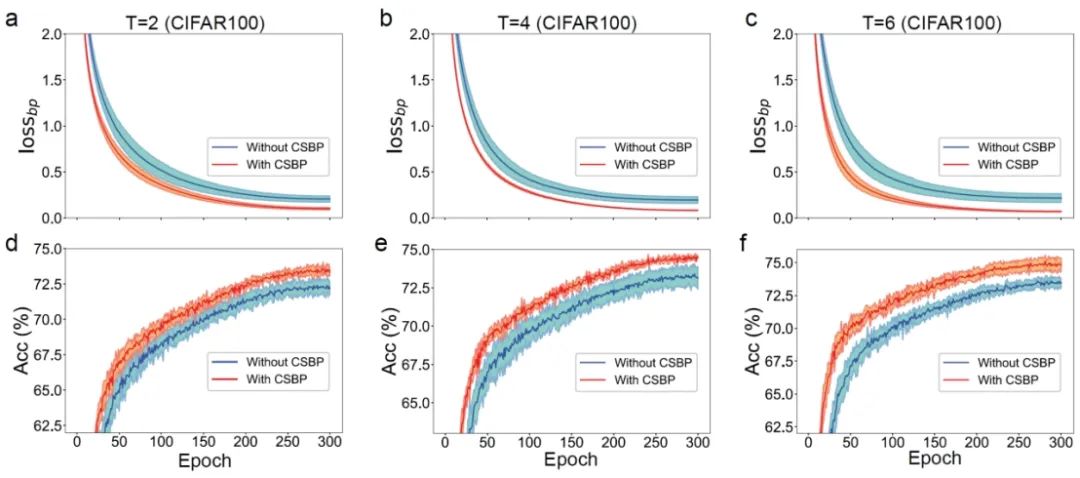

受大脑中混沌动力学的启发,国科大杭州高等研究院的陈洛南团队提出了混沌脉冲反向传播(CSBP,图3)算法,它通过在SNN内部引入一项混沌损失函数来给神经元增加一项负反馈,从而使网络权重产生类似大脑中的混沌。理论上,该团队证明了CSBP的学习过程在初始阶段是混沌的,然后随着混沌模拟退火会出现各种分叉动力学,最终退化为梯度动力学并收敛。计算上,利用混沌动力学的遍历性和伪随机性,CSBP在基准数据集上达到了更低的训练损失和更好的泛化性能。特别地,CSBP在传统的大规模静态数据集(ImageNet和CIFAR100,图4)和神经形态数据集(DVS-CIFAR10和DVS-Gesture)上的准确性和鲁棒性均优于现有的方法。

图4:CSBP在CIFAR100数据集上的性能

总的来说,CSBP不仅为SNN的高效训练提供了一个强大的工具,而且为深入理解大脑的学习机制提供了新的见解。该研究成果近日以“Brain-inspired Chaotic Spiking Backpropagation”为题在线发表于《国家科学评论》(National Science Review,IF5=22.3)。国科大杭州高等研究院的2021级直博生王梓鉴和助理研究员陶鹏为本论文共同第一作者,陈洛南研究员为通讯作者。国家自然科学基金和中科院为此项研究提供了资助。

计算神经科学读书会

详情请见:计算神经科学读书会启动:从复杂神经动力学到类脑人工智能

混沌科学系列科普课程

推荐阅读

1. PNAS 速递:基于脑启发的脉冲神经网络神经回路演化2. NeuroAI:迈向下一代人工智能3. 鱼群与大脑的相似性:在混沌与秩序边缘的临界态高效运作4. 张江:第三代人工智能技术基础——从可微分编程到因果推理 | 集智学园全新课程5. 龙年大运起,学习正当时!解锁集智全站内容,开启新年学习计划6. 加入集智,一起复杂!

点击“阅读原文”,报名读书会

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง