今日,澜舟科技正式宣布Mengzi3-13B开源!对学术研究完全开放,同时支持免费商用。

开源地址

-

GitHub:https://github.com/Langboat/Mengzi3

-

HuggingFace:https://huggingface.co/Langboat/Mengzi3-13B-Base

-

ModelScope:https://www.modelscope.cn/models/langboat/Mengzi3-13B-Base

-

Wisemodel:https://wisemodel.cn/models/Langboat/Mengzi3-13B-Base

期待大家给出更多反馈!

快速开始

import torchfrom transformers import AutoModelForCausalLM, AutoTokenizertokenizer = AutoTokenizer.from_pretrained("Langboat/Mengzi3-13B-Base", use_fast=False, trust_remote_code=True)model = AutoModelForCausalLM.from_pretrained("Langboat/Mengzi3-13B-Base", device_map="auto", trust_remote_code=True)inputs = tokenizer('介绍一下孟子:', return_tensors='pt')if torch.cuda.is_available(): inputs = inputs.to('cuda')pred = model.generate(**inputs, max_new_tokens=512, repetition_penalty=1.1, eos_token_id=tokenizer.eos_token_id)print(tokenizer.decode(pred[0], skip_special_tokens=True))

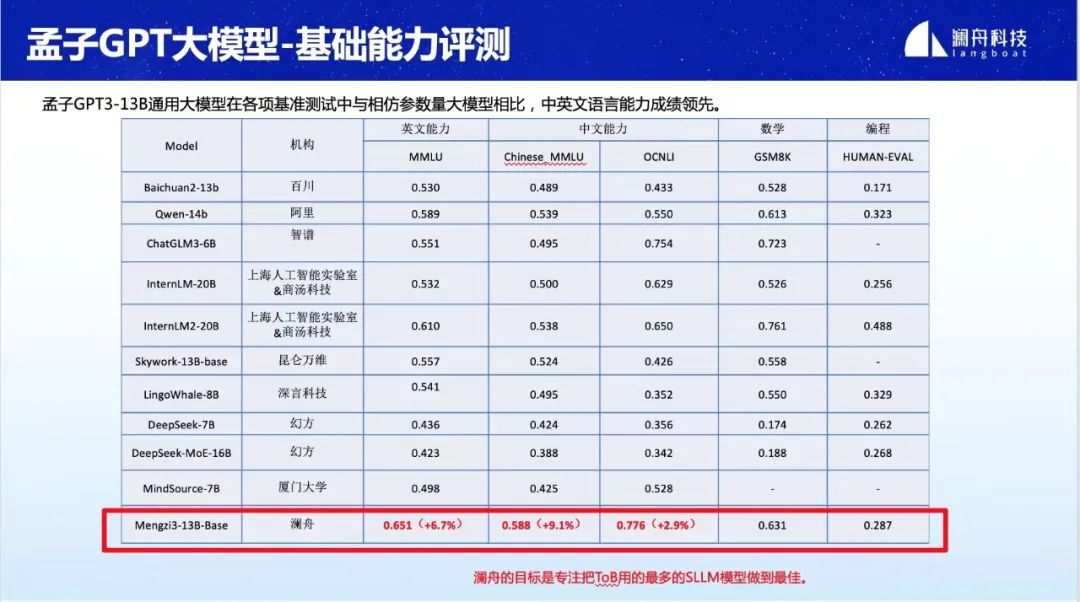

相较于今年1月发布的孟子大模型GPT V2系列(包括孟子大模型-标准、孟子大模型-轻量、孟子大模型-金融、孟子大模型-编码),Mengzi3-13B在数据集质量上有了显著的提升。其采用的Mengzi-3数据集规模高达3T tokens,涵盖了网页、代码、书籍、论文等多元化、高质量的数据来源。

在MMLU、Chinese-MMLU、GSM8K、HUMAN-EVAL等多项公开数据集进行的模型效果评估中,Mengzi3-13B均展现出了卓越的性能表现。在参数量20B以内的轻量化大模型领域,Mengzi3-13B在中英文语言能力方面的成绩尤为突出,具备了出色的实用性和高性价比,能更好的满足企业的商业化需求。 开源大模型无疑是科技界的一次革命性突破,其意义和影响都将是深远的。通过此次孟子大模型V3版本的Mengzi3-13B的开源,澜舟科技期望为中国大模型生态的蓬勃发展贡献一份力量,召唤更多的开发者共同探索、创新和贡献。共同推动大模型生态的繁荣与进步。

开源大模型无疑是科技界的一次革命性突破,其意义和影响都将是深远的。通过此次孟子大模型V3版本的Mengzi3-13B的开源,澜舟科技期望为中国大模型生态的蓬勃发展贡献一份力量,召唤更多的开发者共同探索、创新和贡献。共同推动大模型生态的繁荣与进步。

👇扫码加入孟子开源社区微信群

”

澜舟科技官方网站

https://langboat.com

获奖与新闻

澜舟科技完成信通院“可信AI”评估

澜舟科技完成Pre-A+轮融资

HICOOL 2021创业大赛一等奖 | 周明博士专访

最新合作相关新华智云 | 相关中国联通相关华夏基金 | 相关同花顺参与人数中文在线| 参与人数说故事

技术专栏一览

孟子开源社区微信群

开源项目地址

https://s.langboat.com/mengzi

期待您的关注与加入:)

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง