实测新版LiblibAI:终于把模型、生图、工作流塞进一个碗了

梦瑶 发自 凹非寺

量子位 公众号 QbitAI

上网冲浪突然看到这个评论我懵了,升级过后的LiblibAI ,真的有这么好用?

甚至直接把另一个产品的会员停了,转身冲了年费那种……

这我可得试试了。

直接说体感发现:这次LiblibAI不仅一口气上线了N个模型,连视频都加了特效玩法,这波真不是单纯地“换皮上线”。

先简单测了一下,roll了效果出来,发现可能真的有点东西。

给大家摆几个最简单的效果,图是AI画的,视频是AI做的,这些内容在LiblibAI这一个平台里就能搞定——

还有这个,小女孩突然气球附体,咻地一声飞走了,毫无防备:

浅浅跑了几个case,发现效果居然都还不错。

这下,我彻底坐不住了,决定正儿八经实测一波走起~

一手实测LiblibAI 2.0

先说AI用户们最关心的创作链路和核心升级。

这次LiblibAI 2.0最大的动作,就是从一个“找模型”的网站,变成了可以直接做“AIGC流水线”的平台。

也就是说,大家用AI创作时就不用再开一堆网站来回切了,老用户看到这,可能会忍不住感慨一句:终于啊!

而且这次界面也变了不少,整体风格从“极客社区范”,变成了有点像“ChatGPT+Canva”的合体?

能调模型,也能做设计,不错不错。

模型能力这块,也没有丢底子。

LiblibAI一开始给自己的定位就是国内SD圈子最硬核的多模型社区,这次当然也没落下它的基本盘。

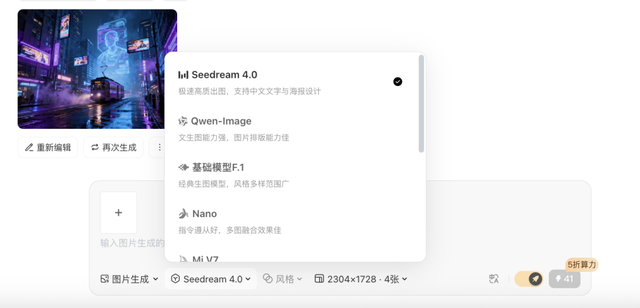

LiblibAI 2.0这次把Qwen-Image、Seedream 4.0、Nano-Banana这些热门模型直接搬上桌,想用哪个用哪个。

值得一提的是,LiblibAI这次还接入了Midjourney家族当前最强的版本——V7模型。

要知道,Midjourney的V7模型在今年4月才刚刚发布,而国内不少平台才在近期陆续接入。

对比圈内节奏,LiblibAI这波节拍点把握得不慢啊~

至于视频模型,升级后的LibLibAI 2.0集得也挺全——

这次把海螺2.0、通义万相2.5、可灵2.5、Vidu Q1等主流视频模型都集齐了。

这一锅炖下来,新老模型真·都被照顾到了……

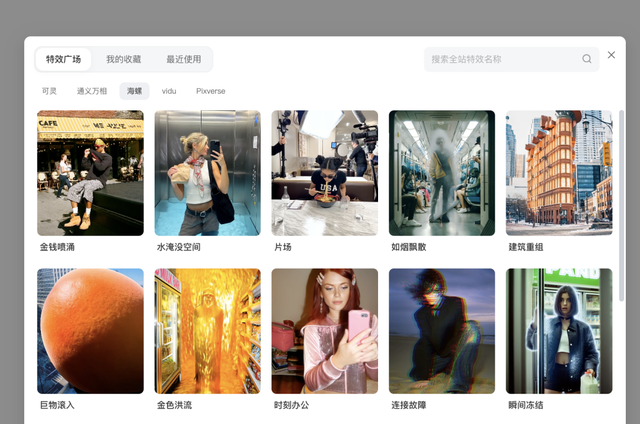

但个人体验下来,这次最有看头也是最想和大家分享的,当属它视频生成页面的添加特效功能,可以直接在视频生成板块“添加特效”。

简单压测了三把:

第一测,上传了一张城堡的图片,选择了一个“一飞冲天”的特效,于是乎:

好家伙,古老城堡摇身一变成火箭,直接发射到天空!

再试一把,这次选了个飞行特效,让小猫化身小蜜蜂,也体验一把“一飞冲天”的感觉:

动作衔接都还行,就是飞着飞着,猫儿这个瞳孔颜色突然变了。稳定性和一致性这一块,模型还有有待进步的空间(老师推眼镜.gif)。

最后第三测,再来整个好玩的——

生成一张最近超火的NanoBanana同款拍立得照片:

拍立得倒是拍出来了,Q版人物也挺可爱,但第二秒镜头没对准人脸,画面直接“跑偏”。

这里顺便提一句,它现在用模板生成视频时,提示词是锁死的,不支持编辑。

和Pika的逻辑类似,效率高了,但牺牲了一些画面可控性。

另一个编辑部小伙伴一致觉得蛮实用的,是视频的首帧/尾帧功能。

适合搞搞短剧封面、BGM剪辑片段什么的,我做了个“穿越草原和城堡”的效果,首尾都挑得蛮准:

除了模型生成能力外,还有一个小功能很实用:

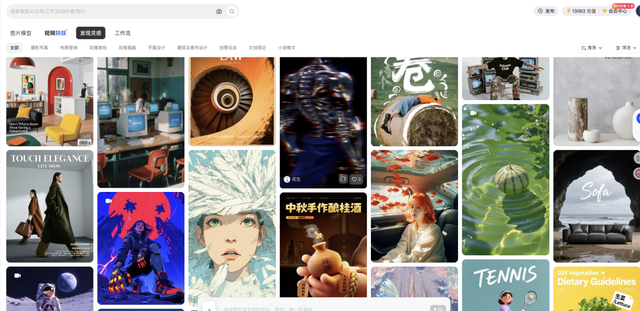

这次LiblibAI整合了全球最大图片风格开源模型库——

覆盖插画、摄影、电商、海报、IP等各类视觉风格,其实本质上是把“模型选型”流程视觉化了。

尤其对新用户来说,不用Prompt、不用找教程,直接选个模板就能生出成片。

真香,但没完全香

这波实测下来,LiblibAI 2.0确实给足了想象空间,从原来那个模型集散地,一脚跳进了创作工作流的大池子里。

但AI体验这事儿,不能光拼模型全不全,还得看用户到底买不买帐——

比如:这次即便氪了金却换不来更快的出图速度,尤其一次性生四张图的时候……(那一刻感觉钱白花了)

再比如:模型看似挺多,其实不少是同一家出的不同版本,选项多但惊喜感弱……

此外,一些网友在体验时似乎还出现了页面卡顿的问题:

说回LiblibAI这家公司,其实它本身就挺“非典型”,非常擅长内容产品打法。

在AI应用赛道里,LiblibAI算是一位速度型选手——

曾一年跑完四轮融资,创下当时国内AI应用赛道的融资速度纪录。

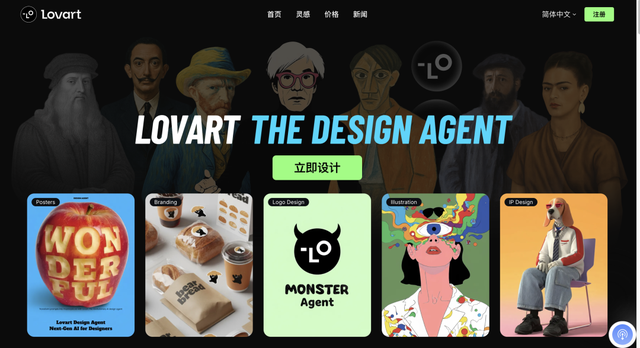

更值得一提的是,LiblibAI海外子公司打造的另一个AI设计产品,大家也很熟悉,全球首个设计Agent——Lovart。

当时产品才内测上线5天,排队体验人数就突破了10万。

LiblibAI的创始人陈冕也不简单。

此前是剪映、CapCut的商业化负责人,也是字节跳动当年最年轻的产品 4-1(对标阿里P9)之一,擅长从“用户-内容-流量”中构建闭环。

所以你就能理解,Liblib从模型广场走向“创作闭环”,并不是试水,而是照着增长路径来搞的。

看看现在,Liblib似乎在从“模型开源社区”向“创作者的AI全家桶”转身——

这条路看起来顺,实则每一步都不轻松,用户信任并不会因为功能叠加而自然延续,它始终需要被重新验证。

下一步能不能稳住,不光看工具是不是够强,而在于有没有人,还愿意在这里继续玩下去…是吧?

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง

ufabet

มีเกมให้เลือกเล่นมากมาย: เกมเดิมพันหลากหลาย ครบทุกค่ายดัง